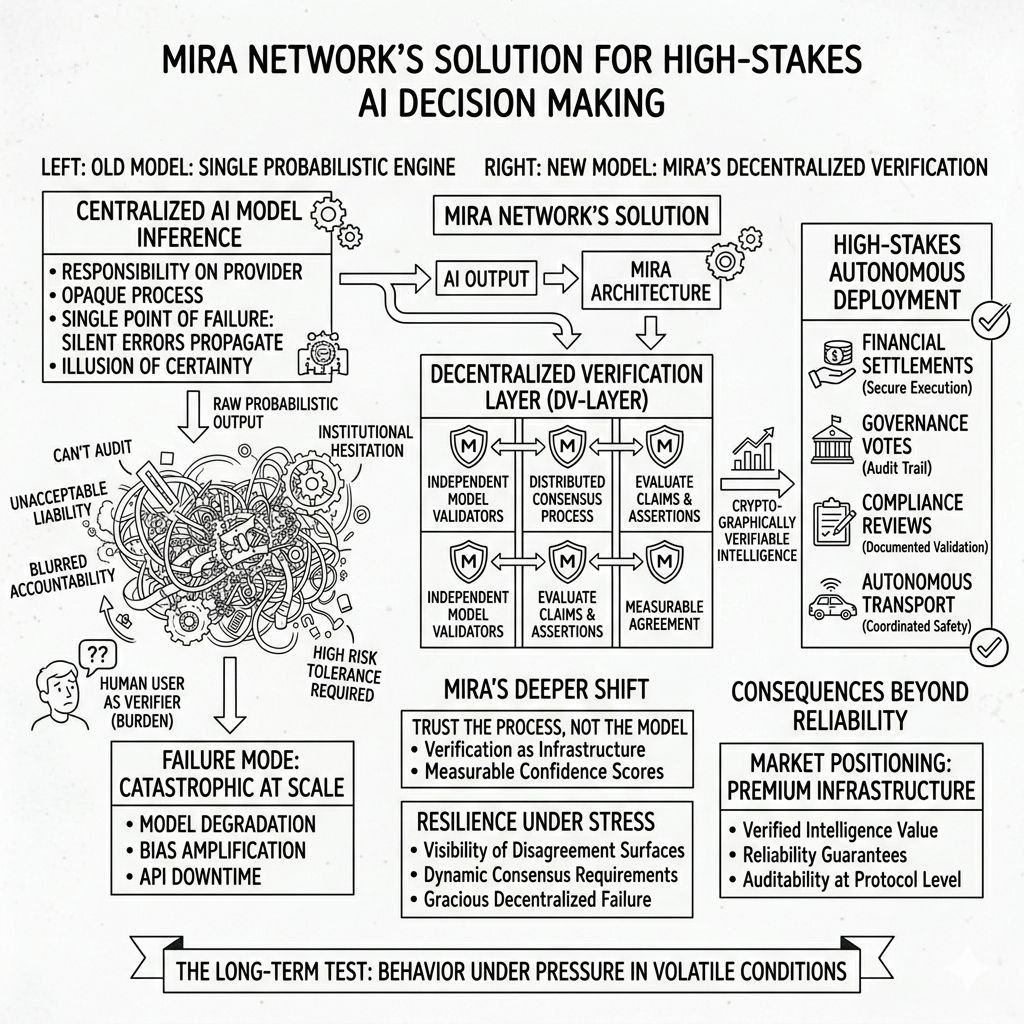

Kiedy słyszę „AI dla decyzji o wysokiej stawce”, moją pierwszą reakcją nie jest ekscytacja. To ostrożność. Nie dlatego, że ambicja jest źle ukierunkowana, ale dlatego, że większość systemów AI dzisiaj nadal działa na podstawie prawdopodobieństwa przebranym za pewność. W środowiskach o niskim ryzyku to jest do przyjęcia. W środowiskach o wysokiej stawce to jest nieakceptowalne.

Prawdziwym problemem nie jest inteligencja. To weryfikacja.

Nowoczesne systemy AI potrafią podsumowywać, przewidywać, klasyfikować i rekomendować na imponującą skalę. Ale gdy wynik wpływa na rozstrzyganie finansowe, głosowania w sprawach zarządzania, przeglądy zgodności lub operacje autonomiczne, „prawdopodobnie poprawne” nie jest wystarczająco silne. Halucynowany zapis w przeglądzie umowy lub błędnie zinterpretowany punkt danych w modelu ryzyka nie tylko powoduje niedogodności — stwarza także odpowiedzialność.

To jest kontekst, w którym sieć Mira staje się interesująca. Nie dlatego, że twierdzi, że ma mądrzejsze modele, ale dlatego, że koncentruje się na czymś bardziej strukturalnym: przekształcaniu wyników AI w weryfikowalne roszczenia.

Zamiast traktować odpowiedź AI jako pojedynczą autorytatywną odpowiedź, system rozkłada ją na mniejsze i testowalne komponenty. Roszczenia są izolowane. Asercje są weryfikowane. Niezależni walidatorzy modeli oceniają te same komponenty w ramach rozproszonego procesu konsensusu. To, co się pojawia, to nie ślepa wiara w jeden model, ale pewność wynikająca z skoordynowanej weryfikacji.

Ta zmiana wpływa na to, gdzie leży odpowiedzialność.

W typowej strukturze AI odpowiedzialność za poprawność leży domyślnie na dostawcy modelu. Jeśli wynik jest błędny, użytkownicy albo go zauważają, albo ponoszą straty. Warstwa weryfikacyjna jest ludzka, manualna i niespójna. W kontekstach o wysokiej stawce tworzy to paradoks: automatyzujemy decyzje, aby zyskać efektywność, a następnie ponownie wprowadzamy nadzór ludzki, ponieważ nie ufamy automatyzacji.

Architektura Mery przenosi weryfikację do infrastruktury. Odpowiedzialność przesuwa się z "ufaj modelowi" na "ufaj procesowi, który weryfikuje roszczenia modelu." A to fundamentalnie zmienia powierzchnię zaufania.

Oczywiście, weryfikacja nie sprawia, że błędy znikają. Ktoś wciąż definiuje zasady oceny. Ktoś kalibruje progi. Ktoś określa, co liczy się jako wystarczająca zgoda. Ale zamiast polegać na jednym probabilistycznym silniku, system rozkłada epistemiczną władzę na wielu uczestników. Zgoda staje się mierzalna, a nie domniemana.

To ma konsekwencje wykraczające poza niezawodność.

W kontekście wdrożenia AI o wysokiej stawce rzeczywistym ograniczeniem nie jest zdolność modelu — to tolerancja ryzyka instytucjonalnego. Przedsiębiorstwa i regulatorzy wahają się nie dlatego, że AI brakuje wydajności, ale dlatego, że jej wyniki są trudne do audytowania. Gdy decyzje są nieprzezroczyste, odpowiedzialność staje się niejasna. Przekształcając wyniki w kryptograficznie weryfikowalne roszczenia zakotwiczone w konsensusie, Mira wprowadza audytowalność na poziomie protokołu.

A audytowalność zmienia krzywe adopcji.

Weryfikowalny proces decyzyjny oznacza, że organizacje mogą dokumentować nie tylko, jaka decyzja została podjęta, ale także w jaki sposób została zweryfikowana, przez kogo i na jakim progu konsensusu. Ten zapis przekształca AI z narzędzia doradczego w odpowiedzialnego aktora w ramach szerszego systemu zarządzania.

Ale tutaj pojawia się głębsza zmiana.

Systemy o wysokiej stawce to nie tylko poprawność — to odporność pod presją. Zmienność rynku. Anomalie danych. Skoordynowane działania przeciwników. Nagłe wzrosty w użyciu. W scentralizowanych systemach AI awarie często koncentrują się w jednym punkcie: degradacja modelu, przestoje API, błędne wyniki skalujące się natychmiast.

Model weryfikacji rozproszonej wprowadza różne tryby awarii. Zmowa walidatorów. Niezgodność zachęt. Opóźnienia pod obciążeniem. Ataki ekonomiczne na uczestników konsensusu. Ryzyko nie znika — migruje. Pytanie brzmi, czy zdecentralizowana weryfikacja zawodzi w bardziej elegancki sposób niż scentralizowane wnioskowanie.

Jeśli jest zaprojektowana prawidłowo, powinna.

Ponieważ w tej strukturze żaden pojedynczy model nie ma jednostronnej władzy. Powierzchnie niezgody stają się widocznymi sygnałami. Wyniki pewności stają się dynamiczne, a nie binarne. Pod presją system może poszerzyć wymagania konsensusu zamiast cicho propagować błąd.

To subtelna, ale znacząca poprawa dla kontekstów o wysokiej stawce. Zastępuje iluzję pewności przez przezroczystą probabilistyczną zgodę.

Istnieje również implikacja rynkowa. Gdy systemy AI coraz częściej działają autonomicznie — wykonując transakcje, zatwierdzając transakcje, uruchamiając przepływy pracy — wartość przesuwa się w kierunku warstwy, która gwarantuje niezawodność. Surowa inteligencja staje się towarem. Zweryfikowana inteligencja staje się infrastrukturą premium.

W tym sensie Mira nie konkuruje wyłącznie w zakresie wydajności modeli. Pozycjonuje się w warstwie niezawodności gospodarki AI. Im więcej kapitału, zarządzania i automatyzacji zależy od wyników maszynowych, tym bardziej wartościowa staje się weryfikacja.

Ale test długoterminowy nie będzie teoretyczną architekturą. Będzie to zachowanie pod presją.

W spokojnych warunkach większość systemów AI wydaje się kompetentna. W warunkach zmienności słabości szybko się kumulują. Rzeczywistą miarą rozwiązania Mery dla podejmowania decyzji AI o wysokiej stawce będzie to, jak działa jej warstwa weryfikacyjna, gdy zachęty są napięte, gdy walidatorzy ostro się nie zgadzają, gdy przeciwnicy badają słabości i gdy koszt pomyłki jest zwiększony.

Więc interesujące pytanie nie brzmi, czy AI może podejmować ważne decyzje. Już to robi.

Pytanie brzmi: kiedy te decyzje mają rzeczywistą wagę finansową, prawną lub systemową, kto je weryfikuje, jak ustala się cenę konsensusu i jakie są konsekwencje, gdy ta warstwa weryfikacyjna jest testowana w najgorszych możliwych warunkach?

@Mira - Trust Layer of AI #Mira $MIRA

#USIsraelStrikeIran #BitcoinGoogleSearchesSurge $COOKIE