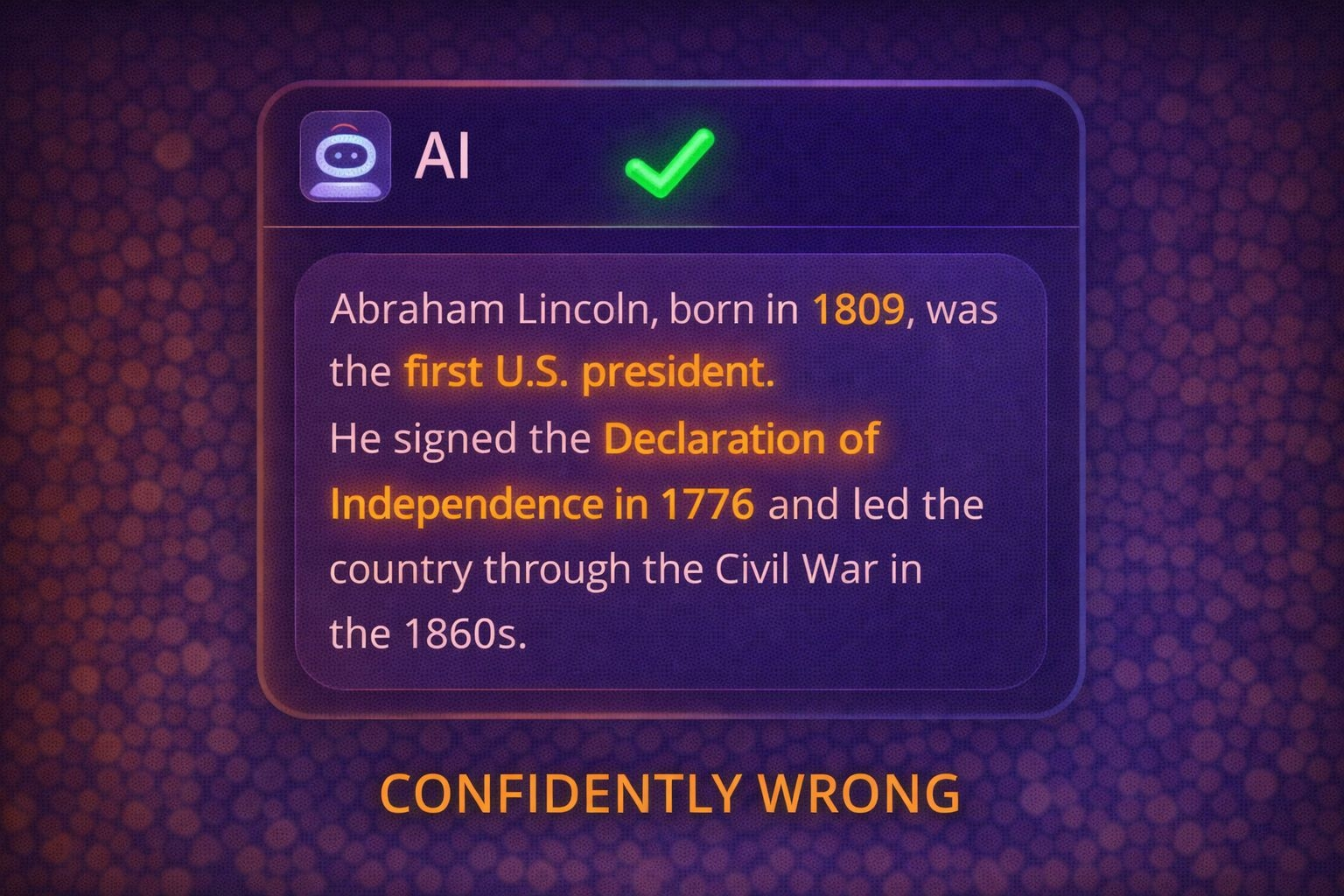

Straciłem rachubę, ile razy widziałem, jak AI pewnie mówi coś całkowicie błędnego.

Nieco się myli.

Nie „możliwe, że mylące.”

Po prostu błędny w sposób, który przeszedłby niezauważony, gdybym już nie znał odpowiedzi.

Na początku było to prawie zabawne.

Zauważyłbyś błąd. Popraw go. Idź dalej.

Ale z czasem przestało być zabawne.

Ponieważ wzór nie był rzadki.

To było strukturalne.

AI nie waha się, gdy halucynuje. Nie sygnalizuje wątpliwości. Nie obniża swojego tonu, gdy zgaduje.

Mówi z tą samą spokojną autorytetą, niezależnie od tego, czy ma rację.

A im bardziej płynne się staje, tym trudniej jest zauważyć różnicę.

Wtedy przestałem myśleć o halucynacjach jako o błędach.

To nie są błędy.

Są produktem tego, jak te systemy działają.

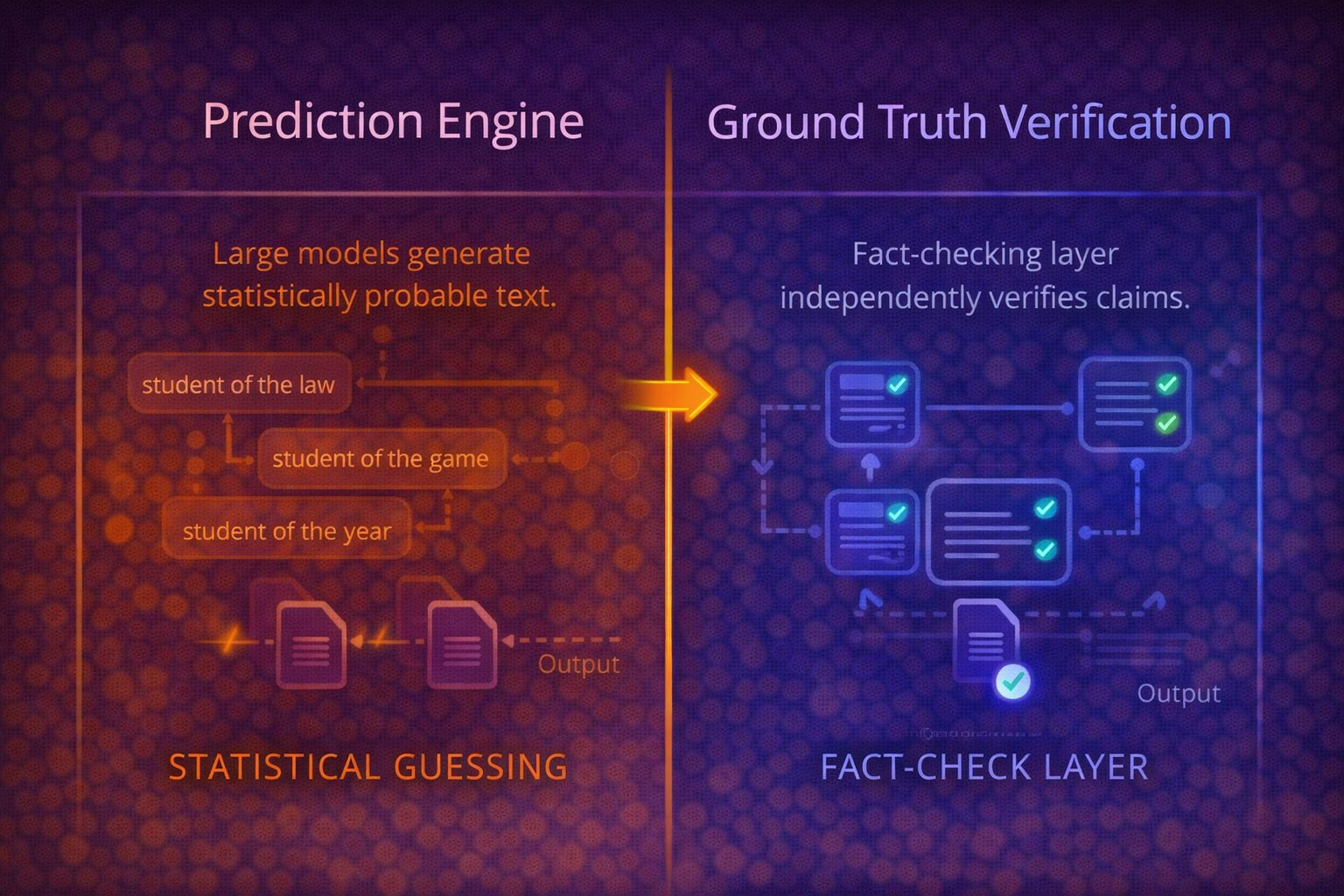

Duże modele generują najbardziej statystycznie prawdopodobną kontynuację tekstu. Nie „sprawdzają” swoich odpowiedzi w czasie rzeczywistym w odniesieniu do prawdy.

Przewidują.

Czasami prognoza jest dokładna.

Czasami nie jest.

Ale dostawa jest identyczna.

Ta symetria jest problemem.

Gdyby AI było oczywiście niepewne, gdy zgadywało, nie obchodziłoby nas to.

Ale tak nie jest.

Jest płynne.

Co czyni to przekonującym.

A perswazja na dużą skalę bez weryfikacji staje się niebezpieczna.

Szczególnie gdy AI przechodzi od pisania tweetów do systemów, które mają znaczenie.

Agenci handlowi.

Filtry zgodności.

Autonomiczne przepływy pracy.

Wsparcie w zarządzaniu.

Gdy wynik staje się działaniem, halucynacje przestają być irytujące.

Stają się ciężarem.

To jest kontekst, w którym Mira zaczęła mieć sens dla mnie.

Nie tak bardzo popularny.

Nie jako „AI + blockchain.”

Jako odpowiedź na wadę strukturalną.

Ponieważ problem nie polega na tym, że AI popełnia błędy.

Ludzie również.

Problem polega na tym, że błędy AI nie niosą ze sobą kosztów.

Nie ma wbudowanej kary za pewne produkowanie czegoś fałszywego.

Użytkownik ponosi ciężar korekty.

Lub co gorsza, nie zauważa.

Mira zmienia to ujęcie.

Zamiast zakładać, że modele będą doskonałe, zakłada, że nie będą.

Zamiast traktować wynik jako pojedynczy kawałek prawdy, dekomponuje go na twierdzenia.

Twierdzenia, które można ocenić niezależnie.

I nie przez jedną scentralizowaną władzę.

Przez wiele modeli uczestniczących w sieci.

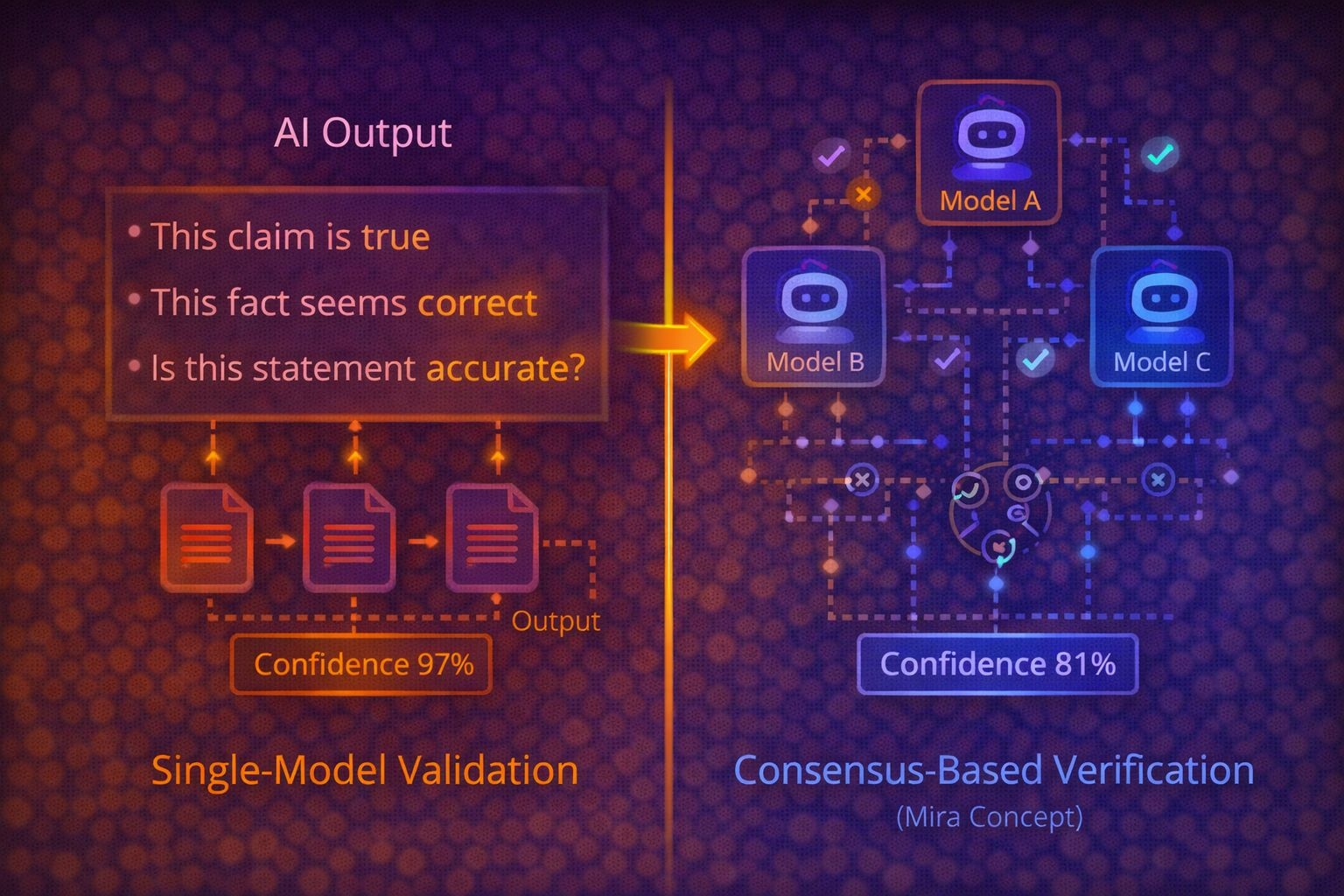

Ta część wydaje się bardzo natywna dla kryptowalut.

Nie ufasz jednemu walidatorowi.

Ufasz konsensusowi.

Nie zakładasz uczciwości.

Dostosowujesz zachęty.

Jeśli kilka niezależnych modeli zgadza się co do twierdzenia, system przypisuje wyższe zaufanie.

Jeśli się różnią, ta różnica staje się widoczna.

Zaufanie staje się mierzalne zamiast sugerowane.

To znacząca zmiana.

Ponieważ w tej chwili większość wyników AI wiąże się z niewidocznymi wynikami zaufania.

Nie widzisz, jak niepewny naprawdę jest model.

Po prostu dostajesz wypolerowany akapit.

Teza Miry sugeruje, że zaufanie powinno być zdobywane poprzez rozproszoną weryfikację, a nie sugerowane przez ton.

Oczywiście, wciąż mam pytania.

Weryfikacja dodaje opóźnienia.

Uruchamianie wielu modeli nie jest tanie.

A deweloperzy zazwyczaj optymalizują pod kątem wygody.

Jeśli weryfikacja jest opcjonalna, często będzie pomijana.

Jest też kwestia różnorodności.

Jeśli modele weryfikujące dzielą podobne dane treningowe lub architektoniczne uprzedzenia, konsensus może odzwierciedlać wspólne ślepe punkty.

Zgoda nie oznacza automatycznie poprawności.

Kryptowaluty również nas tego nauczyły.

Ale nawet z tymi zastrzeżeniami, kierunek wydaje się zgodny z rzeczywistością.

AI nie staje się mniej zintegrowane w krytycznych systemach.

Przyspiesza.

A im więcej autorytetu mu nadamy, tym bardziej niebezpieczne staje się nieweryfikowane zaufanie.

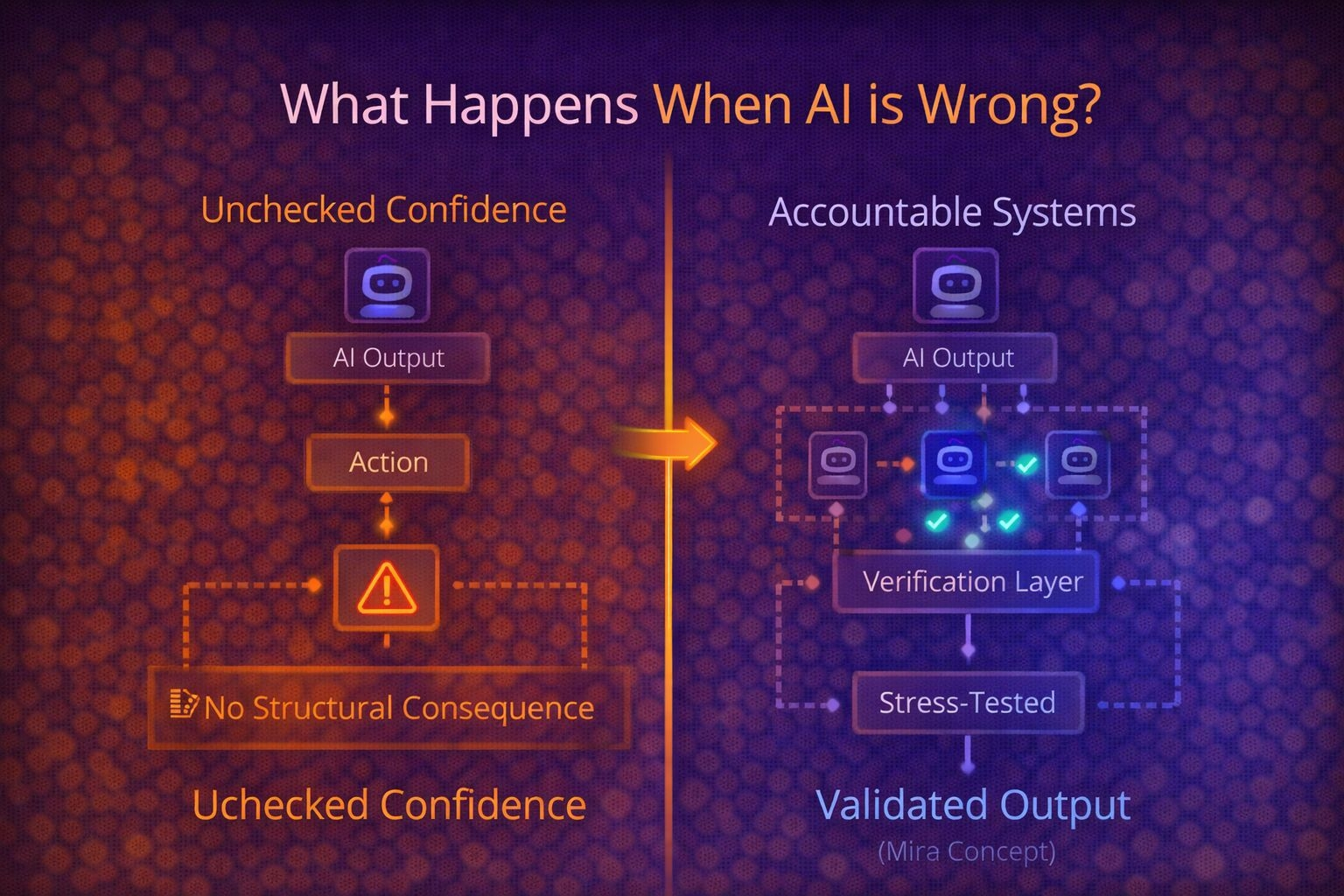

Widziałem wystarczająco dużo pewnych błędnych wyników, aby przestać koncentrować się wyłącznie na rozmiarze modelu lub wynikach benchmarków.

Mądrzejszy nie oznacza odpowiedzialny.

Prawdziwe pytanie nie brzmi:

„Jak dokładny jest ten model?”

To jest:

„Co się stanie, gdy będzie w błędzie?”

W tej chwili odpowiedź zwykle brzmi: nic strukturalnego.

Ktoś naprawia to ręcznie.

Lub wymyka się.

Mira jest interesująca, ponieważ stara się uczynić bycie w błędzie kosztownym.

Aby wprowadzić tarcie.

Aby stworzyć system, w którym wyniki są testowane pod kątem wytrzymałości, zanim staną się danymi wejściowymi.

To myślenie o infrastrukturze.

Nie efektowne.

Nie wirusowe.

Ale niezbędne, jeśli AI ma działać autonomicznie w środowiskach finansowych, prawnych lub zarządzania.

Nie jestem bezkrytycznie optymistyczny.

Wykonanie ma znaczenie.

Różnorodność walidatorów ma znaczenie.

Zachęty mają znaczenie.

Ale nie mogę już zignorować tego wzorca.

Widziałem, jak AI było pewne w błędzie zbyt wiele razy, aby traktować pewność jako wiarygodność.

A gdy już to wyraźnie dostrzegasz, pomysł warstwy weryfikacyjnej przestaje wydawać się opcjonalny.

Zaczyna wydawać się nieuniknione.