في سباق الذكاء الاصطناعي، الجميع يركّز على من يبني النموذج الأقوى والأسرع.

لكن السؤال الحقيقي الذي أراه أكثر أهمية هو: كيف نتحقق من صحة ما ينتجه هذا النموذج؟

الذكاء الاصطناعي اليوم قادر على إنتاج إجابات مذهلة، لكنه في الوقت نفسه عرضة للهلوسة، والتحيز، والأخطاء السياقية. وفي التطبيقات الحساسة – كالطب، والتمويل، وأنظمة الوكلاء المستقلة – لا يمكن قبول إجابة “واثقة لكنها خاطئة”.

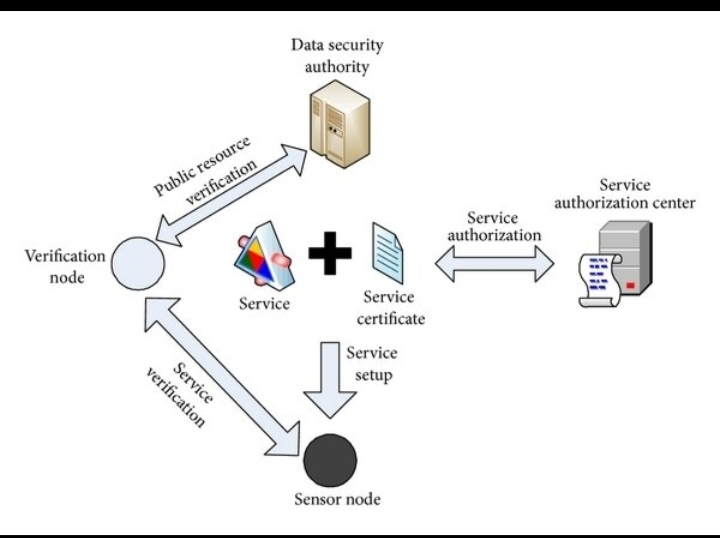

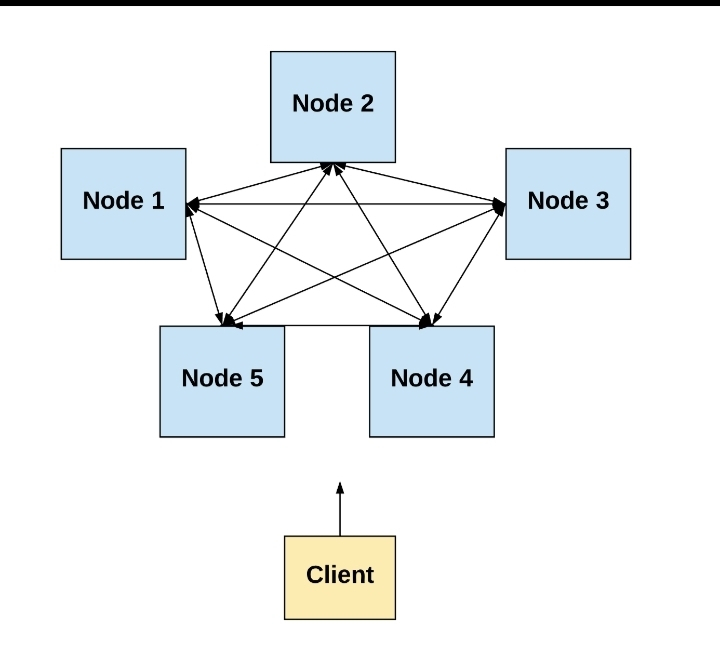

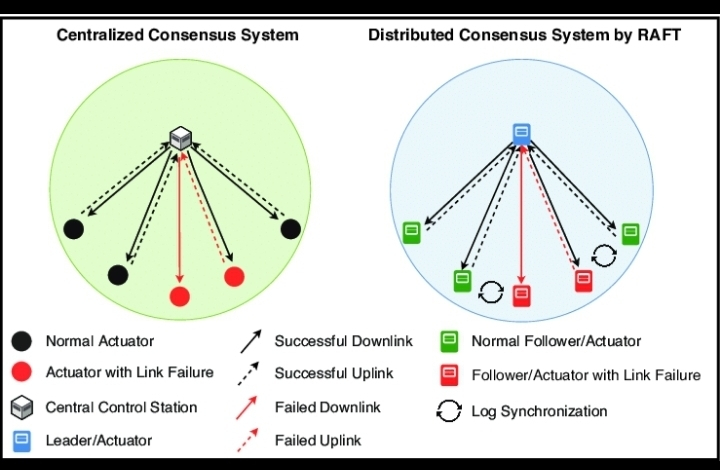

هنا تحديدًا يأتي دور Mira Network، كبروتوكول تحقق لامركزي يضيف طبقة ثقة فوق أنظمة الذكاء الاصطناعي.

ما الذي تفعله Mira فعليًا؟

Mira لا تبني نموذج ذكاء اصطناعي جديد.

بل تبني بنية تحتية للتحقق من مخرجات النماذج.

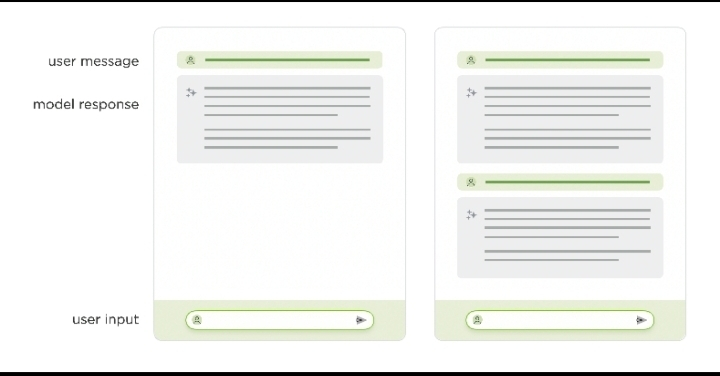

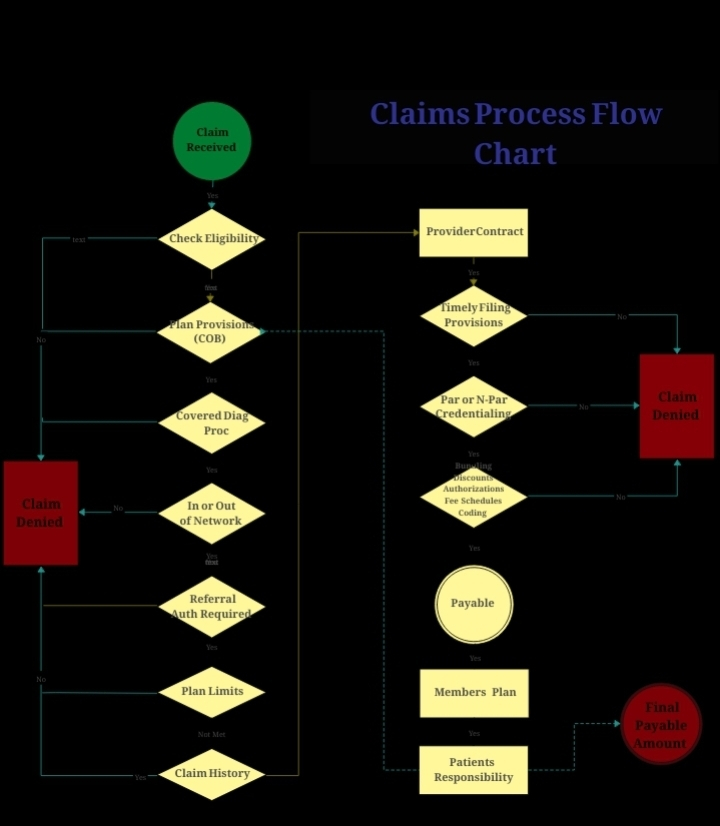

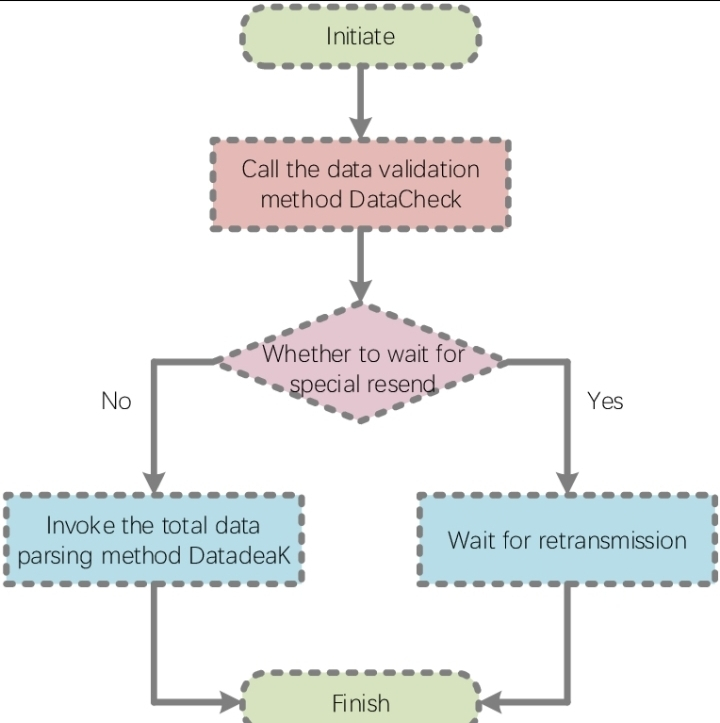

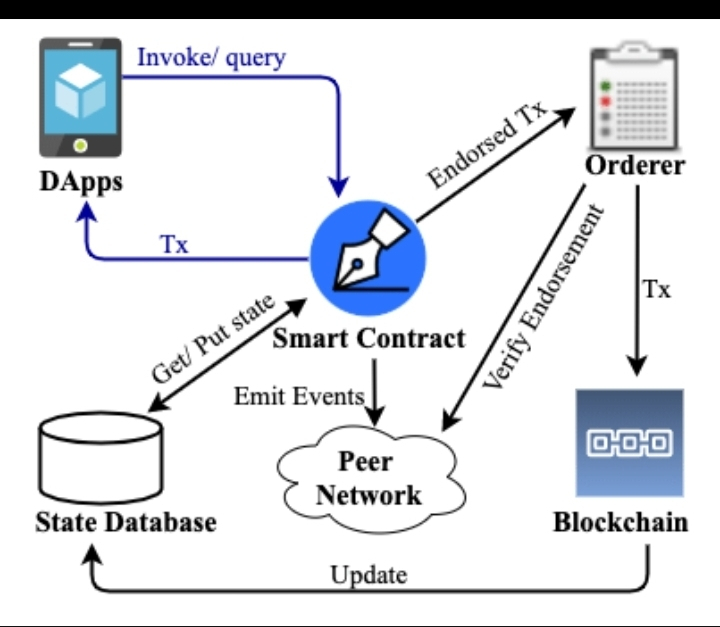

أي أنها تعمل كطبقة ثانية فوق الذكاء الاصطناعي، تقوم بـ:

تفكيك الإجابة إلى ادعاءات قابلة للتحقق

توزيعها على شبكة مدققين مستقلين

الوصول إلى إجماع لامركزي حول صحتها

توثيق النتيجة بشفافية على السلسلة

بمعنى أوضح:

Mira تحول إجابة الذكاء الاصطناعي من “رأي نموذج” إلى “نتيجة تم التحقق منها”.

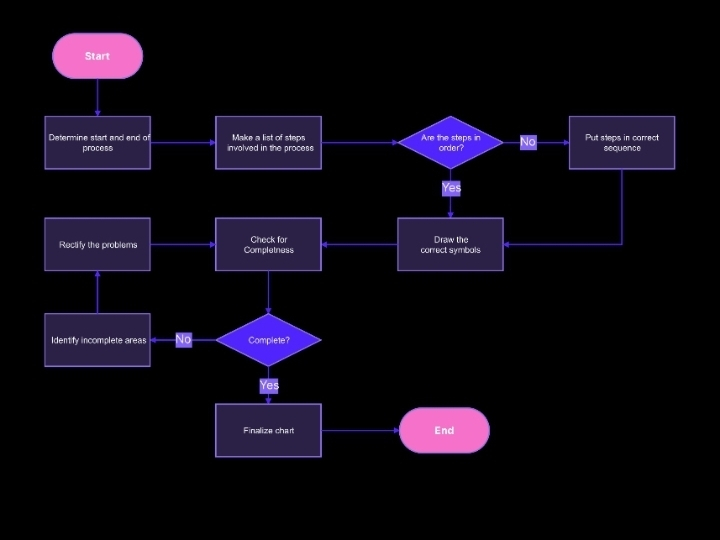

كيف تعمل Mira؟ (الآلية خطوة بخطوة)

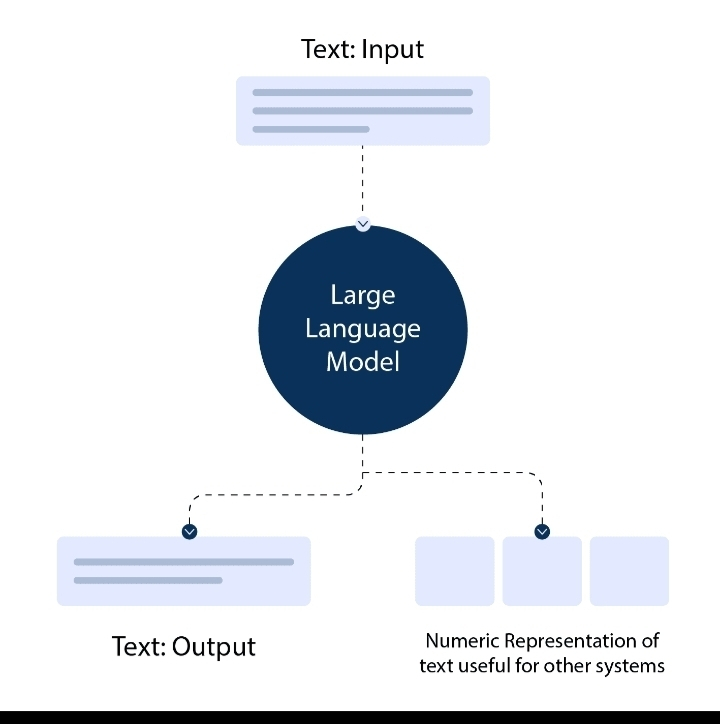

1️⃣ إنتاج المخرج من نموذج الذكاء الاصطناعي

في البداية، يقوم نموذج ذكاء اصطناعي (مثل LLM أو نموذج تحليلي) بإنتاج استجابة أو تحليل معين.

هذه الاستجابة قد تحتوي على:

حقائق

استنتاجات

أرقام

توصيات

لكنها في هذه المرحلة غير مُتحقق منها.

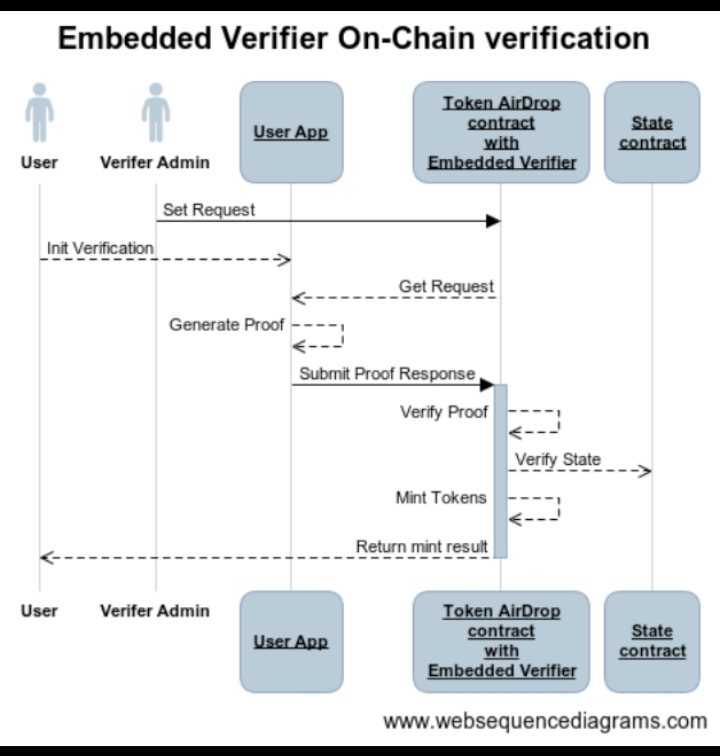

2️⃣ تفكيك المخرجات إلى ادعاءات قابلة للتحقق

تقوم Mira بتحليل الإجابة وتقسيمها إلى Claims (ادعاءات محددة).

مثال:

“معدل التضخم في الدولة X هو 5%”

“هذا الدواء يقلل المخاطر بنسبة 30%”

كل ادعاء يصبح وحدة مستقلة يمكن اختبارها.

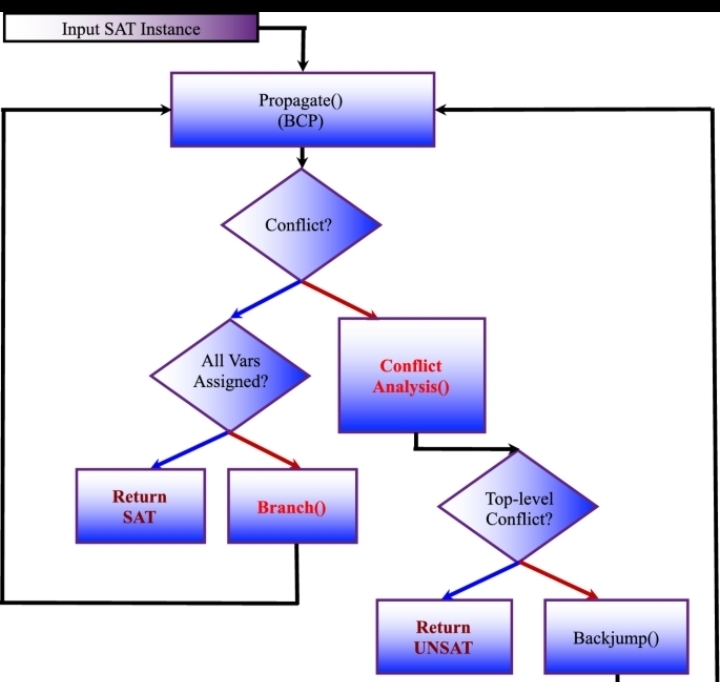

3️⃣ توزيع التحقق على شبكة لامركزية

يتم إرسال هذه الادعاءات إلى شبكة من المدققين:

نماذج ذكاء اصطناعي أخرى

مدققين مستقلين

عقد تحقق (Validators)

كل طرف يعيد التقييم بشكل مستقل.

ثم يتم الوصول إلى إجماع لامركزي حول صحة الادعاء.

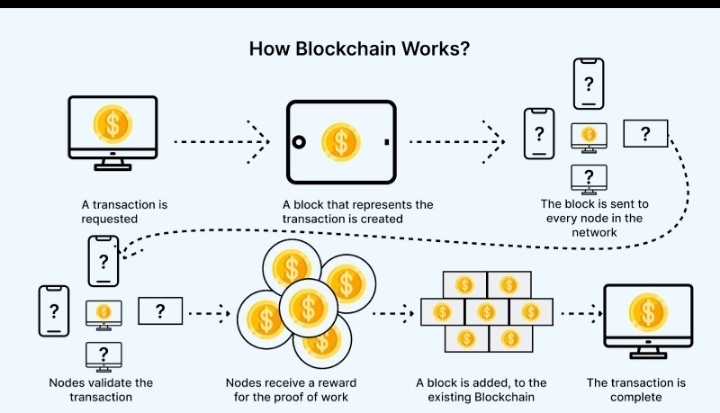

4️⃣ توثيق النتيجة على السلسلة

بعد اكتمال التحقق:

يتم إصدار نتيجة نهائية (صحيح / غير دقيق / يحتاج مراجعة)

تُسجل عملية التحقق بشفافية على البلوكشين

يمكن لأي طرف الرجوع إليها لاحقًا

وهنا تتحول الإجابة من مجرد نص… إلى مخرج قابل للإثبات.

ما الذي يميز Mira عن غيرها؟

🔹 التحقق المتقاطع بدل الثقة العمياء

بدل الاعتماد على نموذج واحد، يتم استخدام تعددية للتحقق وتقليل الانحياز.

🔹 اقتصاد حوافز يحمي النزاهة

المشاركون يكافَؤون عند التحقق الدقيق، ويُعاقَب السلوك غير النزيه اقتصاديًا.

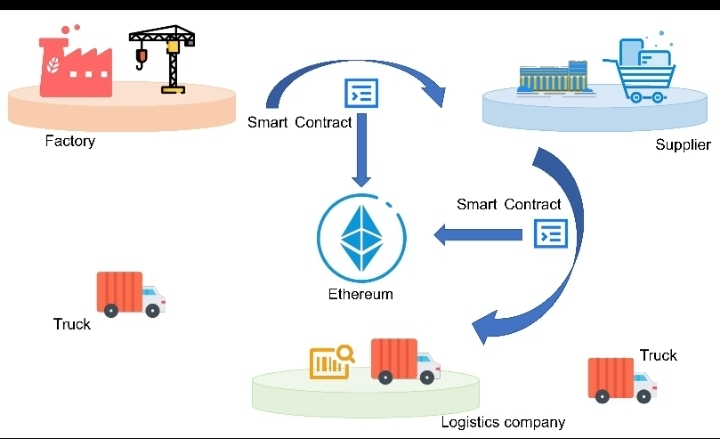

🔹 بنية مناسبة لوكلاء الذكاء الاصطناعي (AI Agents)

مع انتشار الأنظمة المستقلة، تصبح طبقة التحقق ضرورة لضمان قرارات آمنة.

🔹 شفافية كاملة

كل خطوة قابلة للتتبع دون الحاجة للثقة في جهة مركزية.

لماذا أرى أن هذا مهم جدًا؟

نحن ندخل مرحلة يصبح فيها الذكاء الاصطناعي:

صانع قرارات

منفذ عمليات

متحكم في أصول رقمية

وسيطًا في معاملات مالية

بدون طبقة تحقق، ستبقى هذه الأنظمة قوية… لكنها هشة من ناحية الثقة.

Mira تمثل محاولة لبناء Trust Layer للذكاء الاصطناعي،

كما كانت البلوكشين طبقة ثقة للمعاملات المالية.

الخلاصة

Mira ليست مجرد مشروع تقني، بل رؤية لإعادة تعريف العلاقة بين البشر والذكاء الاصطناعي.

لسنا بحاجة فقط إلى نماذج أذكى.

نحن بحاجة إلى أنظمة يمكن إثبات صحتها.

وفي رأيي، أي مستقبل يعتمد على AI Agents وأنظمة مستقلة لن يكتمل بدون وجود بروتوكولات تحقق لامركزية مثل Mira.

المستقبل لن يكون لمن يملك النموذج الأقوى فقط،

بل لمن يملك القدرة على إثبات أن هذا النموذج على حق.

@Mira - Trust Layer of AI #Mira $MIRA