@Mira - Trust Layer of AI #Mira

Kiedy słyszę „wielomodelowa zgoda dla niezawodności AI”, moim pierwszym instynktem nie jest pewność – to ciekawość z nutą ostrożności. Nie dlatego, że sprawdzanie wielu wyników AI jest błędne, ale dlatego, że niezawodność w probabilistycznym systemie nigdy nie jest prostym tak lub nie. Zgoda może sygnalizować pewność – ale może też maskować wspólne ślepe punkty. Prawdziwa niezawodność nie pochodzi z jednomyślności; pochodzi z tego, jak radzi się z niezgodą.

Większość dzisiejszych awarii AI nie jest dramatyczna. Są subtelne. Fałszywa cytacja. Źle zinterpretowany zapis. Pewna odpowiedź oparta na chwiejnych założeniach. To nie są wyjątki – to strukturalne artefakty sposobu, w jaki duże modele generują tekst. Prośba do jednego modelu o samokorekcję jest jak prośba do świadka o przesłuchanie samego siebie: czasami działa, często wzmacnia ten sam błąd.

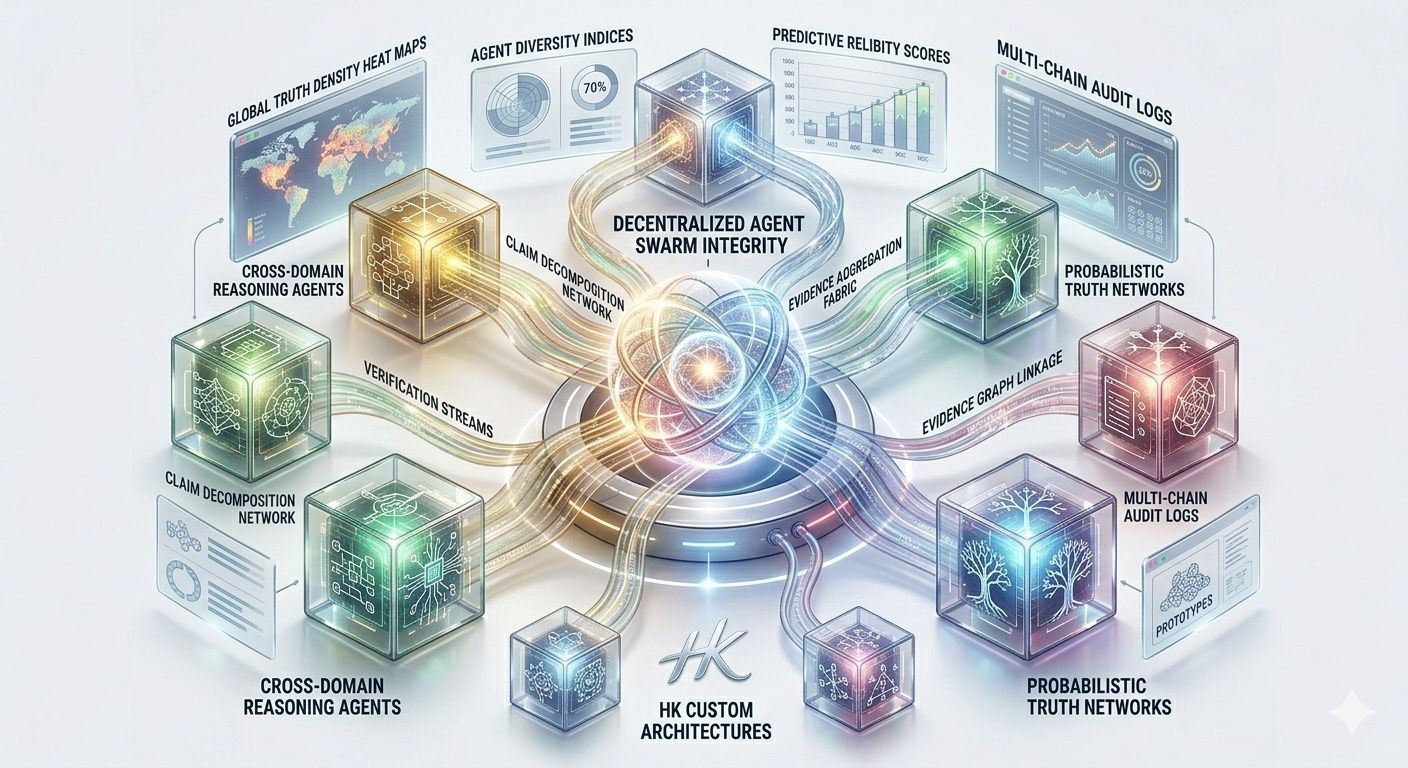

To jest miejsce, w którym wielomodelowe zarządzanie Miry zmienia zasady gry. Wyniki nie są ostatecznymi odpowiedziami — są roszczeniami do przetestowania. Wiele niezależnych modeli analizuje to samo roszczenie, z każdym przynoszącym unikalne dane treningowe, uprzedzenia architektoniczne i wzorce rozumowania. Niezawodność wyłania się nie z autorytetu żadnego pojedynczego modelu, ale z tego, jak te roszczenia są wspólnie weryfikowane.

Mechanika ma znaczenie. Konsensus nie jest głosowaniem większościowym. Rozbieżności się zdarzają — z powodu niejednoznaczności, brakującego kontekstu lub sprzecznych priorytetów. Solidny system identyfikuje znaczącą rozbieżność w porównaniu do szumu. Jeśli dwa modele się zgadzają, a jedno się sprzeciwia, czy sprzeciwiający się zauważa subtelny błąd — czy tylko halucynuje? Odpowiedź definiuje wartość systemu.

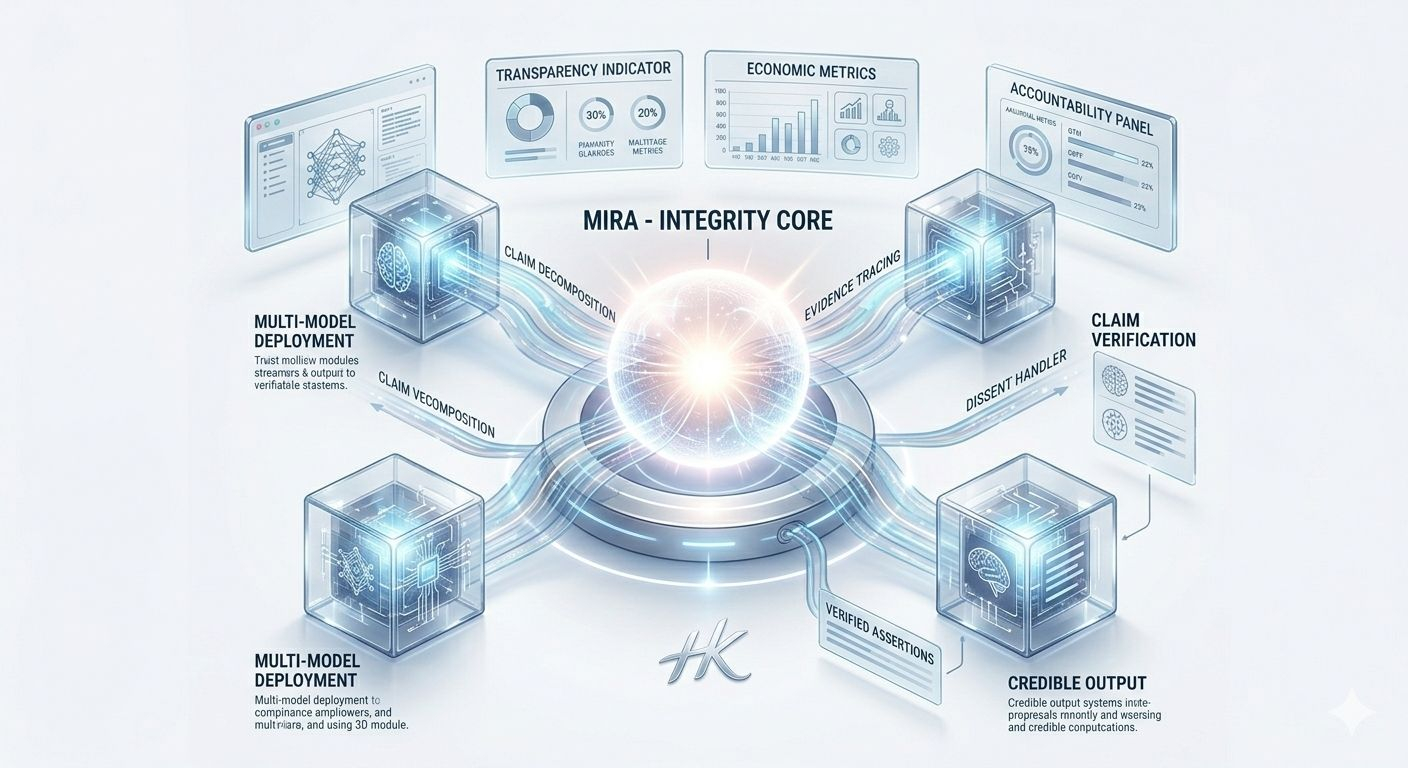

Weryfikacja staje się ustrukturyzowanym procesem: dekompozycja roszczeń, śledzenie dowodów, ważenie pewności. Złożone wyniki rozkładają się na weryfikowalne stwierdzenia. Podsumowanie finansowe przekształca się w możliwe do sprawdzenia twierdzenia. Rozumowanie prawne staje się łańcuchem interpretacji. Modele nie są mądrzejsze — ale roszczenia stają się testowalne.

Oto głębsza zmiana: zaufanie przechodzi od modeli do warstw zarządzania. Tradycyjne rurociągi centralizują zaufanie: jeśli model zawiedzie, system zawiedzie. Mira rozdziela zaufanie: wyniki nie są „prawdziwe, ponieważ model tak powiedział”, są wiarygodne, ponieważ niezależne systemy doszły do kompatybilnych wniosków. Subtelne, ale głębokie.

Oczywiście, konsensus nie jest niezawodny. Nakładające się dane treningowe mogą wzmacniać przestarzałe fakty. Uprzedzenia mogą się nasilać. Wrogie dane wejściowe mogą wykorzystywać słabości. Systemy wielomodelowe zmniejszają losowy błąd — ale nie eliminują skoordynowanego błędu. Przejrzystość ma znaczenie równie mocno jak sam konsensus. Użytkownicy muszą wiedzieć, czy weryfikacja odzwierciedla prawdziwą niezależność, czy skupiska niemal identycznych modeli. Różnorodność w architekturze i szkoleniu jest podstawową gwarancją niezawodności.

Istnieje również warstwa ekonomiczna. Każde wywołanie weryfikacji wiąże się z kosztami, opóźnieniami i obciążeniem infrastruktury. Decydowanie, które roszczenia weryfikować — i jak głęboko — staje się wyzwaniem alokacji zasobów, a nie tylko problemem technicznym. Aplikacje integrujące zweryfikowaną sztuczną inteligencję nie są już pasywnymi konsumentami — stają się orkiestratorami niezawodności zarządzającymi kompromisami między prędkością a pewnością definiującymi, kiedy potrzebna jest ludzka ocena.

To zmienia krajobraz konkurencyjny. Systemy AI będą konkurować nie tylko pod względem możliwości, ale także jakości weryfikacji: przejrzyste zarządzanie niepewnością, łagodzenie rozbieżności, zapobieganie cichym awariom. Zwycięskie systemy nie obiecają doskonałości — uczynią niezawodność widoczną, czytelną, odporną.

Patrząc w ten sposób, wielomodelowe zarządzanie Miry nie jest cechą — to warstwa odpowiedzialności inteligencji maszynowej. Wyniki AI stają się propozycjami, a nie deklaracjami. Błędy są nieuniknione, ale proces je ogranicza, zanim przekształcą się w decyzje, rynki lub publiczną dyskusję.

A ostateczne pytanie nie brzmi, czy modele mogą się zgadzać — lecz kto definiuje zgodność, jak interpretowane są rozbieżności i jakie zabezpieczenia aktywują się, gdy konsensus waha się. To tam mieszka prawdziwa niezawodność.