Ostatnio badałem sieć Mira i token $MIRA z perspektywy technologicznej i infrastrukturalnej, a nie tylko koncentrując się na jego cenie rynkowej. To, co najbardziej mnie interesuje, to jak zaprojektowana jest sieć, jak działają jej wewnętrzne systemy i jaką rolę token odgrywa w szerszym ekosystemie.

Sztuczna inteligencja rozwija się w niesamowitym tempie. Systemy AI dzisiaj mogą generować imponujące spostrzeżenia, automatyzować zadania i wspierać złożone procesy podejmowania decyzji. Jednak obok tych postępów istnieje poważny problem: niezawodność.

Systemy AI mogą czasami generować halucynacje, stronnicze wyniki lub niespójne rezultaty. W aplikacjach codziennych lub rozrywkowych może to nie powodować dużych szkód, ale w środowiskach, gdzie decyzje mają realne konsekwencje, ryzyko staje się znaczące. Usługi finansowe, opieka zdrowotna, analiza prawna i decyzje polityczne wymagają znacznie wyższego poziomu pewności, niż aktualne systemy AI mogą konsekwentnie zapewnić.

To wyzwanie jest częścią powodu, dla którego rozwinięto sieć Mira. Projekt koncentruje się na przekształcaniu wyników AI w informacje weryfikowalne, zamiast po prostu akceptować wynik jednego modelu.

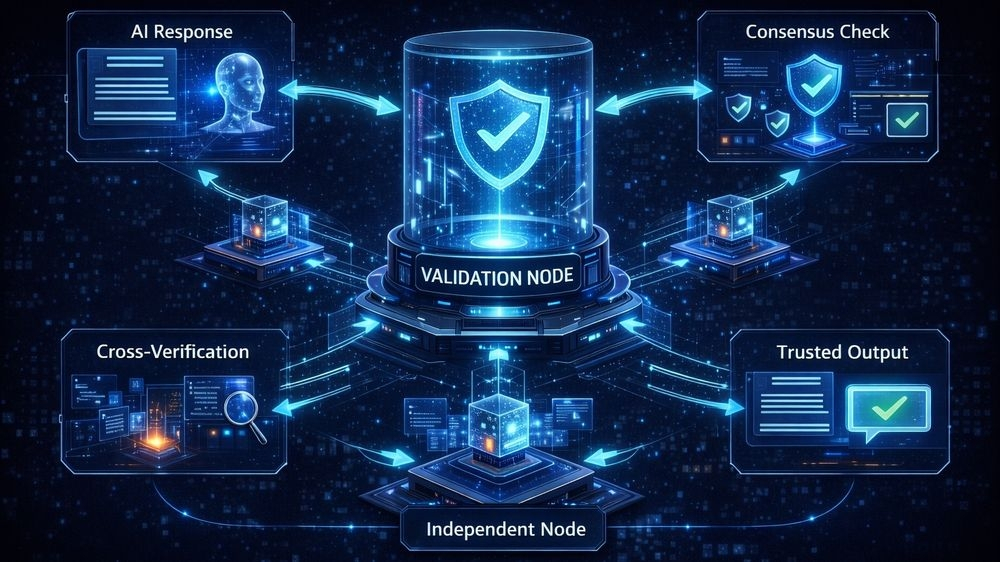

Koncepcja stojąca za Mirą jest stosunkowo prosta, ale potężna. Zamiast polegać na jednym modelu AI do generowania i walidacji odpowiedzi, Mira dzieli skomplikowane wyniki AI na indywidualne weryfikowalne twierdzenia. Te twierdzenia są następnie rozdzielane w sieci, gdzie wiele systemów AI uczestniczy w weryfikacji dokładności informacji.

Poprzez ten proces, system wprowadza dodatkową warstwę weryfikacji, która często brakuje w tradycyjnych architekturach AI. Zamiast ufać jednemu systemowi, sieć tworzy mechanizm współpracy w zakresie walidacji.

Jedną z kluczowych zalet tego podejścia jest przejrzystość. Wyniki procesu weryfikacji mogą być rejestrowane na blockchainie, tworząc ślad, jak doszło do wyciągnięcia wniosku. Deweloperzy i organizacje mogą przeglądać te zapisy, aby zrozumieć ścieżkę weryfikacji stojącą za wynikiem generowanym przez AI.

Ten poziom przejrzystości jest szczególnie ważny w sektorach, gdzie odpowiedzialność i audytowalność są niezbędne.

Innym interesującym aspektem sieci Mira jest jej neutralny projekt. System nie jest zbudowany wokół jednego dostawcy AI lub modelu. Zamiast tego, został zaprojektowany, aby współpracować z wieloma systemami AI od różnych deweloperów. Pozwalając różnym modelom oceniać i weryfikować wyniki innych, sieć ma na celu zmniejszenie zależności od jakiegoś pojedynczego źródła informacji.

Teoretycznie, ta struktura mogłaby znacznie poprawić wiarygodność wniosków generowanych przez AI.

Jednak, jak w przypadku każdej nowej infrastruktury, pozostaje kilka ważnych pytań. Sieci weryfikacyjne muszą zapewnić silne mechanizmy zachęt dla weryfikatorów do uczestnictwa w sposób uczciwy. Bez odpowiednich zachęt, system może mieć trudności z utrzymaniem wiarygodnego uczestnictwa.

Istnieją również wyzwania związane z skalowalnością i zarządzaniem. W miarę rozwoju sieci, musi ona utrzymać efektywność, jednocześnie zapobiegając ryzykom takim jak zmowa weryfikatorów czy manipulacja. Ramy zarządzania odegrają ważną rolę w określaniu, jak system ewoluuje i dostosowuje się w czasie.

Pomimo tych wyzwań, sieć Mira reprezentuje interesującą zmianę w rozmowie na temat sztucznej inteligencji. Duża część obecnej dyskusji o AI koncentruje się na możliwościach — jak potężne stają się modele.

Mira przedstawia inną perspektywę: weryfikację.

Jeśli warstwy weryfikacji staną się powszechnie przyjęte, mogą odegrać kluczową rolę w tym, jak systemy AI są wdrażane w rzeczywistych środowiskach. Wiarygodna weryfikacja może stać się brakującą infrastrukturą, która pozwoli AI przejść od eksperymentalnych narzędzi do zaufanych systemów wspierania decyzji.

W tym kontekście projekty takie jak sieć Mira i $MIRA ekosystem badają ważne pytanie: nie tylko co AI może zrobić, ale jak możemy zaufać temu, co produkuje.