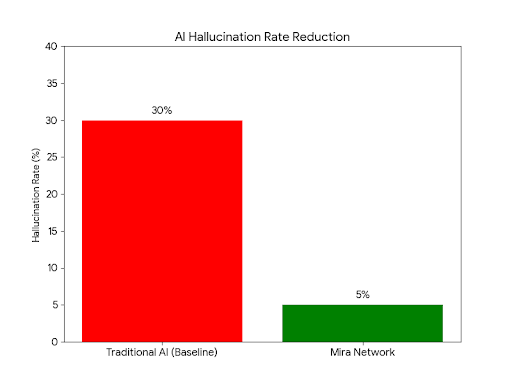

Sztuczna inteligencja weszła w erę, w której jej możliwości wydają się niemal magiczne. Systemy opracowane przez firmy takie jak OpenAI, Google DeepMind i Anthropic potrafią pisać eseje, analizować rynki, generować kod, a nawet symulować ludzkie rozumowanie z imponującą płynnością. Narzędzia takie jak ChatGPT pokazują, jak szybko AI może przekształcić surowe informacje w spójne narracje. Jednak im bardziej obserwuję te systemy, tym bardziej dostrzegam fundamentalną sprzeczność ukrytą pod ich inteligencją: mogą brzmieć niezwykle pewnie, będąc jednocześnie całkowicie w błędzie.

Problem nie jest małym błędem technicznym. To coś głębszego. Duże modele językowe nie „znają” faktów w sposób, w jaki robią to ludzie. Przewidują wzorce w języku. Ich zadaniem jest produkowanie najbardziej statystycznie prawdopodobnej sekwencji słów na podstawie danych treningowych. Kiedy generują odpowiedź, nie weryfikują prawdy; oszacowują prawdopodobieństwo.

To dlatego występują halucynacje.

Czasami model wypełnia luki informacjami, które brzmią całkowicie rozsądnie, ale są całkowicie wymyślone. Może być cytowany artykuł badawczy, który nigdy nie istniał. Statystyka może wydawać się przekonująca, ale nie ma prawdziwego źródła. W swobodnej rozmowie może to być nieszkodliwe, a nawet zabawne. Ale gdy AI zaczyna działać w krytycznych środowiskach—medycyna, finanse, zarządzanie, systemy autonomiczne—konsekwencje stają się poważne.

Często myślę o tym momencie w historii AI jako o przejściu od imponujących narzędzi do systemów podejmujących decyzje. A to przejście stawia nowe pytanie: jak możemy ufać wiedzy generowanej przez maszyny?

Dla mnie to właśnie tutaj koncepcja stojąca za Mira Network staje się fascynująca. Zamiast próbować zbudować jeden model AI, który nigdy nie popełnia błędów—cel, który może być nierealistyczny—pomysł polega na zbudowaniu infrastruktury, która weryfikuje wyniki AI.

Innymi słowy, zamiast pytać, czy AI jest inteligentne, system pyta, czy jego odpowiedź może być udowodniona.

Architektura czerpie pomysły z zdecentralizowanych sieci, które pierwotnie zostały opracowane przez Bitcoin, a później rozszerzone przez ekosystemy takie jak Ethereum. Te systemy rozwiązały inny, ale pokrewny problem: jak stworzyć zaufanie w środowisku, w którym uczestnicy się nie znają.

Blockchainy osiągają to, rozdzielając weryfikację na wiele niezależnych węzłów. Żaden pojedynczy organ nie decyduje, które transakcje są ważne. Zamiast tego sieć osiąga konsensus.

Mira stara się zastosować podobną filozofię do sztucznej inteligencji.

Kiedy AI generuje wynik, system dzieli odpowiedź na mniejsze twierdzenia. Każde twierdzenie może być następnie oceniane niezależnie. Te twierdzenia są rozdzielane w sieci różnych modeli AI i agentów weryfikacyjnych, które próbują je zweryfikować.

Zamiast ufać jednemu modelowi, system polega na wielu perspektywach.

Jeśli wystarczająco wielu niezależnych weryfikatorów zgadza się co do dokładności twierdzenia, informacja staje się kryptograficznie zweryfikowana. To, co zaczyna się jako probabilistyczna odpowiedź, stopniowo przekształca się w coś bliższego zweryfikowanej wiedzy.

Z mojej perspektywy ta zmiana zmienia całkowicie sposób, w jaki powinniśmy myśleć o AI. Dziś większość dyskusji koncentruje się na budowaniu lepszych modeli—większych zbiorów danych, większej liczby parametrów, większej mocy obliczeniowej. Ale warstwy weryfikacji wprowadzają nowy wymiar. Zamiast doskonalić samą inteligencję, budujemy systemy, które sprawdzają inteligencję.

To subtelna, ale potężna idea.

Badacze w instytucjach takich jak MIT i Uniwersytet Stanforda coraz częściej argumentują, że niezawodna AI może wymagać dokładnie tego rodzaju architektury. Przyszłość może nie być zdominowana przez jeden superinteligentny model, ale przez sieci modeli, które ciągle się weryfikują.

Uważam tę perspektywę zarówno elegancką, jak i pragmatyczną.

Zamiast gonić za perfekcją, przyjmuje rzeczywistość, że błędy zawsze będą istnieć. Ważne jest budowanie systemów, które je wykrywają i korygują.

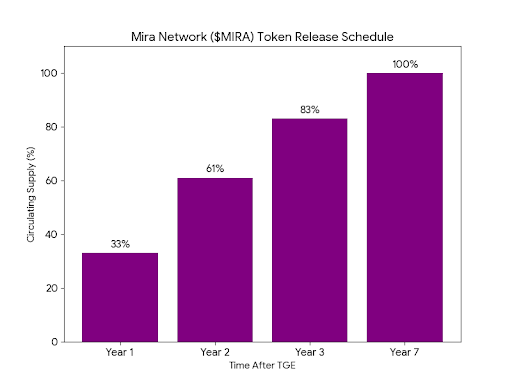

Kolejny intrygujący aspekt podejścia Mira to jego struktura ekonomiczna. Weryfikacja nie jest tylko procesem technicznym; jest incentivizowana. Uczestnicy, którzy poprawnie weryfikują twierdzenia, otrzymują nagrody, podczas gdy niedokładna weryfikacja może prowadzić do kar.

W teorii tworzy to rynek prawdy.

Zachęty ekonomiczne skłaniają uczestników do działania uczciwie, ponieważ dokładność staje się opłacalna. System stara się zharmonizować motywację finansową z integralnością informacyjną.

Ale to także tutaj pojawiają się głębsze pytania.

Rynki mogą być potężnymi narzędziami do koordynacji, ale nie są odporne na manipulację. Historia pokazuje, że systemy zdecentralizowane czasami rozwijają koncentracje władzy. Pulie wydobywcze w sieciach blockchain, kartele weryfikacyjne i skoordynowane ataki na zarządzanie pokazują, jak zachęty ekonomiczne mogą być wykorzystywane.

Więc się zastanawiam: co się stanie, jeśli podobne dynamiki pojawią się w sieciach weryfikacji AI?

Wyobraź sobie sytuację, w której wielu agentów weryfikacyjnych jest szkolonych na tym samym wadliwym zbiorze danych. Mogą wspólnie wzmocnić to samo błędne założenie. Konsensus może się pojawić—nie dlatego, że twierdzenie jest prawdziwe, ale dlatego, że weryfikatorzy dzielą tę samą stronniczość.

To ujawnia głęboki problem, którego technologia sama nie może rozwiązać.

Systemy weryfikacyjne zależą od różnorodności i niezależności swoich uczestników. Bez tej różnorodności konsensus może stać się echem komory.

Niemniej jednak, mimo tych złożoności, szerszy kierunek wydaje się nieunikniony. W miarę jak AI wchodzi głębiej w krytyczną infrastrukturę, społeczeństwo będzie domagać się silniejszych gwarancji dotyczących niezawodności informacji generowanych przez maszyny.

Zaufanie nie będzie już opcjonalne.

Już widzimy wczesne przykłady warstw weryfikacji pojawiających się w innych dziedzinach. Pojazdy autonomiczne sprawdzają dane z czujników z kamer, radaru i lidarów, aby potwierdzić to, co postrzegają. Algorytmy finansowe korzystają z wielu modeli ryzyka, aby weryfikować decyzje handlowe. Nawet wyszukiwarki rozwijane przez Google coraz częściej porównują wyniki w różnych systemach przed przedstawieniem odpowiedzi.

Te systemy kierują się tym samym podstawowym zasadą: inteligencja nie powinna działać bez weryfikacji.

Projekty takie jak Mira sugerują, że sama AI może ostatecznie działać na podstawie sieci weryfikacyjnych. Zamiast pojedynczego modelu odpowiadającego na pytania, wiele agentów mogłoby współpracować, kwestionować i potwierdzać informacje, zanim dotrą do użytkownika.

Jeśli ta wizja stanie się rzeczywistością, sztuczna inteligencja ewoluuje w coś bardziej odpowiedzialnego.

Nie tylko generator odpowiedzi, ale uczestnik w rozproszonym procesie, który ciągle testuje ważność wiedzy.

#Mira $MIRA @Mira - Trust Layer of AI