Kilka miesięcy temu zauważyłem coś interesującego, śledząc różne projekty AI i blockchain. Wiele zespołów ścigało się, aby budować większe modele, szybsze systemy wnioskowania i mądrzejsze agenty AI. Ale bardzo niewielu zadawało podstawowe pytanie: Jak weryfikujemy to, co produkuje AI?

To pytanie jest tym, w czym Mira zaczyna się wyróżniać.

Zamiast skupiać się tylko na budowaniu AI, Mira koncentruje się na czymś, co może stać się jeszcze ważniejsze w dłuższej perspektywie – weryfikacji wyników AI. Mówiąc prosto, Mira buduje infrastrukturę, która pomaga udowodnić, czy rezultat AI jest wiarygodny, powtarzalny i godny zaufania.

Na pierwszy rzut oka może to brzmieć jak mała warstwa techniczna. Ale gdy pomyślisz o tym, jak AI jest wykorzystywane dzisiaj w finansach, badaniach, automatyzacji i podejmowaniu decyzji cyfrowych, weryfikacja szybko staje się poważnym wyzwaniem.

Rośnie problem zaufania w AI

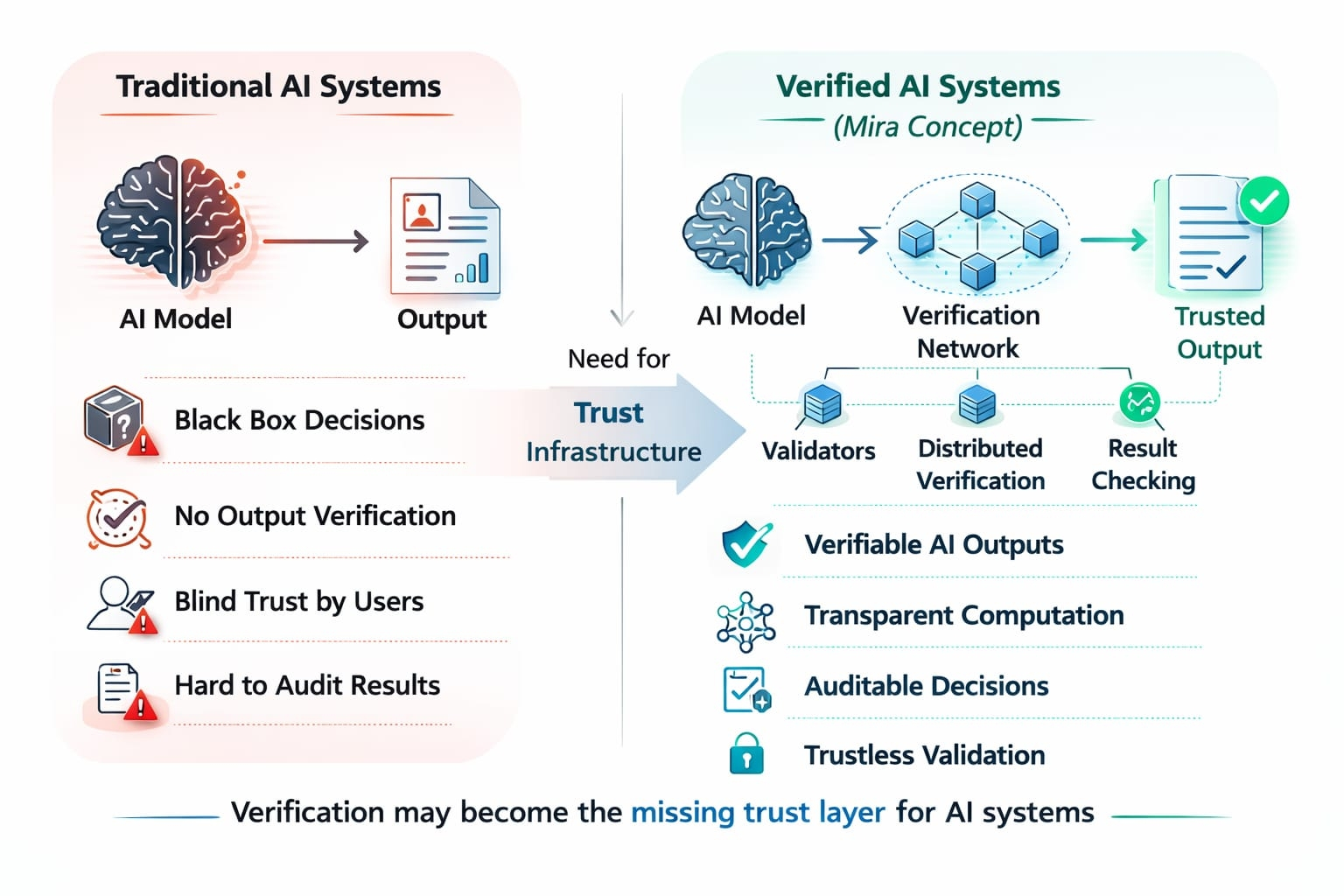

Dziś modele AI generują odpowiedzi, prognozy i decyzje w niesamowitej skali. Ale systemy, które weryfikują te wyniki, są często słabe lub całkowicie brakujące.

Na przykład, jeśli model AI generuje analizy rynkowe, spostrzeżenia medyczne lub kod, użytkownicy często muszą zaufać tym wynikom ślepo. Nawet deweloperzy czasami nie mogą w pełni wyjaśnić, jak model doszedł do swojego wyniku.

To tworzy lukę zaufania.

Mira podchodzi do tego problemu, wprowadzając warstwę weryfikacji dla wyników AI, wspieraną przez zdecentralizowaną infrastrukturę. Zamiast polegać na jednym systemie do potwierdzania wyników, sieć może weryfikować obliczenia i wyniki za pomocą rozproszonych uczestników.

Rezultatem jest struktura, w której wyniki AI mogą być sprawdzane, weryfikowane i bardziej przejrzyście ufane.

Podstawowa idea Mira: Weryfikowalna inteligencja

Centralną ideą Mira jest to, co wielu ludzi opisuje jako weryfikowalną inteligencję.

Zamiast traktować AI jako czarną skrzynkę, Mira dąży do tego, aby wyniki były możliwe do udowodnienia i audytowalne. Ta koncepcja ma ważne implikacje dla branż, w których zaufanie i dokładność mają znaczenie.

Na przykład:

• Badania lub raporty generowane przez AI mogłyby być weryfikowane przez sieć Mira.

• Modele automatycznego handlu mogłyby mieć swoją logikę zweryfikowaną.

• Agenci AI interagujący z blockchainami mogliby udowodnić swoje kroki wykonania.

To podejście ma szczególne znaczenie w środowiskach Web3, gdzie przejrzystość i bezzaufowa weryfikacja są zasadniczymi zasadami.

W wielu aspektach Mira stara się rozszerzyć te zasady na świat AI.

Infrastruktura zaprojektowana do weryfikacji AI

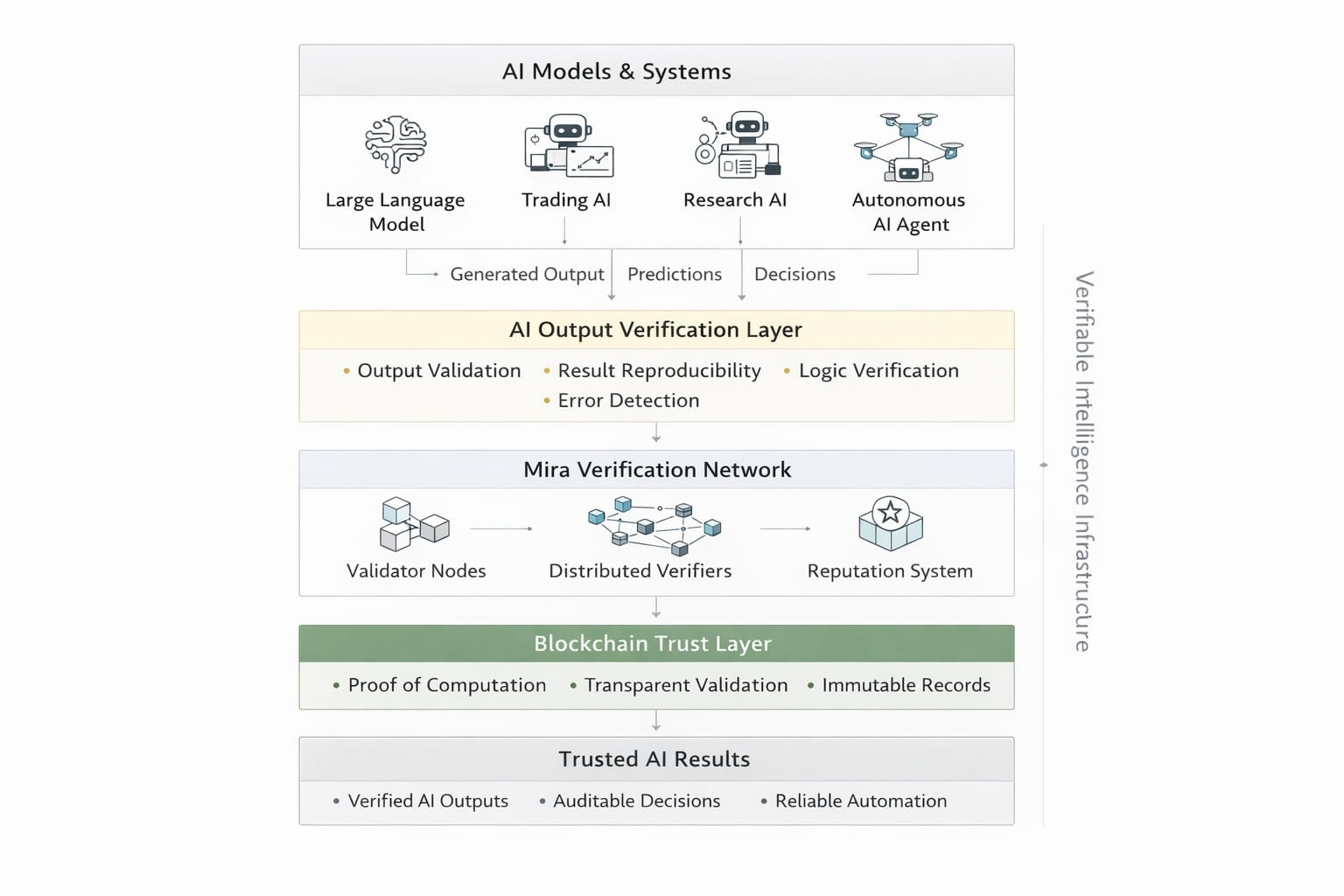

Jednym z interesujących aspektów Mira jest to, że nie jest to po prostu narzędzie lub aplikacja. Zamiast tego, jest zaprojektowane jako infrastruktura, na której mogą budować inne projekty i deweloperzy.

Z tego, co zaobserwowałem, architektura Mira koncentruje się na kilku kluczowych komponentach:

1. Sieć weryfikacyjna

Mira wprowadza sieć, w której uczestnicy pomagają w weryfikacji wyników AI. Zamiast centralnej władzy weryfikującej wyniki, rozproszone węzły przyczyniają się do procesu weryfikacji.

To sprawia, że system jest bardziej przejrzysty i odporny na manipulacje.

2. Integracja z modelami AI

Platforma została zaprojektowana, aby łączyć się z różnymi modelami i usługami AI. Oznacza to, że deweloperzy budujący aplikacje AI mogą integrować mechanizmy weryfikacji bezpośrednio w swoje procesy robocze.

Z biegiem czasu może to stworzyć szerszy ekosystem systemów AI, które potwierdzają swoje wyniki, zamiast je tylko generować.

3. Ztokenizowane zachęty

Ekosystem obejmuje również $MIRA token, który pomaga koordynować uczestnictwo w sieci. Zachęty mogą być dostosowane tak, aby walidatorzy, deweloperzy i uczestnicy przyczyniali się do utrzymania niezawodnych procesów weryfikacyjnych.

Systemy oparte na tokenach są powszechne w Web3, ale w tym przypadku służą bardzo konkretnemu celowi: zachęcaniu do dokładnej weryfikacji wyników AI.

Dlaczego to podejście ma znaczenie

Moim zdaniem najciekawszą częścią Mira nie jest tylko sama technologia, ale czas, w którym problem, który rozwiązuje, staje się istotny.

AI rozwija się szybko, a wiele branż zaczyna polegać na nim w ważnych decyzjach. Jednak systemy zapewniające poprawność tych decyzji wciąż się rozwijają.

Jeśli AI stanie się technologią podstawową dla cyfrowej gospodarki, weryfikacja może stać się równie ważna jak obliczenia.

Pomyśl, jak działa blockchain. Blockchainy nie tylko wprowadziły aktywa cyfrowe, ale także wprowadziły weryfikowalne transakcje.

Mira bada, czy podobna idea może istnieć dla wyników AI.

Potencjalne przypadki użycia

Kilka przypadków użycia mogłoby skorzystać na warstwie weryfikacyjnej Mira.

Badania AI i analiza danych

Naukowcy coraz częściej używają narzędzi AI do analizy danych lub generowania spostrzeżeń. Mira mogłaby pomóc zweryfikować, że te wyniki podążają za logicznymi zasadami reprodukcji, a nie losowej generacji.

Autonomiczne agenty AI

W miarę jak agenci AI zaczynają interagować z zdecentralizowanymi systemami, weryfikacja staje się niezbędna. Sieć Mira mogłaby zapewnić, że agenci wykonują zadania poprawnie i przejrzyście.

Systemy finansowe i handlowe

W środowiskach finansowych modele AI często podejmują prognozy lub decyzje handlowe. Mechanizmy weryfikacji mogą zapewnić dodatkową pewność, że te wyniki są ważne.

Zdecentralizowane aplikacje AI

Deweloperzy budujący aplikacje Web3 AI mogą używać Mira, aby wprowadzić warstwy zaufania do swoich systemów, czyniąc swoje produkty bardziej niezawodnymi.

Te przykłady podkreślają, dlaczego weryfikacja może stać się ważnym elementem przyszłych ekosystemów AI.

Moja osobista perspektywa na Mirę

Kiedy po raz pierwszy spojrzałem na Mirę, początkowo myślałem o niej jako o kolejnym projekcie blockchain związanym z AI. Ale po dokładniejszym zbadaniu koncepcji zacząłem postrzegać ją inaczej.

Wiele projektów koncentruje się na wzmocnieniu AI.

Mira koncentruje się na tym, aby AI było odpowiedzialne.

To rozróżnienie jest subtelne, ale ważne.

Jeśli systemy AI będą się nadal rozwijać w kluczowych obszarach, takich jak zarządzanie, finanse i automatyzacja, użytkownicy będą domagać się silniejszych gwarancji dotyczących wyników, które otrzymują. Infrastruktura weryfikacyjna może odegrać ważną rolę w zaspokajaniu tego zapotrzebowania.

Oczywiście sukces projektu takiego jak Mira będzie zależał od adopcji, udziału deweloperów i siły jego ekosystemu. Projekty infrastrukturalne często potrzebują czasu, aby dojrzeć.

Ale sama idea — budowanie warstwy weryfikacji dla AI — wydaje się zarówno praktyczna, jak i przyszłościowa.

Ostateczne myśli

Przyszłość AI może być definiowana nie tylko przez to, jak potężne stają się modele, ale także przez to, jak wiarygodne są ich wyniki.

Mira bada to wyzwanie, budując system, w którym wyniki AI mogą być weryfikowane przez zdecentralizowane sieci, zamiast opierać się na ślepym zaufaniu.

Moim zdaniem ten kierunek zasługuje na uwagę. W miarę jak AI nadal integruje się z codziennymi systemami, zdolność do weryfikacji jego decyzji może stać się jednym z najważniejszych elementów stosu technologicznego.

Projekty takie jak Mira próbują zbudować tę brakującą warstwę, a jeśli im się to uda, mogłyby cicho przekształcić sposób, w jaki ufamy inteligentnym maszynom.

@Mira - Trust Layer of AI #Mira $MIRA