Pierwszy raz, kiedy naprawdę zacząłem myśleć o weryfikacji AI, nie było to podczas jakichkolwiek badań technicznych ani głębokiej analizy kryptograficznej. To był losowy wieczór przeglądania postów generowanych przez AI. Artykuły, wykresy, nawet opinie, które wyglądały przekonująco. Zbyt przekonująco właściwie. Ten moment wydawał się dziwny. Ponieważ im potężniejsze staje się AI, tym trudniej jest wiedzieć, co jest prawdziwe, a co po prostu wygenerowane. A ten cichy problem jest dokładnie tym, gdzie sieć Mira zaczyna mieć sens. Sieć Mira to nie tylko kolejny projekt blockchainowy próbujący przyczepić się do sztucznej inteligencji. Idea za tym jest znacznie bardziej specyficzna. Skupia się na weryfikacji wyników AI. Nie na tworzeniu modeli AI. Nie na ich zastępowaniu. Ale działa jak warstwa prawdy, która sprawdza, czy informacje wygenerowane przez AI mogą być naprawdę zaufane.

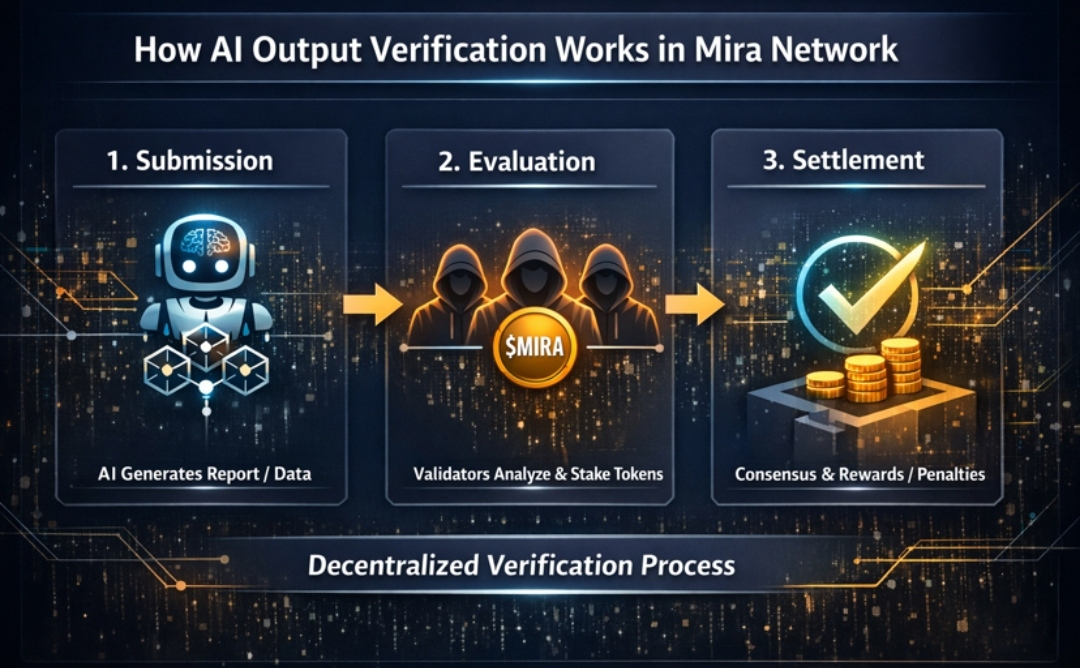

Im więcej się w to zagłębia, tym bardziej pomysł zaczyna wydawać się konieczny, a nie eksperymentalny. AI dzisiaj rozwija się niezwykle szybko. Modele generują kod, piszą podsumowania wiadomości, produkują spostrzeżenia badawcze, a nawet pomagają w decyzjach finansowych. Ale oto niewygodna część. Większość czasu po prostu ufamy wynikowi, ponieważ brzmi poprawnie. Zazwyczaj nie ma zdecentralizowanego systemu, który weryfikuje, czy ta odpowiedź jest ważna, czy nie. To jest luka, którą Mira Network próbuje wypełnić. Projekt buduje zdecentralizowaną sieć weryfikacyjną, w której niezależne węzły sprawdzają i walidują wyniki AI. Zamiast polegać na jednej scentralizowanej władzy lub firmie, kilku uczestników ocenia poprawność wyniku. Jeśli wystarczająca liczba walidatorów zgadza się, wynik staje się zweryfikowany. Jeśli się nie zgadzają, wynik jest oznaczany lub odrzucany. W prostych słowach zachowuje się niemal jak weryfikacja faktów dla sztucznej inteligencji, ale realizowana przez zdecentralizowaną infrastrukturę, a nie przez ludzkich redaktorów.

Co sprawia, że to jest interesujące, to fakt, że system nie próbuje konkurować z istniejącymi modelami AI. Mira działa na ich szczycie. Każda aplikacja AI, agent lub model teoretycznie mogłaby wysłać swoje wyniki do sieci w celu weryfikacji. Sieć następnie uruchamia procesy walidacji i zwraca wynik zaufania. Wyobraź sobie agenta AI udzielającego porady finansowej. Lub informacji medycznych. Lub zautomatyzowanych podsumowań prawnych. Zamiast ślepo ufać odpowiedzi, wynik mógłby zostać zweryfikowany przez zdecentralizowany system, taki jak Mira, przed jego użyciem. To tworzy coś, co cicho staje się bardzo ważne w erze AI — infrastrukturę zaufania. Ponieważ w tej chwili najsłabszym punktem AI nie jest jego inteligencja. To jego niezawodność. Czasami modele halucynują. Czasami generują nieaktualne dane. Czasami brzmią pewnie, podczas gdy są całkowicie błędne. A bez warstw weryfikacji te błędy rozprzestrzeniają się bardzo szybko. Mira Network stara się to spowolnić, dodając punkt kontrolny walidacji między generowaniem AI a używaniem w rzeczywistym świecie.

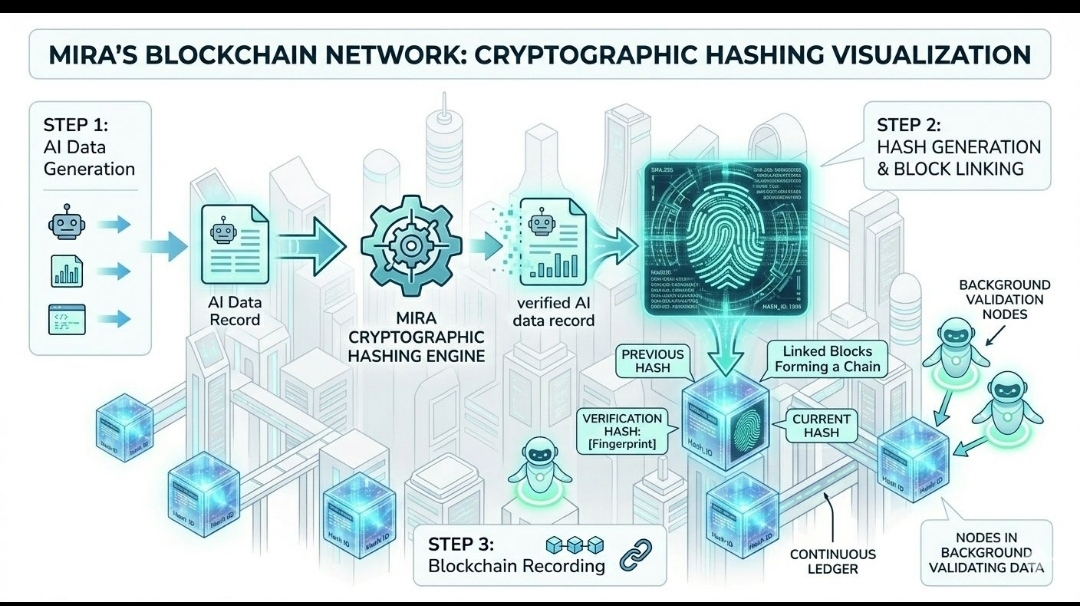

Innym aspektem, który zwrócił moją uwagę, jest pomysł agentów AI współdziałających ze sobą poprzez zweryfikowane wyniki. W miarę jak autonomiczne agenty AI stają się coraz bardziej powszechne, będą coraz bardziej polegać na innych systemach AI w zakresie danych i decyzji. Jeśli te interakcje odbywają się bez weryfikacji, błędy mogą się mnożyć niezwykle szybko. Sieć weryfikacji AA staje się niemal jak filtr komunikacyjny. Agenci AI mogą prosić o weryfikację od Mira przed zaakceptowaniem krytycznych informacji. To dodaje warstwę niezawodności między interakcjami maszyn. Z perspektywy infrastruktury kryptograficznej, Mira również wpisuje się w większy trend, który obecnie obserwujemy. Wzrost hybrydowych sieci AI + blockchain. Projekty badają zdecentralizowane obliczenia, rynki szkolenia AI, warstwy dostępności danych i systemy koordynacji agentów. Ale podejście Mira wydaje się być nieco inne. Zamiast koncentrować się na czystej mocy obliczeniowej lub tworzeniu modeli, koncentruje się na czymś bardziej subtelnym, ale potencjalnie bardziej wartościowym — weryfikacji prawdy. I szczerze mówiąc, ten problem tylko się nasili.

Internet już boryka się z dezinformacją stworzoną przez ludzi. Teraz wyobraź sobie miliardy generowanych przez AI treści pojawiających się każdego dnia. Tekst, obrazy, podsumowania badań, spostrzeżenia finansowe. Bez jakiejkolwiek infrastruktury weryfikacyjnej świat cyfrowy może stać się niezwykle hałaśliwy. Mira Network zasadniczo proponuje, aby sama weryfikacja stała się zdecentralizowaną usługą. Walidatorzy uczestniczą w sprawdzaniu wyników AI i są motywowani przez ekonomię tokenów sieci. Aplikacje, które potrzebują zweryfikowanych odpowiedzi AI, współdziałają z siecią i otrzymują wyniki walidacji. Z biegiem czasu system może ewoluować w uniwersalną warstwę dla wiarygodnych wyników AI. Oczywiście projekt jest jeszcze na wczesnym etapie i jak większość nowych infrastruktur kryptograficznych będzie musiał zmierzyć się z prawdziwymi wyzwaniami. Mechanizmy weryfikacji muszą pozostać efektywne. Walidatorzy muszą być uczciwi. A sieć potrzebuje wystarczającej adopcji ze strony aplikacji AI, aby stać się znaczącą. Ale podstawowa koncepcja wydaje się być zgodna z kierunkiem, w którym zmierza technologia.

AI staje się potężne bardzo szybko. Ale moc bez weryfikacji stwarza ryzyko. To, co proponuje Mira Network, to nie głośniejsza AI, szybsza AI, ani tańsza AI. Proponuje coś prostszego i może ważniejszego. AI, któremu można zaufać. A jeśli następna era internetu jest naprawdę napędzana przez autonomiczne agenty i informacje generowane przez maszyny, warstwa weryfikacji, taka jak Mira, może cicho stać się jednym z najważniejszych elementów infrastruktury w całym ekosystemie.

@Mira - Trust Layer of AI #Mira $MIRA