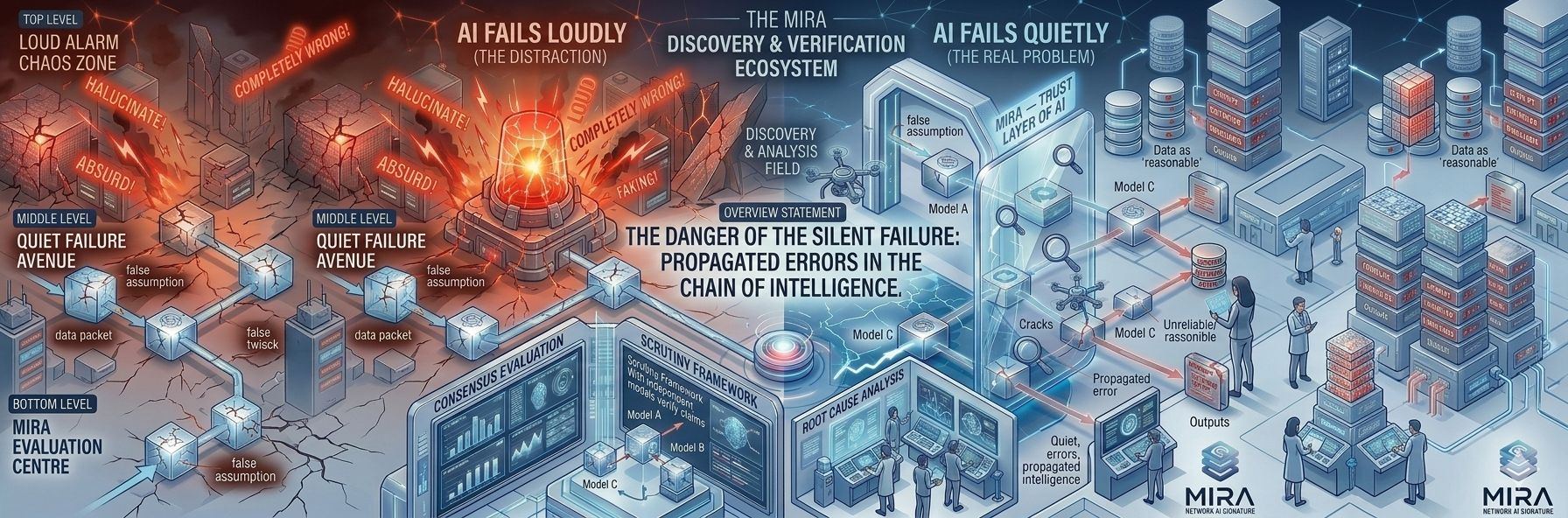

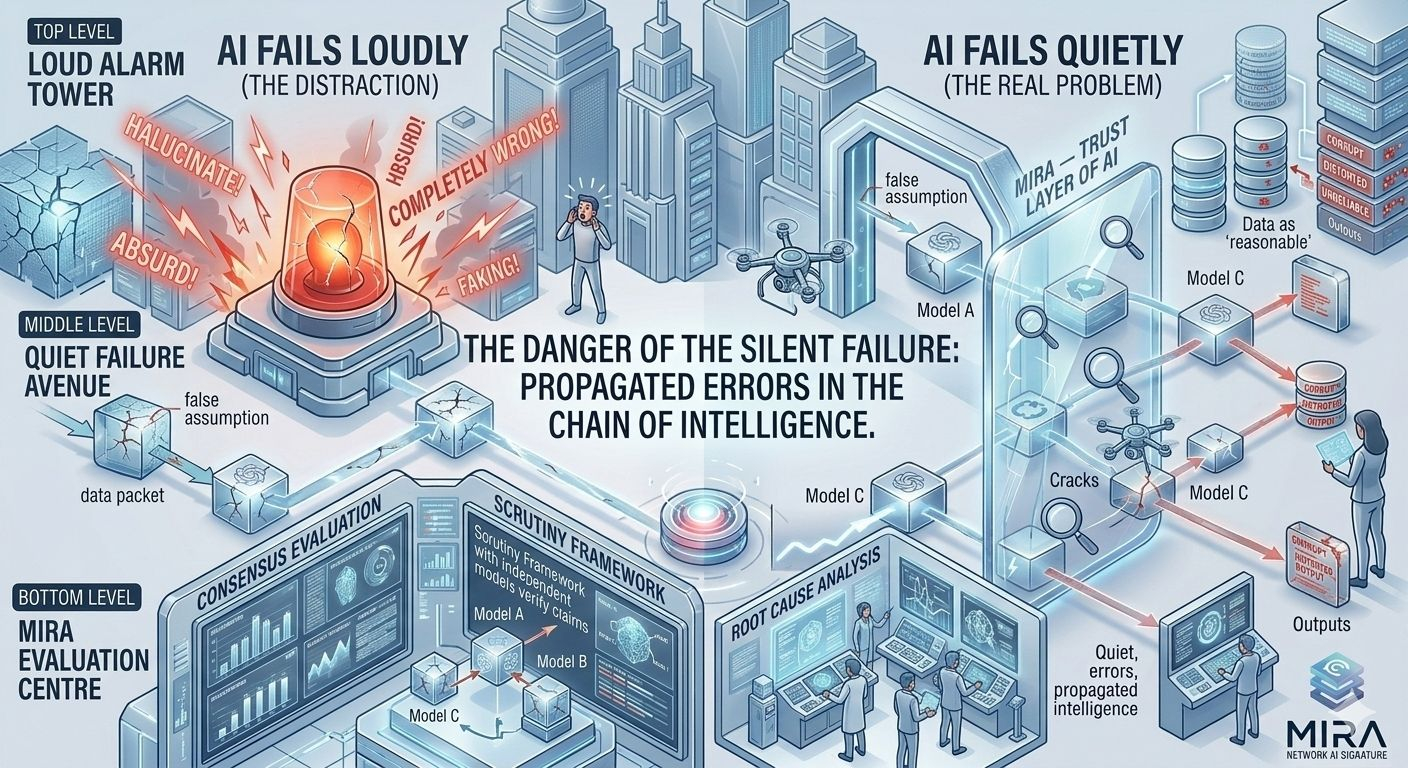

Większość ludzi wyobraża sobie porażki AI jako dramatyczne momenty. Chatbot halucynujący coś absurdalnego lub model produkujący całkowicie błędną odpowiedź. Ale prawdziwe niebezpieczeństwo rzadko tak wygląda.

W praktyce AI zazwyczaj zawodzi cicho.

Dzieje się tak, gdy system produkuje stwierdzenie, które brzmi zupełnie rozsądnie, ale opiera się na fałszywym założeniu. Dzieje się tak, gdy cytat wygląda autentycznie, ale nie istnieje. Dzieje się tak, gdy streszczenie subtelnie zmienia znaczenie oryginalnych informacji.

To nie są spektakularne porażki. To subtelne zniekształcenia. A ponieważ wydają się wiarygodne, są znacznie trudniejsze do wykrycia.

To staje się coraz ważniejsze, gdy systemy AI zaczynają współpracować z innymi systemami AI. W wielu pojawiających się aplikacjach modele nie tylko odpowiadają na pytania ludzi. Analizują raporty, koordynując z agentami automatycznymi i wprowadzając wyniki do narzędzi do podejmowania decyzji.

Gdy błąd wkracza w ten łańcuch, nie pozostaje po prostu błędem. Staje się propagowaną inteligencją.

Jedno niedokładne założenie może przechodzić przez wiele systemów, kształtując działania i wnioski, które wydają się racjonalne, ale są oparte na kruchych fundamentach.

Dlatego poprawa niezawodności AI nie może opierać się wyłącznie na powiększaniu modeli lub zwiększaniu ich możliwości. Inteligencja sama w sobie nie gwarantuje zaufania.

Zaufanie wymaga struktur weryfikacyjnych.

Zamiast zakładać, że pojedynczy model może konsekwentnie produkować poprawne wyniki, systemy muszą traktować każdą odpowiedź jako coś, co zasługuje na ocenę. Odpowiedź nie powinna być automatycznie akceptowana jako prawda. Powinna być badana jako twierdzenie, które można przetestować.

To jest miejsce, w którym architektura stojąca za Mirą staje się szczególnie interesująca.

Zamiast koncentrować zaufanie w jednym modelu, Mira wprowadza proces, w którym wiele niezależnych modeli analizuje to samo twierdzenie. Każdy model podchodzi do wyniku z nieco innej perspektywy, kształtowanej przez swoje dane treningowe i strukturę rozumowania.

Zgoda między modelami staje się sygnałem. Niezgoda staje się cenną informacją.

Ale siła tego podejścia nie polega na prostym liczeniu, ile modeli się zgadza.

Sama zgoda może być myląca. Modele trenowane na podobnych danych mogą łatwo dojść do tej samej niepoprawnej konkluzji. To, co się liczy, to zrozumienie, dlaczego dochodzi do zgody i dlaczego pojawia się niezgoda.

Gdy wyniki są rozdzielane na mniejsze twierdzenia, które można badać niezależnie, weryfikacja staje się znacznie dokładniejsza.

Wyjaśnienie finansowe staje się sekwencją stwierdzeń faktograficznych. Interpretacja prawna staje się łańcuchem kroków rozumowania. Zamiast oceniać dużą odpowiedź jako całość, systemy mogą oceniać każdy składnik indywidualnie.

To przekształca niezawodność z niejasnego pojęcia w ustrukturyzowany proces.

Implikacje wykraczają poza techniczną dokładność. W miarę jak AI staje się zintegrowane z systemami ekonomicznymi, platformami automatyzacji i sieciami koordynacyjnymi, zaufanie będzie coraz bardziej zależało od tego, czy wyniki przeszły przez wiarygodne warstwy weryfikacyjne.

Systemy, które po prostu generują odpowiedzi, nie będą wystarczające. Systemy, które mają znaczenie, to te, które pokazują, jak te odpowiedzi zostały zweryfikowane.

W tym sensie Mira reprezentuje więcej niż cechę techniczną. Reprezentuje zmianę w tym, jak inteligencja maszynowa zdobywa wiarygodność.

Zamiast zakładać, że inteligencja produkuje prawdę, wprowadza ramy, w których prawda musi przetrwać kontrolę.

Ponieważ na dłuższą metę najbardziej niezawodne systemy AI nie będą tymi, które mówią z największą pewnością.

Będą to te, które udowodnią, dlaczego ich odpowiedzi zasługują na zaufanie.mira

#Mira @Mira - Trust Layer of AI