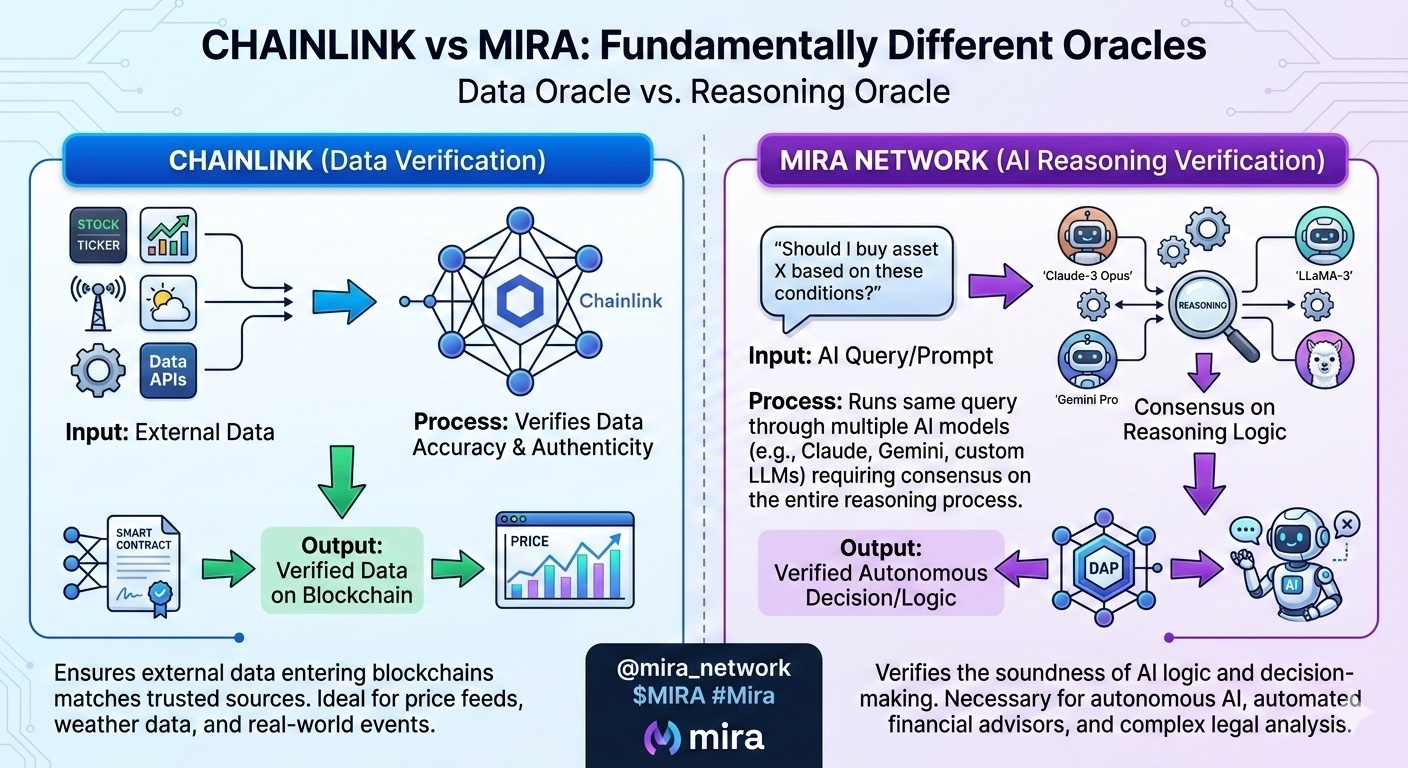

OpenAI, Anthropic i Google budują wewnętrzne systemy weryfikacji dla swoich modeli AI, zamiast integrować zewnętrzne zdecentralizowane protokoły takie jak Mira Network. Te firmy stają przed dokładnie tymi samymi problemami z niezawodnością, które $MIRA twierdzi, że rozwiązuje za pomocą weryfikacji konsensusu wielomodelowego, a mimo to inwestują miliony w rozwój własnych rozwiązań zamiast przyjąć infrastrukturę weryfikacji opartą na blockchainie. Zrozumienie dlaczego ujawnia kluczowe pytania dotyczące tego, czy zdecentralizowana weryfikacja AI rzeczywiście rozwiązuje problemy, które mają przedsiębiorstwa, w porównaniu do problemów, które zakładają projektanci protokołów.

Anthropic niedawno opublikował badania na temat „Konstytucyjnego AI”, w którym szkolą modele do weryfikacji własnych wyników poprzez strukturalną auto-krytykę i procesy doskonalenia. Podejście to utrzymuje weryfikację całkowicie w ich kontrolowanym środowisku, zamiast kierować wyniki przez zewnętrzne sieci konsensusu. Kiedy zapytałem badacza zajmującego się bezpieczeństwem AI, który znał ich pracę, dlaczego wybrali wewnętrzną weryfikację zamiast zdecentralizowanych protokołów, odpowiedź podkreśliła fundamentalne wymagania dotyczące zaufania i kontroli.

„Przedsiębiorstwa wdrażające AI w krytycznych aplikacjach potrzebują pełnej widoczności procesów weryfikacji i możliwości audytowania każdej decyzji. Zdecentralizowana weryfikacja wprowadza zależności od zewnętrznych operatorów węzłów, których zachowania nie możemy kontrolować bezpośrednio. Jeśli weryfikacja zawiedzie lub da błędne wyniki, potrzebujemy odpowiedzialności i możliwości natychmiastowego rozwiązania problemów. Zdecentralizowana konsensus czyni tę odpowiedzialność rozproszoną, a rozwiązanie problemów powolnym. Wewnętrzna weryfikacja daje nam kontrolę, której potrzebujemy do zarządzania odpowiedzialnością przedsiębiorstwa.”

To wymaganie dotyczące kontroli wykracza poza samą nadzór techniczny. Działy prawne w firmach wdrażających AI potrzebują jasnych ram odpowiedzialności, gdy AI popełnia błędy. Jeśli wewnętrznie zweryfikowane AI produkuje błędy, firma przyjmuje odpowiedzialność i może wykazać, że ich procesy weryfikacji spełniały rozsądne standardy. Jeśli zewnętrznie zweryfikowane AI przez zdecentralizowany konsensus produkuje błędy, odpowiedzialność staje się niejasna. Kto jest odpowiedzialny, gdy rozproszeni operatorzy węzłów zbiorowo zatwierdzili błędne wyniki? Prawna niejasność sprawia, że zdecentralizowana weryfikacja jest nieodpowiednia do wdrożenia w przedsiębiorstwie, niezależnie od możliwości technicznych.

Podejście Google do weryfikacji AI wykorzystuje metody zespołowe, w których wiele modeli wewnętrznych sprawdza wyniki przed ich przedstawieniem użytkownikom. Osiąga to podobne zyski w niezawodności jak wielomodelowy konsensus Miry, ale wszystko utrzymuje w infrastrukturze Google. Koszty obliczeniowe są wyższe niż w przypadku korzystania z zewnętrznych usług weryfikacyjnych, ale Google akceptuje te koszty, aby zachować pełną kontrolę nad jakością weryfikacji i audytowalnością, której wymagają klienci przedsiębiorstw.

Struktura kosztów ujawnia preferencje przedsiębiorstw. Weryfikacja Miry wymaga płacenia opłat sieciowych w tokenach $MIRA oraz dodatkowych narzutów, które dodają dostawcy usług weryfikacyjnych. Dla firm wykonujących miliony zapytań AI dziennie, te opłaty za każde zapytanie znacznie się kumulują. Budowa wewnętrznej infrastruktury weryfikacyjnej wiąże się z wysokimi kosztami początkowymi, ale niższymi kosztami marginalnymi za zapytanie. Na poziomie przedsiębiorstwa weryfikacja wewnętrzna staje się tańsza niż płacenie za usługi zewnętrzne, mimo że początkowy rozwój wymaga większej inwestycji.

Jeden z dyrektorów technologicznych w firmie świadczącej usługi finansowe wyjaśnił swoją ocenę opcji weryfikacji AI. Rozważali zdecentralizowaną weryfikację Miry obok kilku scentralizowanych usług weryfikacyjnych, zanim zdecydowali się na budowę wewnętrznych możliwości. „Trwające koszty zewnętrznych usług weryfikacyjnych nie miały sensu przy naszych wolumenach zapytań. Płacilibyśmy miliony rocznie za weryfikację, gdy moglibyśmy zbudować systemy wewnętrzne za jednorazową inwestycję wynoszącą może 3 miliony dolarów na rozwój. Ekonomia sprzyjała budowie zamiast kupowaniu, a budowa dała nam kontrolę, której potrzebowaliśmy do zapewnienia zgodności regulacyjnej.”

Perspektywa zgodności regulacyjnej stwarza dodatkowe bariery dla przyjęcia zdecentralizowanej weryfikacji. Sektory usług finansowych, opieki zdrowotnej i prawnych mają surowe przepisy dotyczące prywatności danych, które ograniczają miejsca, w których wrażliwe informacje mogą być przetwarzane. Kierowanie wynikami AI zawierającymi dane klientów przez zdecentralizowane sieci węzłów obsługiwane przez nieznanych zewnętrznych dostawców stwarza ryzyko zgodności, którego unika wewnętrzna weryfikacja. Nawet przy technikach zachowania prywatności, takich jak dekompozycja roszczeń, które stosuje Mira, zespoły ds. zgodności wolą utrzymywać całe przetwarzanie danych w kontrolowanych środowiskach.

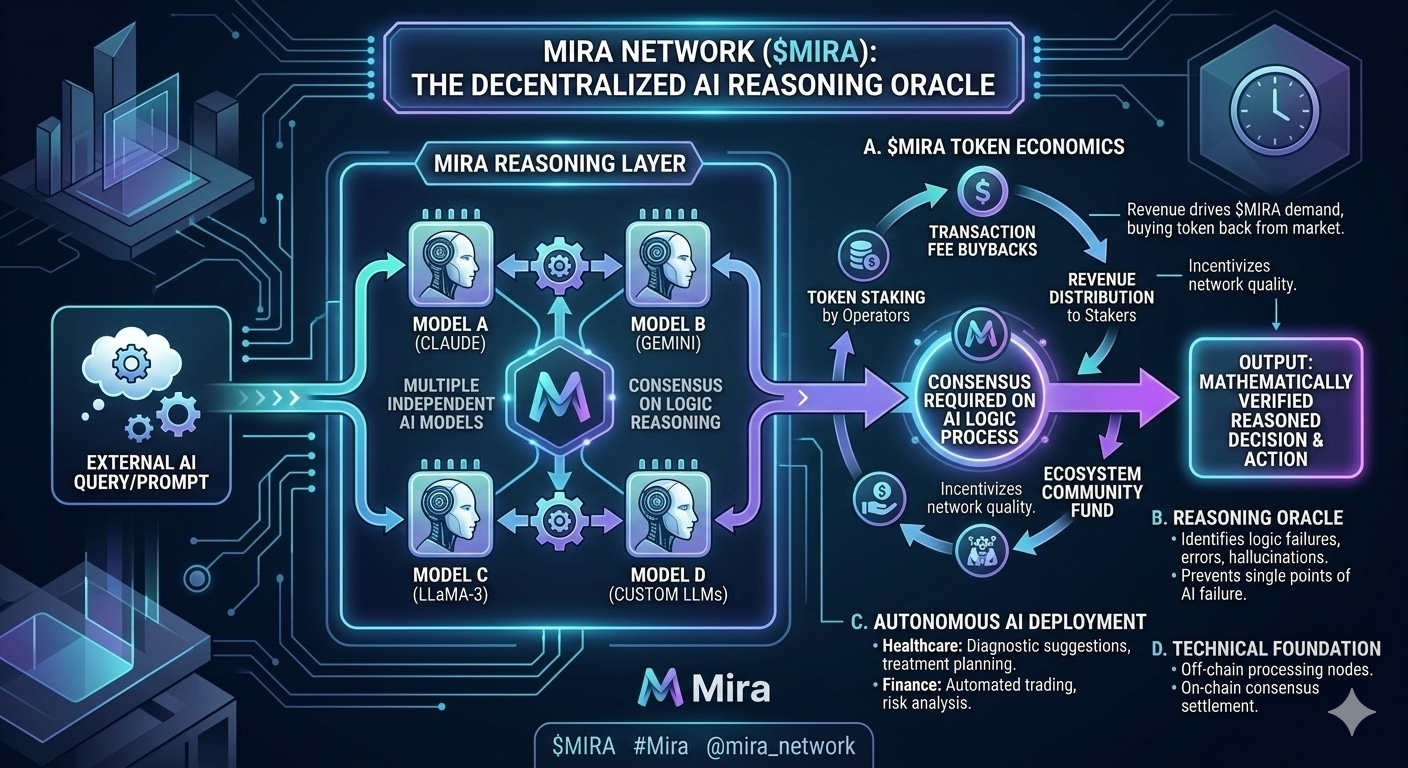

Badania przeprowadzone przez Messari wskazują, że weryfikacja Miry poprawia dokładność AI z około 70% do 96% w dziedzinach takich jak edukacja i finanse dzięki filtrowaniu konsensusu. Te zyski są znaczące, ale przedsiębiorstwa osiągają podobne poprawki poprzez wewnętrzne metody zespołowe, generację wzbogaconą o wyszukiwanie oraz weryfikację z udziałem ludzi bez zdecentralizowanej infrastruktury. Korzyści z dokładności, które zapewnia Mira, nie są unikalne dla zdecentralizowanego konsensusu - wynikają z weryfikacji wielomodelowej, którą firmy mogą wdrażać wewnętrznie.

Ekonomia operatorów węzłów również stwarza pytania o zrównoważony rozwój. Mira zachęca do uczciwej weryfikacji poprzez stakowanie tokenów $MIRA, które są zmniejszane, jeśli węzły dostarczają nieuczciwe wyniki. Działa to, jeśli wartość tokena pozostaje stabilna lub rośnie. Jeśli cena $MIRA znacznie spadnie, mechanizm stakowania osłabia się, ponieważ kary za zmniejszenie stają się mniej znaczące. Operatorzy węzłów mogą obniżyć jakość weryfikacji, gdy nagrody nie są warte kosztów obliczeniowych. Przedsiębiorstwa nie mogą zaakceptować niezawodności weryfikacji zależnej od stabilności ceny tokena, której nie kontrolują.

Wydajność cenowa tokena ujawnia rynkowy sceptycyzm wobec przyjęcia przez przedsiębiorstwa. $MIRA zadebiutował w okolicy 2,68 USD i obecnie handluje w pobliżu 0,09 USD, co stanowi spadek o 96% od szczytów. Działania cenowe sugerują, że inwestorzy kwestionują, czy przedsiębiorstwa przyjmą zdecentralizowaną weryfikację na skalę wystarczającą do wygenerowania wolumenu transakcji uzasadniającego inwestycję w infrastrukturę. Kapitalizacja rynkowa na poziomie około 19 milionów dolarów jest niewielka w porównaniu do firm AI, takich jak OpenAI, wycenianych na 80+ miliardów dolarów, które budują wewnętrzną weryfikację zamiast przyjmować zewnętrzne protokoły.

Strategia partnerstwa pokazuje, że Mira celuje w przyjęcie przez deweloperów poprzez API, a nie bezpośrednią sprzedaż przedsiębiorstwom. API Verify pozwala deweloperom integrować weryfikację wielomodelową w aplikacjach. To podejście do przyjęcia od dołu może działać, jeśli deweloperzy wybiorą weryfikację Miry zamiast alternatyw, ale stają przed tymi samymi kwestiami ekonomicznymi i kompromisami kontrolnymi, które rozważają przedsiębiorstwa. Deweloperzy budujący komercyjne aplikacje potrzebują przewidywalnych kosztów, jasnej odpowiedzialności i niezawodności weryfikacji, którą mogą zagwarantować klientom. Zdecentralizowany konsensus wprowadza niepewności wokół tych trzech kwestii, które usługi weryfikacji wewnętrznej lub scentralizowane unikają.

Dla każdego, kto ocenia $MIRA, kluczowe pytanie brzmi, czy firmy AI i deweloperzy przyjmą zdecentralizowaną weryfikację, gdy aktywnie decydują się na budowę wewnętrznych systemów weryfikacyjnych zamiast tego. Preferencja dla wewnętrznej weryfikacji nie dotyczy jakości technologii Miry - chodzi o kontrolę, odpowiedzialność, koszty i wymagania dotyczące zgodności, które podejścia zdecentralizowane z natury mają trudności w spełnieniu, niezależnie od zaawansowania technicznego. To nie jest kwestia czasu, w której przedsiębiorstwa ostatecznie przyjmują zewnętrzną weryfikację, gdy infrastruktura dojrzeje. To fundamentalna niezgodność wymagań, w której przedsiębiorstwa potrzebują rzeczy, których zdecentralizowana weryfikacja nie może zapewnić z samej swojej natury.