Kiedy AI się nie zgadza, zaufanie się pojawia:

Rewolucja Odpowiedzialności Multi-Model Mira

Zdefiniowany Artykuł dla Maksymalnego Wpływu

@Mira - Trust Layer of AI #Mira

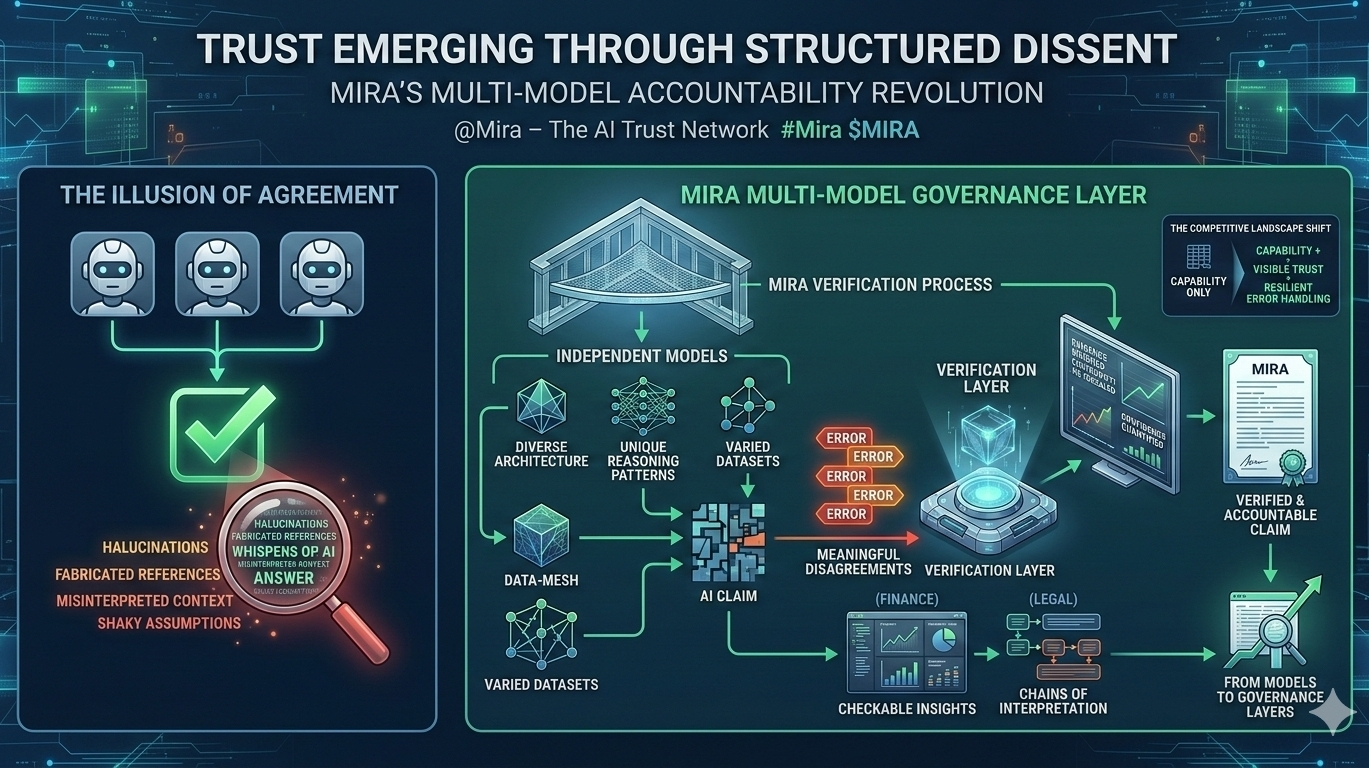

Niezawodność w AI nie polega na jednomyślności – chodzi o to, jak systemy radzą sobie z odmową. Zgoda może wydawać się uspokajająca, ale może ukrywać subtelne wady: błędnie interpretowane fakty, sfałszowane odniesienia lub pewne, ale chwiejne rozumowanie. Prawdziwe zaufanie pojawia się, gdy niezgoda jest uporządkowana, widoczna i weryfikowalna.

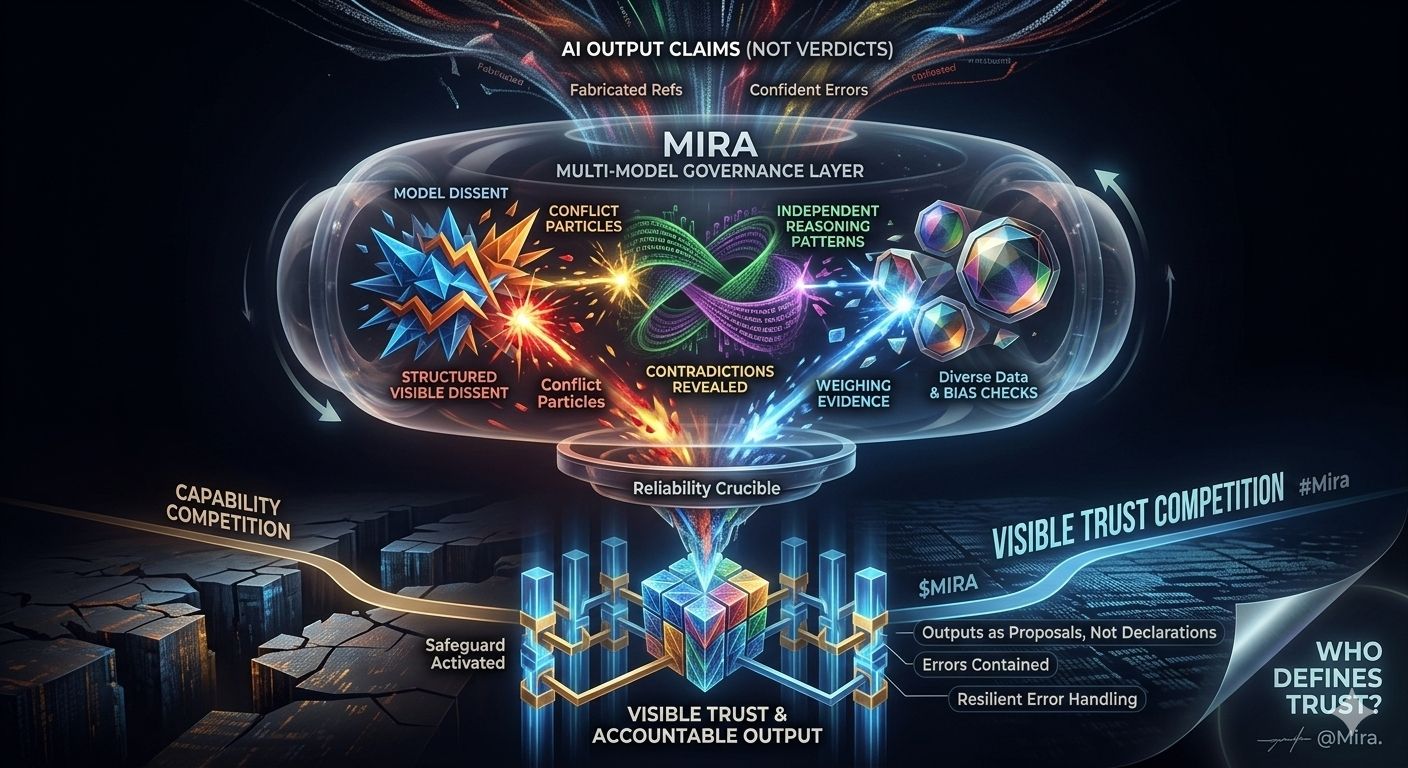

Większość awarii AI to subtelne szepty: klauzula błędnie zinterpretowana, kontekst pominięty, pewny wynik oparty na chwiejnych założeniach. Samokorekta jednego modelu często wzmacnia te same błędy. Mira zmienia ten paradygmat: każdy wynik AI to twierdzenie, a nie wyrok. Wiele niezależnych modeli bada to twierdzenie, każdy wnosi różnorodne dane, wzorce rozumowania i uprzedzenia architektoniczne. Weryfikacja nie polega na najgłośniejszym modelu – chodzi o to, jak dowody są oceniane, sprzeczności ujawniane i pewność kwantyfikowana.

Konsensus jest złożony. Dwa modele mogą się zgadzać, podczas gdy jeden się sprzeciwia—czy odmieniec dostrzega prawdziwą wadę, czy halucynuje? System Miry identyfikuje istotne niezgody w przeciwieństwie do szumów. Złożone wyniki rozkładają się na weryfikowalne stwierdzenia: podsumowania finansowe stają się sprawdzalnymi wglądami, argumenty prawne przekształcają się w ciągi interpretacji. Modele nie muszą być mądrzejsze—roszczenia stają się testowalne i odpowiedzialne.

Zaufanie przesuwa się z modeli na warstwy zarządzania. Wyniki są wiarygodne nie dlatego, że model tak stwierdził, ale dlatego, że niezależne systemy osiągnęły zgodne wnioski. Przejrzystość jest kluczowa: nakładające się dane lub podobne architektury mogą zniekształcać konsensus, więc różnorodność jest zabezpieczeniem wiarygodności.

Weryfikacja wiąże się z kosztami—opóźnieniami, obliczeniami, nadzorem ludzkim. Aplikacje integrujące AI stają się teraz orkiestratorami wiarygodności, zarządzając kompromisami między prędkością a pewnością. To przekształca konkurencyjny krajobraz: AI będzie konkurować nie tylko na podstawie zdolności, ale także na podstawie widocznego zaufania, ustrukturyzowanej niezgody i odpornych na błędy procesów.

Wielomodelowe zarządzanie Miry to więcej niż funkcjonalność—jest to warstwa odpowiedzialności. Wyniki AI stają się propozycjami, a nie deklaracjami. Błędy są nieuniknione, ale system je ogranicza, zanim przekształcą się w decyzje rynkowe lub publiczną dyskusję.

Ostateczne pytanie: kto definiuje zaufanie, jak interpretowana jest niezgoda i które zabezpieczenia aktywują się, gdy konsensus się chwieję? To jest miejsce, gdzie wiarygodność AI naprawdę istnieje.

$MIRA