Większość ludzi zakłada, że największym wyzwaniem AI jest inteligencja. W rzeczywistości wyzwaniem zawsze było zaufanie. Duże modele mogą generować pewne odpowiedzi, ale pewność nie równa się poprawności. Subtelne błędy — źle odczytane fakty, sfałszowane cytaty lub niekompletne rozumowanie — prześlizgują się cicho i rzadko ogłaszają się głośno.

Te błędy nie są katastrofalne indywidualnie. Jednak w systemach finansowych inteligentne kontrakty lub autonomiczne sieci, nawet małe przeoczenia mogą prowadzić do realnych konsekwencji. I dokładnie dlatego poleganie na jednym modelu jest kruchą strategią.

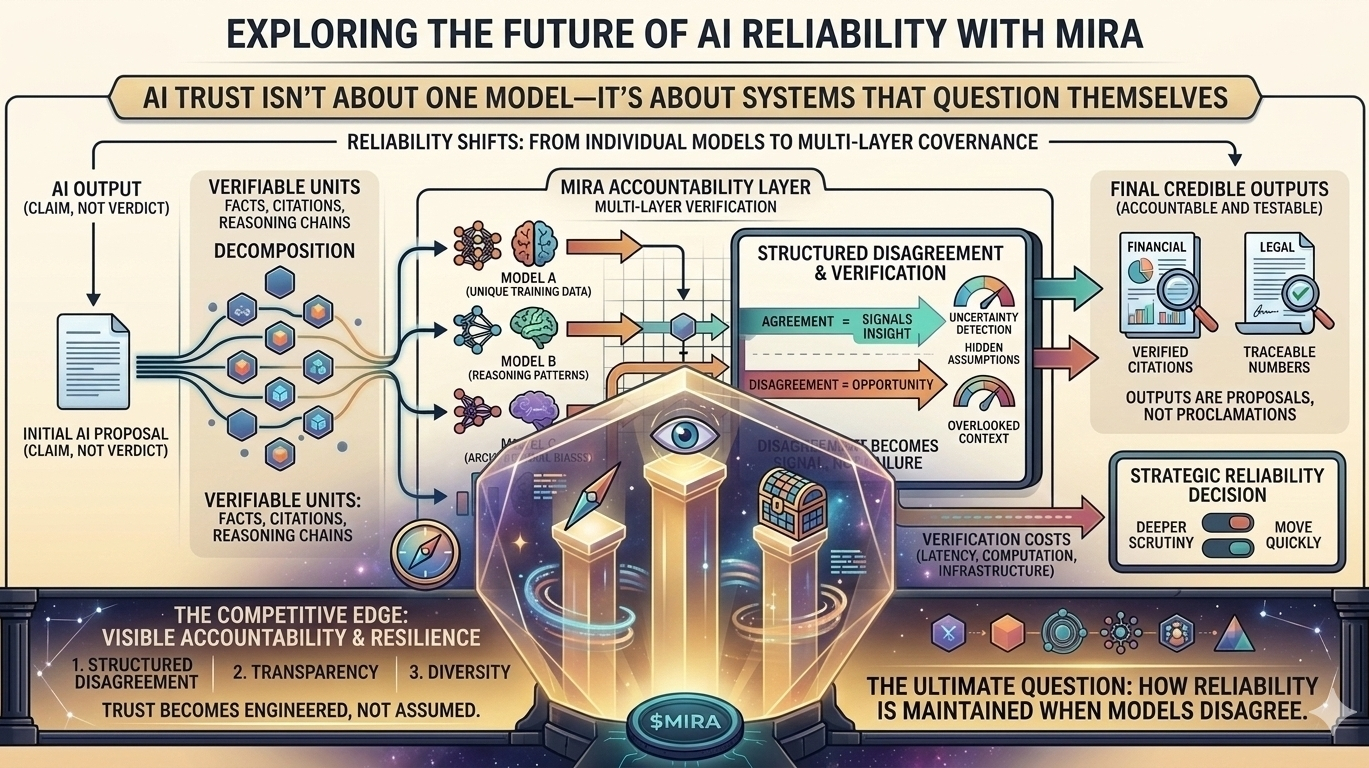

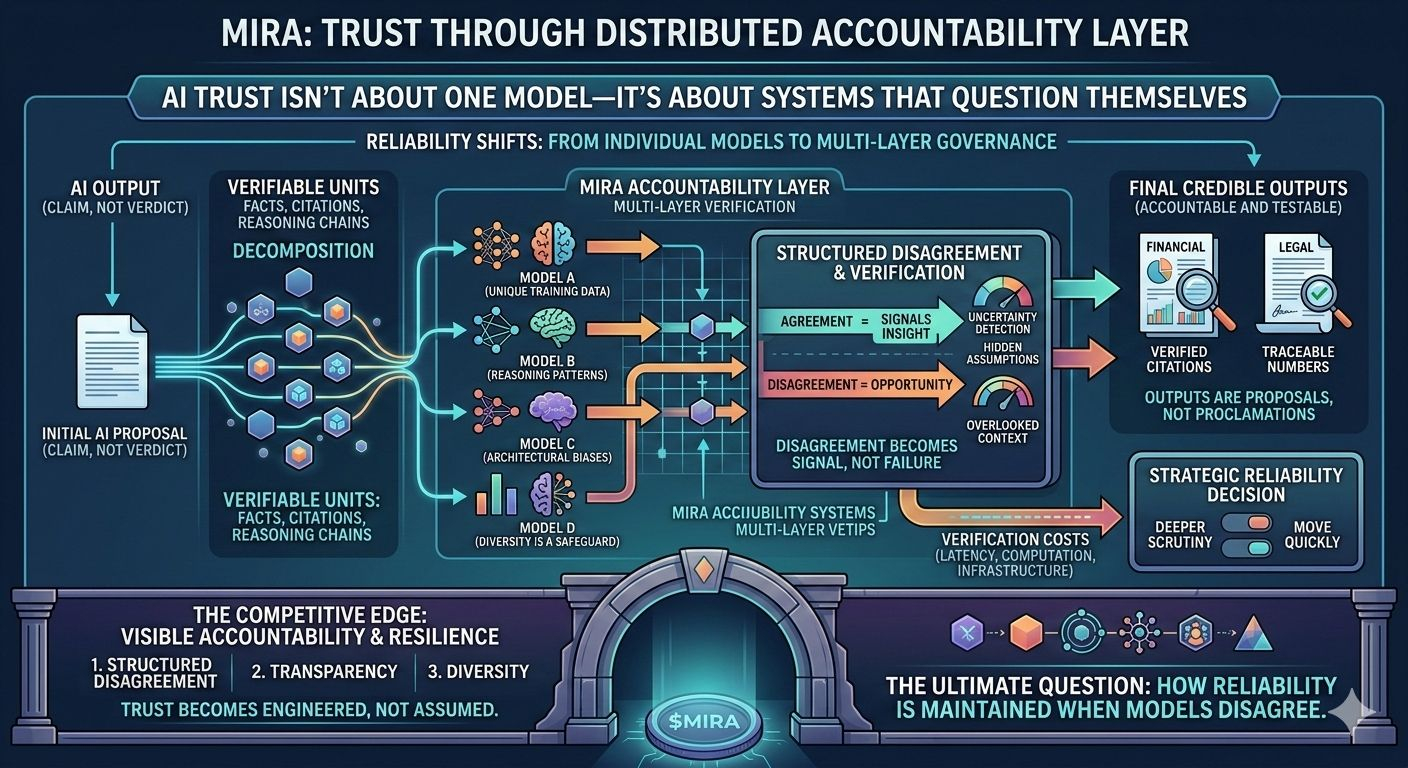

Mira wprowadza nowy sposób: traktuj każdy wynik jako roszczenie, a nie werdykt. Wiele niezależnych modeli ocenia to samo roszczenie, każdy przynosząc unikalne dane treningowe, wzorce rozumowania i architektoniczne uprzedzenia. Zgoda sygnalizuje wgląd, ale niezgoda sygnalizuje możliwość — możliwość wykrycia niepewności, ukrytych założeń lub pominiętego kontekstu.

W praktyce wyniki są dzielone na weryfikowalne jednostki. Złożone podsumowanie finansowe staje się możliwymi do prześledzenia liczbami. Interpretacja prawna przekształca się w łańcuch rozumowania. AI nie staje się magicznie mądrzejsze — jego roszczenia stają się odpowiedzialne i testowalne.

Zaufanie przesuwa się od indywidualnych modeli w kierunku wielowarstwowego zarządzania. Wyniki są wiarygodne nie dlatego, że model je wygenerował, ale dlatego, że niezależne systemy osiągnęły kompatybilne wnioski. Przezroczystość jest kluczowa: nakładające się zbiory danych lub podobne architektury mogą biasować konsensus, więc różnorodność jest zabezpieczeniem niezawodności.

Weryfikacja ma swoje koszty — opóźnienie, obliczenia i infrastrukturę. Aplikacje integrujące te warstwy muszą zdecydować, które roszczenia wymagają głębszej analizy, a które mogą poruszać się szybko. Niezawodność nie jest już pasywną cechą; to strategiczna decyzja osadzona w projektowaniu systemu.

Przewaga konkurencyjna dla następnej generacji AI nie będzie pochodzić od tego, kto odpowiada najszybciej lub brzmi najinteligentniej. Będzie pochodzić z widocznej odpowiedzialności, uporządkowanej niezgody i odporności w obliczu błędów.

Wielomodelowe zarządzanie Miry to nie tylko funkcja — to warstwa odpowiedzialności dla inteligencji maszynowej. Wyniki stają się propozycjami, a nie ogłoszeniami. Niezgoda staje się sygnałem, a nie porażką. Zaufanie staje się zaprojektowane, a nie zakładane.

Ostateczne pytanie nie brzmi, czy modele się zgadzają. Chodzi o to, kto interpretuje niezgodę, jakie zabezpieczenia są aktywowane i jak utrzymywana jest niezawodność. To jest świat, w którym AI może być naprawdę godne zaufania.

#Mira

@Mira - Trust Layer of AI