Napisane przez zespół Qubic Scientific

Komentarz do najnowszego artykułu Nicka Bostroma autorstwa zespołu Qubic Scientific

Reformowanie debaty na temat superinteligencji: chirurgia, a nie ruletka

Właśnie opublikował nowy artykuł roboczy, Optymalne momenty dla superinteligencji: Mundane Considerations for Existing People (2026), w którym przesuwa centralne pytanie. Zamiast pytać, czy powinniśmy rozwijać superinteligencję, Bostrom koncentruje się na tym, kiedy jest to optymalne. Dla każdego, kto śledzi szybko rozwijający się intersection AI i blockchain, jego ramy mają głębokie implikacje dla tego, jak projektujemy infrastrukturę, która będzie wspierać sztuczną inteligencję ogólną (AGI).

Przeformułowanie debaty na temat superinteligencji: chirurgia, a nie ruletka

Punktem wyjścia pracy Bostroma jest zarówno elegancki, jak i zakłócający. Przeformułowuje on całkowicie spolaryzowaną debatę „AI tak vs. AI nie”. Rozwój superinteligencji, argumentuje, nie jest jak gra w rosyjską ruletkę. To bardziej jak przeprowadzanie ryzykownej operacji w przypadku, który już jest śmiertelny.

Jaki jest ten stan? Aktualny stan ludzkości. Weź pod uwagę punkt odniesienia: codziennie umiera około 170 000 osób z powodu starzenia się, chorób i awarii systemowych. Starzejąca się globalna populacja staje w obliczu nieodwracalnego biologicznego pogorszenia. Nieuleczalne choroby, w tym nowotwory, choroby neurodegeneracyjne i sercowo-naczyniowe, nadal obciążają miliony. Stajemy w obliczu niezmiennych globalnych ryzyk, od niestabilności klimatycznej, przez systemową korupcję instytucjonalną, po erozję jakości demokracji. Pandemie, wojny i upadek całych systemów pozostają ciągłymi zagrożeniami.

Biorąc pod uwagę te rzeczywistości, Bostrom argumentuje, że przedstawienie wyboru jako „zero ryzyka bez AI” w porównaniu do „ekstremalne ryzyko z superinteligencją” jest uproszczone. Bardziej rygorystyczne pytanie brzmi: Która trajektoria generuje większą oczekiwaną długość życia i większą jakość życia dla ludzi, którzy już istnieją?

Zakotwiczając swoją analizę w rzeczywistych, obecnych warunkach życia ludzkiego, Bostrom omija filozoficzne abstrahowania i teologiczne spekulacje. Mówi o tobie, twojej rodzinie i ludziach żyjących w tej chwili.

Oczekiwana długość życia, ryzyko śmierci i przypadek dla ogólnej inteligencji sztucznej

Gdy jesteśmy młodzi, roczne ryzyko śmierci jest niezwykle niskie. Biologicznie, w większości przypadków jesteśmy daleko od śmierci. Ale w miarę starzenia się prawdopodobieństwo śmierci nieustannie rośnie z powodu biologicznego pogorszenia.

Jeśli superinteligencja mogłaby radykalnie zmniejszyć lub nawet wyeliminować starzenie się, jak proponuje Bostrom, twoje roczne ryzyko śmierci pozostałoby na poziomie zdrowej młodej osoby. Twoja śmiertelność przestałaby rosnąć w czasie. W takim scenariuszu oczekiwana długość życia staje się niezwykle długa.

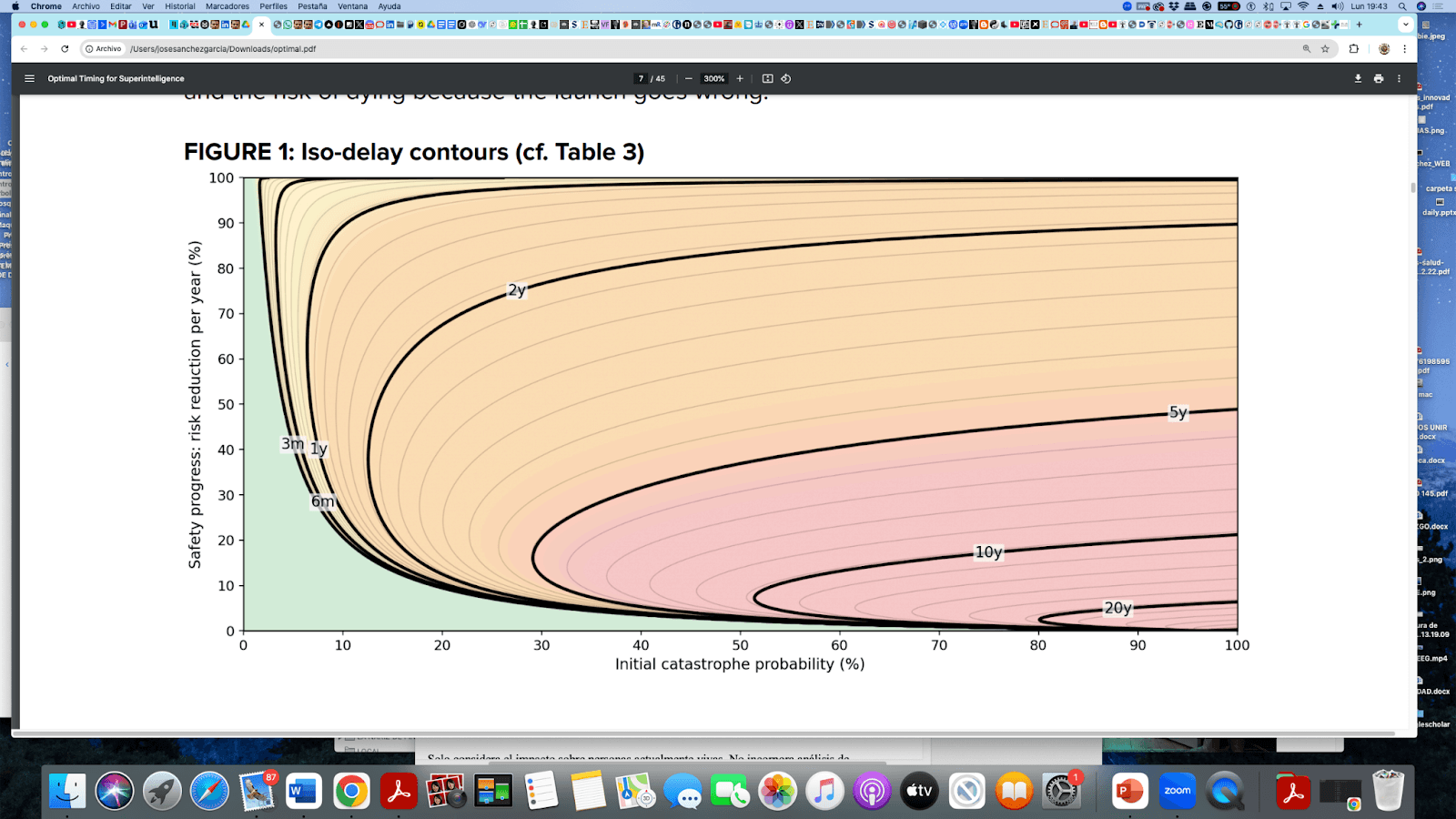

Z tej perspektywy oczekiwana wartość superinteligencji rekompensuje jej wysokie ryzyka. Ale co się stanie, jeśli opóźnimy, aż technologia stanie się idealnie „bezpieczna”? Co się stanie, jeśli z każdym mijającym rokiem kumulujemy prawdopodobieństwo śmierci? Pytanie brzmi: czy bardziej racjonalne jest zaakceptowanie prawdopodobieństwa katastrofy z wcześniejszego wdrożenia, biorąc pod uwagę, że postęp w zakresie bezpieczeństwa AI jest wykładniczy, czy zaakceptowanie pewności skumulowanych zgonów z opóźnienia?

Dyskontowanie czasowe i koszt czekania

Bostrom wprowadza pojęcie dyskontowania czasowego (ρ), dobrze zbadanej zasady w teorii podejmowania decyzji. Ludzie systematycznie cenią obecne wyniki bardziej niż przyszłe. Dlatego pozostajemy w niezadowalających pracach, relacjach i wzorach: wysiłek zmiany wydaje się duży, a nagroda odległa.

Ale tutaj występuje interesująca inwersja. Jeśli życie po AGI nie jest jedynie dłuższe, ale dramatycznie lepsze, z radykalnymi poprawkami w zdrowiu, zdolności poznawczej i jakości życia, to czasowa dyskontacja faktycznie karze czekanie. Każdy rok opóźnienia to rok spędzony w jakościowo gorszym stanie, gdy dostępny jest znacznie lepszy stan.

Jakość życia i awersja do ryzyka w wdrożeniu AGI

Model Bostroma nie zakłada samej długowieczności. Uwzględnia znaczące poprawki w dobrostanie. Jeśli jakość życia podwaja się po przejściu do superinteligencji, równowaga przesuwa się zdecydowanie w kierunku wcześniejszego wdrożenia. Następnie dodaje metryki awersji do ryzyka (CRRA i CARA), uznając, że jeśli jesteśmy bardziej wrażliwi na ekstremalne straty, okno, w którym „uruchom teraz” pozostaje zalecane, zwęża się, a optymalne opóźnienia wydłużają.

To nie jest lekkomyślne przyspieszanie. To jest skoordynowane podejmowanie decyzji w warunkach niepewności, rodzaj analizy, która powinna informować, jak rządzimy drogą do ogólnej inteligencji sztucznej.

Dwufazowe wdrożenie: Szybko do portu, wolno do przystani

Jednym z najsilniejszych wkładów pracy jest podział przejścia AGI na dwie odrębne fazy:

Faza 1: Osiągnięcie zdolności AGI. Poruszaj się tak szybko, jak to odpowiedzialne, w kierunku zbudowania systemu, który demonstruje ogólną inteligencję.

Faza 2: Strategiczna przerwa przed pełnym wdrożeniem. Gdy system istnieje, wprowadź kontrolowane opóźnienie, aby go zbadać, przetestować w rzeczywistych warunkach i rozwiązać problemy techniczne dotyczące bezpieczeństwa, które wcześniej były jedynie teoretyczne.

Hipoteza Bostroma jest taka, że gdy system AGI rzeczywiście istnieje, następuje „okazja do bezpieczeństwa”. Badacze mogą obserwować rzeczywiste zachowanie, a nie spekulować na jego temat. Postęp w zakresie bezpieczeństwa przyspiesza w sposób dramatyczny, ponieważ problemy stają się empiryczne, a nie abstrakcyjne. Motto, które wprowadza: szybko do portu, wolno do przystani.

Kto czerpie największe korzyści z wcześniejszej transformacji do superinteligencji?

Bostrom nie traktuje optymalnego czasu jako uniwersalnego. Starsi ludzie, poważnie chorzy i ci żyjący w niepewnych warunkach mają mniej oczekiwanych lat życia. Dla nich potencjalna korzyść z szybkiej transformacji do superinteligencji jest znacznie większa. Młodsi ludzie, mający przed sobą dziesięciolecia, mogą tolerować dłuższe czekanie.

Jeśli zastosujesz logikę priorytetową, nadając większą wagę tym, którzy są w gorszej sytuacji, optymalny harmonogram przesuwa się do przodu. Bostrom również wyraźnie odrzuca powszechne założenie, że po pewnym wieku dodatkowe życie nie dodaje żadnej wartości. Ten osąd, argumentuje, ma swoje źródło w naszym doświadczeniu obecnego starzenia się i pogorszenia. Nie uwzględnia scenariusza prawdziwego odmłodzenia, jednego z centralnych obietnic superinteligentnej przyszłości.

Ryzyka instytucjonalne: Dlaczego infrastruktura zarządzania AI ma znaczenie

W ostatnich częściach swojej pracy Bostrom wprowadza krytyczne ostrzeżenia instytucjonalne. Najbardziej rozsądny scenariusz, jak sugeruje, to taki, w którym technologiczny lider wykorzystuje swoją przewagę dla bezpieczeństwa. Ale również sygnalizuje niebezpieczeństwa krajowych moratoriów, międzynarodowych zakazów i konkurencyjnych dynamik, które pojawiają się, gdy wiele podmiotów ściga się w kierunku AGI pod presją geopolityczną.

Jego analiza zakłada w sposób niejawny ekosystem, w którym moc obliczeniowa ma tendencję do koncentracji. W takim środowisku ryzyka się kumulują: militaryzacja zasobów obliczeniowych, nadmiar obliczeń (ogromne rezerwy gotowe do aktywacji pod presją konkurencyjną) oraz wypaczone zachęty ekstremalnej centralizacji. To nie są abstrakcyjne obawy. Obecna trajektoria rozwoju AI, zdominowana przez garstkę dostawców chmurowych hyperskalowych i korporacyjnych laboratoriów, tworzy dokładnie tę koncentrację.

Implikacje dla Qubic: Dlaczego zdecentralizowana infrastruktura AI zmniejsza ryzyko egzystencjalne

Jeśli traktujemy ramy Bostroma poważnie, podstawowe pytanie przesuwa się z „kiedy uruchomić AGI” na to, jaki rodzaj infrastruktury zmniejsza ryzyka związane z tym uruchomieniem. To jest miejsce, w którym architektura Qubic staje się bezpośrednio istotna dla globalnej rozmowy na temat bezpieczeństwa superinteligencji.

Problem centralizacji w obecnym rozwoju AI

Jeżeli superinteligencja jest budowana na scentralizowanych infrastrukturach, zależnych od ogromnych centrów danych, nieprzezroczystych procesów szkoleniowych i korporacyjnej kontroli, profil ryzyka rozszerza się poza czysto techniczne. Staje się geopolityczny. Koncentracja obliczeń sprawia, że rodzaj adaptacyjnego zarządzania, który Bostrom uznaje za niezbędny w krytycznej fazie przed wdrożeniem, staje się znacznie trudniejszy. Tworzy to również dokładnie ten rodzaj nadmiaru obliczeń, o którym ostrzega: ogromne rezerwy obliczeniowe gotowe do aktywacji jednocześnie pod presją konkurencyjną.

Jak architektura rozproszonego obliczania Qubic odpowiada na te ryzyka

Qubic rozprasza ten strukturalny wąski gardło. Jego architektura rozkłada moc obliczeniową na globalną sieć, a nie koncentruje ją w jednym węźle. Qubic nie polega na architekturze typu LLM, która jest trenowana nieprzejrzysto w mega centrach danych. Zamiast tego wykorzystuje Użyteczny Dowód Pracy (uPoW), gdzie górnicy przyczyniają się do rzeczywistego obliczenia w szkoleniu rdzenia AI, Aigarth, zamiast rozwiązywać arbitralne zagadki haszowe.

Ten wybór projektowy ma bezpośrednie konsekwencje dla analizy Bostroma. Mniej scentralizowana infrastruktura zmniejsza prawdopodobieństwo nagłych, konkurencyjnych scenariuszy wdrożeniowych, przed którymi ostrzega. Rozproszone obliczenia oznaczają, że moc nie znajduje się w jednej placówce, która może zostać militarnie przejęta, ani w korporacyjnym laboratorium pod jednostronną kontrolą. Taka strukturalna odporność rozszerza przestrzeń dla Fazy 2 Bostroma: strategicznej przerwy, w której mogą wystąpić prawdziwe testy, stopniowe poprawy i adaptacyjne zarządzanie przed pełnym wdrożeniem.

Aby lepiej zrozumieć, jak podejście Qubic do AI różni się od głównych modeli, zbadaj Neuraxon: Wielki Skok Qubic w kierunku żywej, uczącej się AI oraz niedawna analiza, że statyczna AI to ślepa uliczka. Google potwierdza.. Te posty pokazują, jak Qubic buduje inteligencję w zupełnie innej paradygmacie: zaprojektowanej do ciągłego uczenia się, rozproszonej odporności i adaptacji do rzeczywistości w zdecentralizowanej sieci.

Zdecentralizowana AI i Blockchain: Strukturalne dostosowanie do bezpieczeństwa AGI

Z perspektywy Bostroma potencjał Qubic nie polega jedynie na byciu „zdecentralizowanym” jako ćwiczenie brandingowe. Polega na modyfikowaniu strukturalnych zmiennych, które decydują o optymalnym czasie wdrożenia superinteligencji. Poprzez rozproszenie obliczeń, budowanie protokołów konsensusu, które dostosowują zachęty górników do prawdziwego szkolenia AI, oraz sprawienie, że cały proces jest otwartoźródłowy i audytowalny, Qubic tworzy rodzaj infrastruktury, która sprawia, że przejście do AGI jest strukturalnie bezpieczniejsze.

Jeśli interesuje cię, jak model wydobycia CPU Qubic i rozproszona sieć obliczeniowa ewoluują, głęboka analiza wydobycia Dogecoina na Qubic wyjaśnia najnowszą ekspansję Użytecznego Dowodu Pracy, a Wizja Qubic 2026 szczegółowo opisuje szerszy plan infrastrukturalny, który jest obecnie w toku.

Najtrudniejszy problem: Budowanie AGI, która uczy się ze świata

Wyobrażanie sobie utopijnych i dystopijnych scenariuszy jest wartościowe. Jest to w rzeczywistości najlepsza droga do tworzenia przyszłości dostosowanych do ludzkich potrzeb i wartości. Ale odwracanie wzroku, czekanie bez celu lub przyspieszanie bez ograniczeń wszystkie zawodzą w zapewnieniu niezbędnych refleksji.

Być może najtrudniejszym wyzwaniem obecnie nie jest tak bardzo rozważenie ryzyka przyspieszenia transformacji i modelowania go. Na razie najtrudniejsze zadanie to zbudowanie ogólnej sztucznej inteligencji zdolnej do samodzielnego uczenia się z różnych dynamicznych środowisk, tworzenia reprezentacji świata i działania w nim. To właśnie jest wyzwanie, które framework Neuraxon Qubic ma na celu adresować, nie przez trenowanie na statycznych zbiorach danych za zamkniętymi drzwiami, ale przez ewolucję na zewnątrz, ucząc się z rzeczywistej złożoności w zdecentralizowanej sieci, w której każdy może uczestniczyć.

Bibliografia i źródła

1. Bostrom, N. (2026). Optymalny czas na superinteligencję: Zwyczajne rozważania dla istniejących ludzi. Praca robocza, v1.0.

https://nickbostrom.com/optimal.pdf

2. Bostrom, N. (2014). Superinteligencja: Ścieżki, zagrożenia, strategie. Oxford University Press.

3. Bostrom, N. (2003). Astronomiczne marnotrawstwo: Koszt możliwości opóźnionego rozwoju technologicznego. Utilitas, 15(3), 308–314.

4. Yudkowsky, E. & Soares, N. (2025). Jeśli ktokolwiek to zbuduje, wszyscy umierają.

5. Hall, R. E. & Jones, C. I. (2007). Wartość życia i wzrost wydatków na zdrowie. Kwartalnik Ekonomiczny, 122(1), 39–72.

6. Zespół naukowy Qubic. Neuraxon: Wielki Skok Qubic w kierunku żywej, uczącej się AI.

https://qubic.org/blog-detail/neuraxon-qubic-s-big-leap-toward-living-learning-ai

7. Dyskusja społeczności LessWrong: Optymalny czas na superinteligencję

https://www.lesswrong.com/posts/2trvf5byng7caPsyx/optimal-timing-for-superintelligence-mundane-considerations