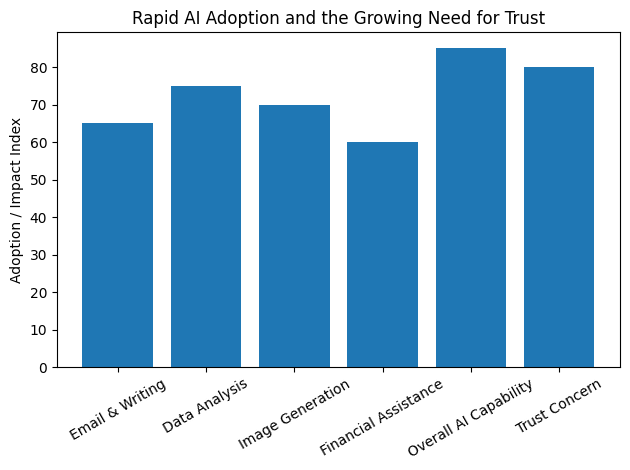

Czasami siadam i myślę o tym, jak bardzo świat się zmienił w ciągu zaledwie kilku lat. Technologia, która kiedyś wydawała się science fiction, jest teraz częścią codziennego życia. Sztuczna inteligencja jest jednym z największych przykładów tej transformacji. Pisze e-maile, wyjaśnia złożone tematy, generuje obrazy, analizuje dane, a nawet pomaga ludziom podejmować decyzje finansowe. To, co kiedyś wymagało ekspertów i godzin pracy, teraz może się zdarzyć w ciągu sekund.

Obserwowanie tego postępu jest ekscytujące. Co miesiąc systemy AI stają się mądrzejsze i bardziej zdolne. Ale gdy patrzę, jak ta technologia rośnie, jedno pytanie ciągle wraca mi do głowy. Jeśli AI ma kierować ważnymi decyzjami, jak możemy wiedzieć, kiedy tak naprawdę mówi prawdę?

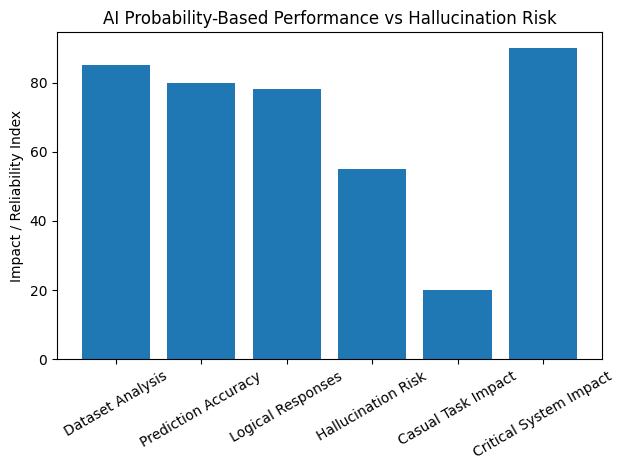

Większość modeli AI dzisiaj jest oparta na prawdopodobieństwie. Analizują ogromne zbiory danych i próbują przewidzieć najbardziej prawdopodobną odpowiedź na pytanie. Ta metoda działa zaskakująco dobrze przez większość czasu. Ale nie jest doskonała. Systemy AI czasami produkują odpowiedzi, które brzmią pewnie i logicznie, ale są całkowicie błędne. Te błędy często nazywane są halucynacjami. System może wymyślać informacje, źle rozumieć źródła lub łączyć dane w sposób, który tworzy coś wiarygodnego, ale nie faktycznego.

W przypadku prostych codziennych zadań ten problem może nie być zbyt poważny. Jeśli asystent AI popełni mały błąd podczas podsumowywania dokumentu lub odpowiadając na nieformalne pytanie, wpływ jest zazwyczaj niewielki. Ale sytuacja staje się zupełnie inna, gdy AI zaczyna wpływać na systemy, w których dokładność ma naprawdę znaczenie.

Wyobraź sobie sztuczną inteligencję analizującą rynki finansowe i pomagającą kierować strategiami inwestycyjnymi. Pomyśl o systemach handlu automatycznego, które polegają na prognozach AI, aby podejmować decyzje w czasie rzeczywistym. Rozważ badania naukowe, w których modele AI interpretują złożone dane, lub zdecentralizowane sieci blockchain, w których automatyczni agenci pomagają zarządzać cyfrowymi gospodarkami. W tych środowiskach nawet mały błąd mógłby stworzyć znaczące konsekwencje.

Jedno błędne założenie w automatycznej strategii handlu mogłoby prowadzić do dużych strat finansowych. Błędna interpretacja AI w badaniach naukowych mogłaby spowolnić odkrycia lub stworzyć mylące wnioski. W systemach zdecentralizowanych, niepewne informacje mogłyby zaszkodzić zaufaniu i wpłynąć na całe społeczności. W miarę jak sztuczna inteligencja wchodzi głębiej w te środowiska o dużym wpływie, niezawodność staje się jednym z najważniejszych wyzwań we współczesnej technologii.

To jest miejsce, w którym Mira Network wprowadza interesujące rozwiązanie.

Zamiast skupiać się tylko na budowaniu szybszych lub potężniejszych modeli AI, Mira Network koncentruje się na weryfikacji. Projekt podchodzi do sztucznej inteligencji z innego kąta. Zamiast pytać, jak inteligentna może być AI, Mira koncentruje się na tym, jak jej informacje mogą być weryfikowane i ufane.

Idea stojąca za Mira Network jest zaskakująco prosta, ale potężna. Kiedy AI generuje złożoną odpowiedź, system nie traktuje tej odpowiedzi jako jedynej prawdy. Zamiast tego, wynik dzieli się na mniejsze roszczenia. Każde z tych roszczeń może być następnie niezależnie oceniane.

Te roszczenia są rozprzestrzenione w sieci niezależnych weryfikatorów. Każdy weryfikator bada roszczenie i sprawdza, czy informacje są dokładne. Ponieważ uczestniczy w tym wielu uczestników, ostateczny wynik powstaje dzięki zdecentralizowanemu konsensusowi, a nie polega na pojedynczym modelu lub organizacji.

Ten proces pomaga zmniejszyć ryzyko stronniczości i poprawia niezawodność. Zamiast ufać jednemu systemowi AI, sieć weryfikuje informacje zbiorowo. Technologia blockchain pomaga wspierać ten system, rejestrując wyniki weryfikacji w przejrzystych i audytowalnych logach. Każdy może przeglądać, jak informacje były weryfikowane i zobaczyć proces stojący za ostatecznym wynikiem.

Inną ważną częścią projektu jest struktura zachęt. Uczestnicy, którzy dostarczają dokładne weryfikacje, są nagradzani, podczas gdy nieuczciwe zachowanie może prowadzić do kar. To zachęca do uczciwego uczestnictwa i pomaga utrzymać integralność sieci.

To, co czyni ten koncept szczególnie ekscytującym, to jego potencjalna rola w przyszłości autonomicznych systemów. W nadchodzących latach agenci AI mogą bezpośrednio interagować z platformami finansów zdecentralizowanych, inteligentnymi kontraktami i cyfrowymi gospodarkami. Ci agenci mogliby analizować rynki, realizować strategie i zarządzać zasobami automatycznie. W takim świecie weryfikowane informacje stają się niezbędne.

Mira Network ma na celu działanie jako warstwa niezawodności dla tych inteligentnych systemów. Poprzez weryfikację wyników generowanych przez AI, zanim wpłyną na ważne decyzje, sieć może zmniejszyć ryzyko i zwiększyć zaufanie do procesów automatycznych.

W miarę jak sztuczna inteligencja nadal rozwija się w nowe obszary technologii, zaufanie stanie się równie ważne jak zdolność. Potężne algorytmy same w sobie nie będą wystarczające. Systemy, które odniosą sukces, to te, które mogą udowodnić, że ich informacje są wiarygodne.

Mira Network reprezentuje wczesny krok w kierunku tej przyszłości. Pokazuje, że kolejna ewolucja AI może nie tylko dotyczyć tworzenia mądrzejszych maszyn, ale także budowania systemów, które zapewniają, że inteligencja może być ufana.