Bariera persistentă pentru potențialul complet al AI-ului în sectoare cu mare risc este o întrebare simplă și fundamentală: Putem avea încredere în rezultatele sale? @mira_network a răspuns cu un protocol de infrastructură descentralizată revoluționar conceput pentru a verifica inteligența artificială.

Problema: Gap-ul de Fiabilitate al AI

Creșterea explozivă a modelor mari de limbaj (LLM-uri) a revoluționat generarea de conținut, dar a evidențiat un defect critic—halucinațiile AI. Aceste modele frecvent "fabrică lucruri", prezentând informații fabricate sau părtinitoare ca și cum ar fi fapte concrete. În sectoare precum finanțele, dreptul și sănătatea, această lipsă de verificabilitate face ca autonomia completă a AI-ului să fie periculoasă și necesită supraveghere umană costisitoare pentru fiecare rezultat. Industria se confruntă cu o alegere fundamentală: precizie versus halucinație. Modelele centralizate actuale nu pot rezolva singure această problemă.

Rețeaua Mira: Verificare descentralizată și Inteligență colectivă

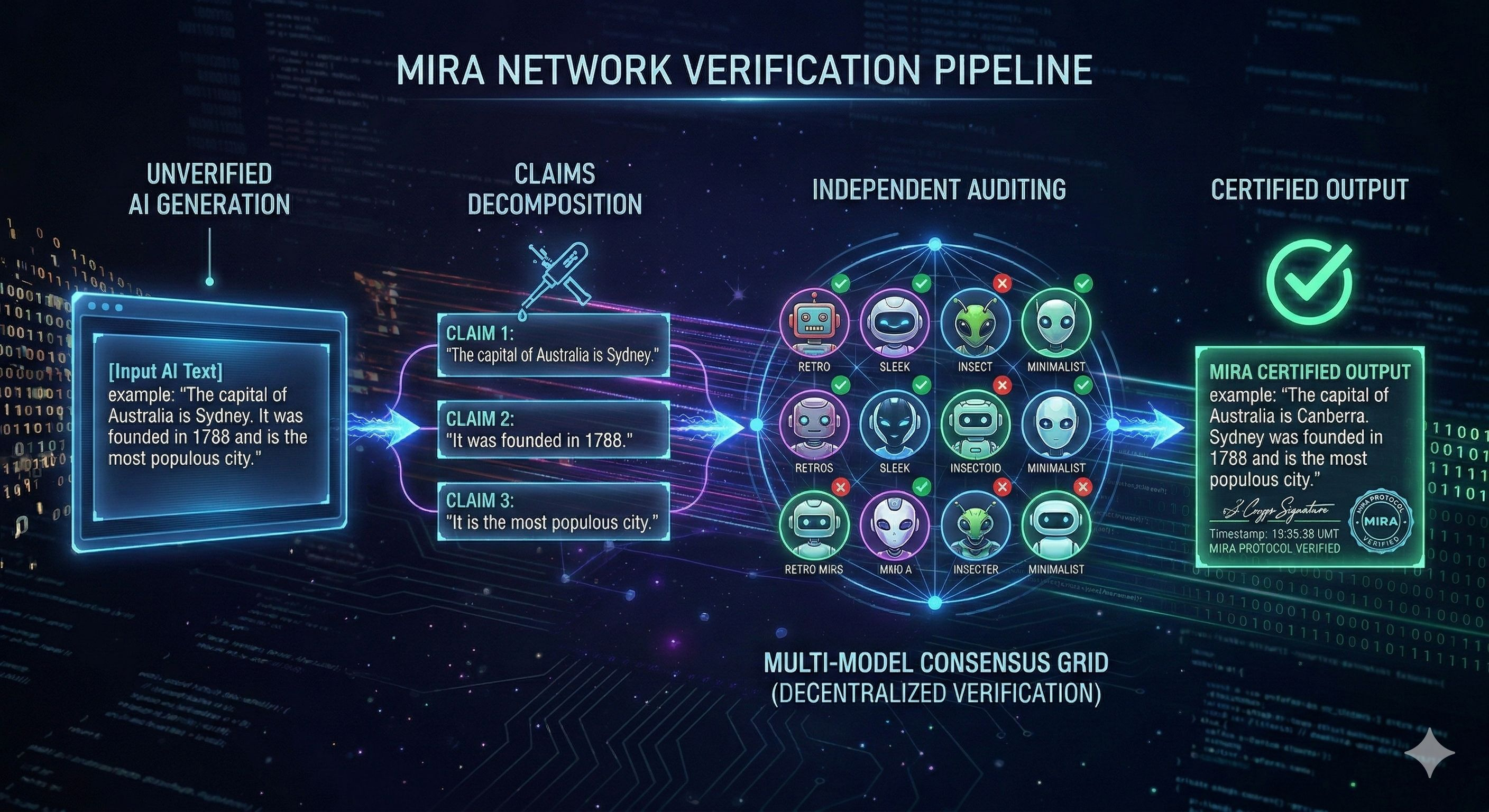

Soluția Rețelei Mira este de a acționa ca un strat intermediar între sistemele AI și utilizatorii finali, funcționând ca Strat de Încredere indispensabil pentru AI. Inovația sa de bază este un pipeline de verificare descentralizat care utilizează "inteligența colectivă" a unei rețele diverse de modele AI independente.

Când conținutul generat de AI intră în Rețeaua Mira, acesta trece printr-un proces sofisticat de decompoziție semantică (conceptualizat în Imaginea 2). Declarațiile complexe sunt desfăcute în aserțiuni factuale individuale, verificabile sau 'pretenții'.

Aceste pretenții atomice sunt apoi distribuite aleatoriu nodurilor verificatoare din întreaga rețea. Prin asigurarea că niciun operator singular nu are acces la documentul complet, Mira protejează în mod inerent confidențialitatea clienților. Nodurile auditează independent pretențiile lor atribuite folosind logica sau modelele lor specializate de verificare.

Rezultatul final, certificat, este atins printr-un mecanism de consens nou. Multiple instanțe ale diferitelor modele votează asupra validității fiecărei pretenții, reducând semnificativ prejudecățile și erorile. Cercetările indică faptul că această abordare multi-model poate îmbunătăți acuratețea rezultatelor AI de la o bază de ~70% la peste 96%. Această precizie ridicată se apropie de nivelul la care AI poate opera autonom în medii critice, cu consecințe mari.

Rolul tokenului $MIRA

În centrul acestui nou motor economic se află tokenul nativ MiRA, care alimentează modelul de stimulente criptoeconomice ce asigură integritatea rețelei.

Staking și Securitate: Nodurile verificatoare trebuie să pună în joc $MIRA tokeni pentru a participa la procesul de consens. Această legătură economică aliniază interesele operatorilor cu veridicitatea rețelei. Actorii rău intenționați sau cei care trimit inferențe leneșe sunt detectați prin verificări statistice și se confruntă cu penalizări automate de reducere a tokenilor.

Taxele de rețea: Dezvoltatorii și întreprinderile plătesc pentru a accesa suitea de API-uri de verificare ale Mira și piața "Mira Flows", care oferă fluxuri de lucru AI pre-construite și personalizabile.

Guvernanță: deținătorii pot participa la guvernanța protocolului, votând pentru actualizări și dezvoltarea ecosistemului.

Privind înainte

Pe măsură ce #Mira continuă să evolueze, obiectivul său final nu este doar verificarea descentralizată, ci și crearea eventuală a unui "model de fundație sintetic"—un sistem AI capabil să genereze rezultate inerent fără erori și verificabile în momentul generării. Prin integrarea transparenței blockchain-ului cu puterea de procesare a AI, @mira_network construiește infrastructura necesară pentru o lume a inteligenței autonome și de încredere.

#Binance #Mira #MarketRebound #AI