Scris de echipa Qubic Scientific

Un comentariu asupra celei mai recente lucrări a lui Nick Bostrom de către echipa Qubic Scientific

Reformularea dezbaterii despre superinteligenta: Chirurgie, nu Ruletă

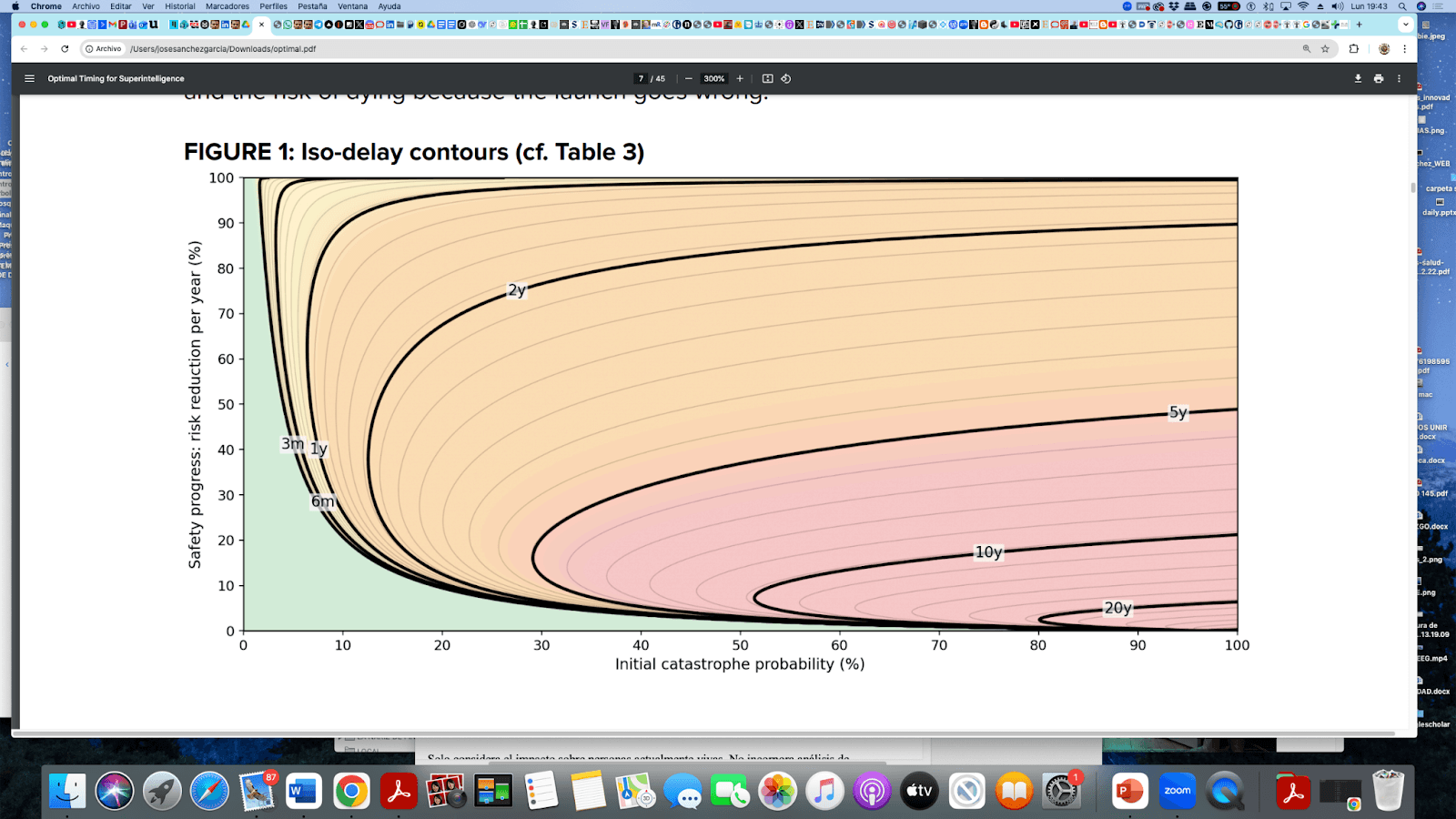

El a publicat recent un nou document de lucru, Timpul Optim pentru Superinteligenta: Considerații Mundane pentru Oameni Existenți (2026), în care schimbă întrebarea centrală. În loc să întrebe dacă ar trebui să dezvoltăm superinteligenta, Bostrom se concentrează pe când este optim să facem asta. Pentru oricine urmărește intersecția în rapidă evoluție dintre AI și blockchain, cadrul său are implicații profunde pentru modul în care proiectăm infrastructura care va susține inteligența generală artificială (AGI).

Reformularea dezbaterii despre superinteligență: Chirurgie, nu ruletă rusească

Punctul de plecare al lucrării lui Bostrom este atât elegant, cât și disruptiv. El reframează complet dezbaterea polarizată „AI da vs. AI nu”. Dezvoltarea superinteligenței, susține el, nu este ca și cum ai juca ruletă rusească. Este mai mult ca o intervenție chirurgicală riscantă pentru o afecțiune care este deja fatală.

Care este acea condiție? Starea actuală a umanității în sine. Considerați baza: aproximativ 170,000 de decese au loc în fiecare zi din cauza îmbătrânirii, bolilor și eșecurilor sistemice. O populație globală îmbătrânită se confruntă cu o deteriorare biologică ireversibilă. Bolile incurabile, inclusiv cele oncologice, neurodegenerative și cardiovasculare, continuă să împovăreze milioane. Ne confruntăm cu riscuri globale necontrolate, de la instabilitatea climatică, la corupția instituțională sistemică, la erodarea calității democratice. Pandemiile, războaiele și colapsul întregilor sisteme rămân amenințări mereu prezente.

Având în vedere aceste realități, Bostrom susține că formularea alegerii ca „zero risc fără AI” versus „risc extrem cu o superinteligență” este simplistă. Întrebarea mai riguroasă este: Care traiectorie generează o speranță de viață mai mare și o calitate a vieții mai mare pentru persoanele care există deja?

Ancorând analiza sa în condițiile reale și prezente ale vieții umane, Bostrom ocolește abstracții filozofice și speculații teologice. El vorbește despre tine, familia ta și oamenii care sunt în viață chiar acum.

Speranța de viață, risc de mortalitate și cazul pentru inteligența artificială generală

Când suntem tineri, riscul anual de moarte este extrem de scăzut. Biologic, suntem departe de moarte în cele mai multe cazuri. Dar pe măsură ce îmbătrânim, probabilitatea de a muri crește necruțător din cauza deteriorării biologice.

Dacă superinteligența ar putea reduce radical sau chiar elimina îmbătrânirea, așa cum propune Bostrom, riscul tău anual de mortalitate ar rămâne la nivelul unei persoane tinere sănătoase. Mortalitatea ta ar înceta să crească în timp. În acel scenariu, speranța de viață devine extraordinar de lungă.

Din acest punct de vedere, valoarea așteptată a superinteligenței compensează riscurile sale ridicate. Dar ce se întâmplă dacă întârziem până când tehnologia devine perfect „sigură”? Ce se întâmplă dacă acumulăm probabilitatea de a muri cu fiecare an care trece? Întrebarea devine: este mai rațional să acceptăm probabilitatea de catastrofă din desfășurarea timpurie, având în vedere că progresele în siguranță AI sunt exponențiale, sau să acceptăm certitudinea deceselor acumulate din întârziere?

Discountarea temporală și costul așteptării

Bostrom introduce conceptul de discountare temporală (ρ), un principiu bine studiat în teoria deciziilor. Oamenii valorizează sistematic rezultatele prezente mai mult decât pe cele viitoare. De aceea rămânem în locuri de muncă nesatisfăcătoare, relații și tipare: efortul de schimbare pare mare, iar recompensa pare îndepărtată.

Dar aici are loc o inversare interesantă. Dacă viața după AGI nu este doar mai lungă, ci dramatic mai bună, cu îmbunătățiri radicale în sănătate, capacitate cognitivă și calitate a vieții, atunci discountarea temporală de fapt pedepsește așteptarea. Fiecare an de întârziere este un an petrecut într-o condiție calitativ mai proastă când o stare mult superioară este accesibilă.

Calitatea vieții și aversiunea față de risc în desfășurarea AGI

Modelul lui Bostrom nu presupune doar longevitate. Încorporează îmbunătățiri substanțiale în bunăstare. Dacă calitatea vieții se dublează după tranziția către superinteligență, balanța se schimbă decisiv spre desfășurarea mai timpurie. El stratifică apoi metricile de aversiune la risc (CRRA și CARA), recunoscând că, dacă suntem mai sensibili la pierderi extreme, fereastra în care „lansare acum” rămâne recomandabilă se îngustează, iar întârzierile optime se lungesc.

Aceasta nu este o accelerare imprudentă. Este o decizie calibrată în condiții de incertitudine, tipul de analiză care ar trebui să informeze modul în care guvernăm calea către inteligența artificială generală.

Desfășurare în două faze: Rapid către adăpost, încet către port

Una dintre cele mai puternice contribuții ale lucrării este divizarea tranziției AGI în două faze distincte:

Faza 1: Atingerea capacității AGI. Mutați-vă cât mai repede este responsabil spre construirea unui sistem care demonstrează inteligență generală.

Faza 2: O pauză strategică înainte de desfășurarea completă. Odată ce sistemul există, introduceți o întârziere controlată pentru a-l studia, a-l testa în condiții reale și a rezolva problemele tehnice de siguranță care erau anterior doar teoretice.

Ipoteza lui Bostrom este că, odată ce un sistem AGI există de fapt, apare un „beneficiu de siguranță”. Cercetătorii pot observa comportamente reale în loc să speculeze despre acestea. Progresele în siguranță se accelerează dramatic deoarece problemele devin empirice în loc să fie abstracte. Motto-ul pe care îl introduce: rapid către adăpost, încet către port.

Cine beneficiază cel mai mult de pe urma unei tranziții mai timpurii către superinteligență?

Bostrom nu tratează sincronizarea optimă ca fiind universală. Oamenii în vârstă, cei grav bolnavi și cei care trăiesc în condiții precare au mai puține ani așteptați în față. Pentru ei, beneficiul potențial al unei tranziții rapide către superinteligență este mult mai mare. Oamenii tineri cu decenii înainte pot tolera mai mult timp de așteptare.

Dacă aplici o logică prioritară, acordând o greutate mai mare celor care sunt în situații mai dificile, cronologia optimă se mută înainte. Bostrom de asemenea respinge explicit presupunerea comună că, dincolo de o anumită vârstă, viața suplimentară nu adaugă valoare. Acea judecată, susține el, este rădăcinată în experiența noastră de îmbătrânire și deteriorare actuală. Nu ține cont de un scenariu de rejuvenare reală, una dintre promisiunile centrale ale unui viitor superinteligent.

Riscuri instituționale: De ce contează infrastructura de guvernanță AI

În secțiunile finale ale lucrării sale, Bostrom introduce avertizări instituționale critice. Cel mai rezonabil scenariu, sugerează el, este unul în care liderul tehnologic își folosește avantajul pentru siguranță. Dar el semnalează și pericolele moratoriilor naționale, interdicțiilor internaționale și dinamicii competitive care apar atunci când mai mulți actori aleargă spre AGI sub presiune geopolitică.

Analiza sa presupune implicit un ecosistem în care puterea computațională tinde să se concentreze. Într-un astfel de mediu, riscurile se acumulează: militarizarea resurselor de calcul, rezervă de calcul (rezervă masivă gata să fie activată sub presiune competitivă) și stimulentele perverse ale centralizării extreme. Acestea nu sunt îngrijorări abstracte. Traiectoria actuală de dezvoltare AI, dominată de câțiva furnizori de cloud de hiperscale și laboratoare corporative, creează exact această concentrație.

Implicatii pentru Qubic: De ce infrastructura AI descentralizată reduce riscul existențial

Dacă luăm în serios cadrul lui Bostrom, întrebarea fundamentală se schimbă de la „când să lansăm AGI” la ce fel de infrastructură reduce riscurile asociate cu acea lansare. Aici arhitectura Qubic devine direct relevantă pentru conversația globală despre siguranța superinteligenței.

Problema centralizării în dezvoltarea actuală a AI

Dacă superinteligența este construită pe infrastructuri centralizate, dependente de centre de date enorme, canale de antrenament opace și control corporativ, profilul de risc se extinde dincolo de purul tehnic. Devine geopolitic. Concentrarea calculului face ca tipul de guvernanță adaptivă pe care Bostrom îl consideră esențial în timpul fazei critice de pre-desfășurare să fie mult mai dificilă. De asemenea, creează exact tipul de rezervă de calcul despre care el avertizează: rezerve computaționale masive gata să fie activate instantaneu sub presiune competitivă.

Cum abordează arhitectura de calcul distribuit a Qubic aceste riscuri

Qubic diluează acel gât de sticlă structural. Arhitectura sa distribuie puterea computațională pe o rețea globală în loc să o concentreze într-un singur nod. Qubic nu depinde de o arhitectură de tip LLM antrenată opac în centre de date mari. În schimb, leagă Utilizarea Dovada de Muncă (uPoW), unde minerii contribuie cu calcul real la antrenarea nucleului său AI, Aigarth, în loc să rezolve puzzle-uri hash arbitrare.

Această alegere de design are implicații directe pentru analiza lui Bostrom. O infrastructură mai puțin centralizată reduce probabilitatea scenariilor de desfășurare abruptă și competitivă despre care el avertizează. Calculul distribuit înseamnă că puterea nu este localizată într-o singură facilitate care poate fi capturată militar, nici într-un laborator corporativ sub control unilateral. Acea reziliență structurală extinde spațiul pentru Faza 2 a lui Bostrom: pauza strategică în care testarea reală, îmbunătățirea incrementală și guvernanța adaptivă pot avea loc înainte de desfășurarea completă.

Pentru o înțelegere mai profundă a modului în care abordarea Qubic față de AI diferă de modelele tradiționale, explorați Neuraxon: Saltul mare al Qubic către AI care trăiește și învață și analiza recentă Că AI static este un capăt mort. Google confirmă.. Aceste postări ilustrează cum Qubic construiește inteligență printr-un paradigm fundamental diferit: unul conceput pentru învățare continuă, reziliență distribuită și adaptare la lumea reală pe o rețea descentralizată.

AI descentralizată și Blockchain: Alinierea structurală cu siguranța AGI

Din perspectiva lui Bostrom, potențialul Qubic nu constă doar în a fi „descentralizat” ca un exercițiu de branding. Consistă în modificarea variabilelor structurale care determină sincronizarea optimă pentru desfășurarea superinteligenței. Prin distribuirea calculului, prin construirea de protocoale de consens care aliniează stimulentele minerului cu antrenamentul real al AI-ului, și prin deschiderea întregului proces ca fiind open-source și auditabil, Qubic creează tipul de infrastructură care face tranziția la AGI structural mai sigură.

Dacă sunteți interesat de modul în care modelul de minerit CPU al Qubic și rețeaua de calcul distribuit evoluează, analiza detaliată despre mineritul Dogecoin pe Qubic explică cea mai recentă expansiune a Muncii Utile de Dovadă, iar Viziunea Qubic din 2026 detaliază foaia de parcurs a infrastructurii mai largi care este acum în desfășurare.

Cea mai greu problemă: Construirea AGI care învață din lume

Imaginarea scenariilor utopice și distopice este valoroasă. Este, de fapt, cea mai bună cale de a crea viitoruri aliniate cu nevoile și valorile umane. Dar a privi în altă parte, a aștepta fără scop sau a accelera fără restricții toate eșuează să ofere reflecțiile necesare.

Poate cea mai dificilă provocare în acest moment nu este atât de mult evaluarea riscului de accelerare a tranziției și modelarea acesteia. Deocamdată, cea mai dificilă sarcină este construirea unei inteligențe artificiale generale capabile să învețe singură din diferite medii dinamice, să creeze reprezentări ale lumii și să acționeze în cadrul acesteia. Asta este exact provocarea pe care cadrul Neuraxon al Qubic este conceput să o abordeze, nu prin antrenarea pe seturi de date statice în spatele ușilor închise, ci prin evoluarea în mod deschis, învățând din complexitatea lumii reale pe o rețea descentralizată la care oricine poate participa.

Referințe și surse

1. Bostrom, N. (2026). Sincronizarea optimă pentru superinteligență: Considerații banale pentru persoanele existente. Lucrare de lucru, v1.0.

https://nickbostrom.com/optimal.pdf

2. Bostrom, N. (2014). Superinteligența: Cărări, pericole, strategii. Oxford University Press.

3. Bostrom, N. (2003). Deșeuri astronomice: Costul oportunității dezvoltarilor tehnologice întârziate. Utilitas, 15(3), 308–314.

4. Yudkowsky, E. & Soares, N. (2025). Dacă cineva îl construiește, toată lumea moare.

5. Hall, R. E. & Jones, C. I. (2007). Valoarea vieții și creșterea cheltuielilor pe sănătate. Quarterly Journal of Economics, 122(1), 39–72.

6. Echipa științifică Qubic. Neuraxon: Saltul mare al Qubic către AI care trăiește și învață.

https://qubic.org/blog-detail/neuraxon-qubic-s-big-leap-toward-living-learning-ai

7. Discursul comunității LessWrong: Sincronizare optimă pentru superinteligență

https://www.lesswrong.com/posts/2trvf5byng7caPsyx/optimal-timing-for-superintelligence-mundane-considerations