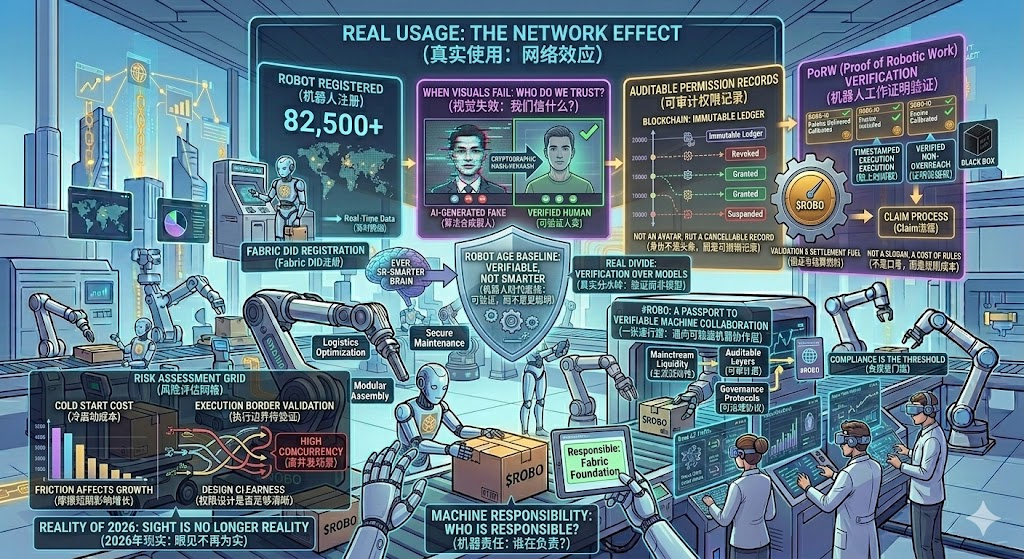

Недавно я увидел случай мошенничества с заменой лиц с помощью ИИ: финансовый директор транснациональной компании был обманут на огромные суммы во время "видеоконференции с руководством", и только позже он понял, что, кроме него самого, все "коллеги" на экране были сгенерированы алгоритмом. Прочитав это, я только почувствовал холод. Реальность 2026 года такова — что видишь, уже не является реальным, а звук больше не является доказательством. Мы вступаем в среду, где трудно различить человека и машину, каждое взаимодействие может быть ошибкой в распределении прав. Итак, вопрос становится острым: когда интеллектуальные агенты начинают участвовать в экономической деятельности, кто может доказать, кто они, какие у них полномочия и что они сделали?

Как ни парадоксально, настоящей точкой отсчёта становится не более мощная модель, а более строгая верификация.

Давайте сначала разберём три ключевых момента. Во‑первых, личность — это не аватар, а поддающаяся отмене и проверке запись о полномочиях. Те подписи, подтверждения и условия в процессе Claim на первый взгляд кажутся излишне сложными, но по сути они подобны выдаче «удостоверения добропорядочного гражданина» для будущих машин — не для того, чтобы распределять деньги, а чтобы оставить за собой прослеживаемую историю действий.@Fabric Foundation Рассмотрим эту систему как эксперимент с on‑chain поведением: только те, кто готов поддержать правила, смогут войти в сеть.

Во‑вторых, верификация — это не «доказательство вашей умности», а «доказательство того, что вы не превышаете свои полномочия». Так называемая Verified Work скорее напоминает прикрепление временной метки и цепочки ответственности к каждому выполнению. Можно представить её как «чёрный ящик» в публичном реестре: в случае возникновения проблем можно воспроизвести ход событий, а в случае споров — отследить истоки. $ROBO В этой системе она играет роль топлива для верификации и расчётов — не просто лозунг, а расходный материал, благодаря которому правила действительно начинают работать.

В‑третьих, соблюдение нормативных требований — это не украшение, а порог для выхода в основной поток ликвидности. Демонстрационные мероприятия 27 февраля позволили внешнему миру осознать, что этот путь вовсе не является самоцелью. Вместо того чтобы рассматривать его как простой токен, лучше воспринимать #ROBO его как пропуск: пропуск к уровню машинного взаимодействия, который можно проверять, управлять и аудитировать.

Необходимо также чётко обозначить риски. Во‑первых, начальные затраты на запуск довольно высоки. Сложные процедуры отсеют спекулянтов и, возможно, отпугнут некоторых реальных пользователей; трение, связанное с верификацией, в краткосрочной перспективе может замедлить темпы роста. Во‑вторых, границы реализации пока ещё предстоит проверить. Достаточно ли ясно продуманы структура личности, полномочий и условий прекращения действия, способны ли они сохранять эффективность в условиях высокой конкуренции — на всё это ещё предстоит ответить время.

Если механизм верификации будет реально внедрён участниками конкретных сценариев, а стоимость верификации с ростом масштаба снизится, то сетевые платформы сотрудничества с большей вероятностью расширятся, а процессы типа Claim станут обычной практикой в отрасли; напротив, если трение долгое время будет перевешивать выгоды, сеть может застрять на стадии холодного запуска, и структура доверия будет сложно сформироваться. Машины становятся всё умнее, но если под ними не будет надёжной базы правил, их умение лишь усилит риски. Вопрос теперь уже не в том, «насколько сильный AI», а в том, «кто несёт за него ответственность».