關於人工智能的對話在技術世界中迅速擴展。每週我們都看到新的模型、新的能力和新的應用出現。但隨着這一迅速發展的進程,另一個問題也在不斷增長:我們如何驗證人工智能系統產生的輸出?

人工智能可以分析大量數據集,生成洞察,並比以往更快地自動化流程。然而,僅僅速度並不能保證可靠性。隨着人工智能融入關鍵系統,確保輸出的可信度變得越來越重要。

在去中心化生態系統中,這一挑戰變得更加複雜。在傳統的集中式平台中,用戶通常依賴於運營系統的公司的可信度。但在 Web3 環境中,信任需要來自透明的機制,而不是集中權威。

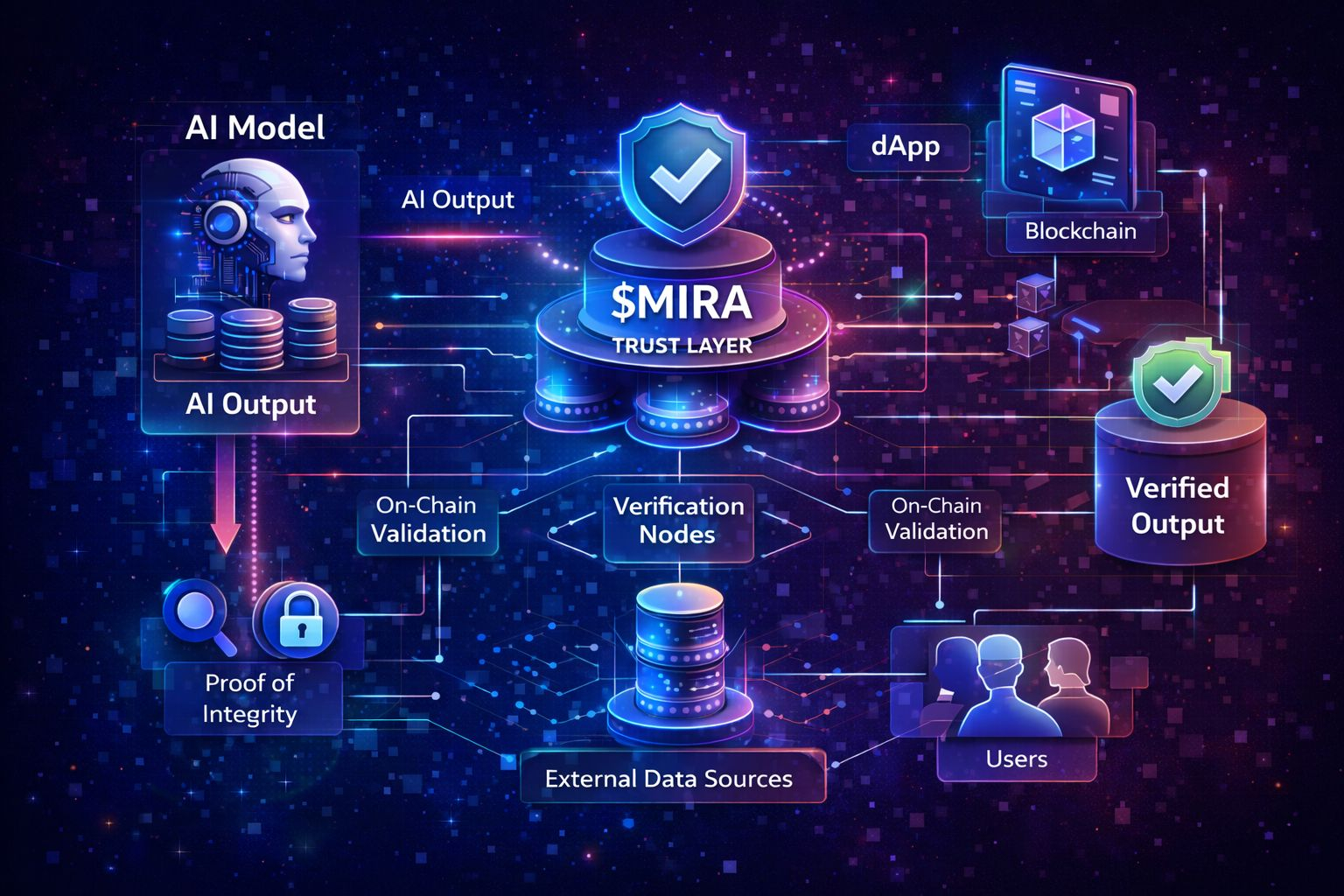

這是項目探索驗證基礎設施受到關注的原因之一。在研究不同方法時,我開始更深入地思考 @mira_network 背後的理念,以及如何 $MIRA 旨在探索 AI 的信任層概念。

這個想法很有趣,因為 AI 輸出通常難以迅速驗證。AI 模型可能在幾秒鐘內產生反應,但驗證該反應可能需要時間、專業知識和可靠數據來源的訪問。隨著 AI 採用的增加,生成和驗證之間的這種不平衡會產生潛在挑戰。

如果去中心化應用程序開始依賴 AI 驅動的見解,則必須存在系統來確認這些見解是否符合可靠性標準。驗證層可以幫助在 AI 系統與基於區塊鏈的應用程序互動時提供透明度和信心。

另一個使這個主題重要的原因是 AI 和 Web3 之間日益增長的重疊。區塊鏈網絡已經被用於金融系統、數字擁有權、治理機制和分佈式基礎設施。隨著 AI 工具與這些環境整合,確保可靠的輸出成為一個關鍵因素。

項目如 @mira_network 正在探索去中心化基礎設施如何支持 AI 驗證過程。 $MIRA 背後的概念專注於建立框架,允許驗證 AI 結果,而不是盲目接受。

這種方法可能有助於加強 AI 驅動應用程序在 Web3 生態系統中的可靠性。無論是在數據分析、去中心化治理還是自動化過程中,驗證機制都可以為與 AI 系統互動的用戶提供額外的信心。

在 #Mira 活動期間,觀察社區對這些想法的反應非常有趣。活動期間通常會帶來新的參與者,他們開始探索項目的願景並討論 AI 驗證的更廣泛影響。

在許多方面,AI 發展的下一階段可能不僅專注於智能,還專注於可信度。能夠生成強大見解的系統必須還能提供驗證這些見解的方法。

這就是為什麼有關信任層、驗證框架和去中心化 AI 基礎設施的對話變得越來越重要。

觀看這些想法在 @mira_network 和 $MIRA 周圍如何發展,提供了對 Web3 社區如何思考 AI 和信任之間未來關係的有趣一瞥。