我以前看 L1 项目时,习惯用同一套标准去判断:性能参数、生态规模、叙事方向。但在链上稳定资产使用频率明显增加之后,这套标准慢慢失效了。转账一旦从“偶尔一次”变成“每天都会发生”,真正影响体验的就不再是峰值性能,而是网络在持续负载下的处理方式是否稳定。也是在这个背景下,我才理解 @Plasma 的设计为什么从一开始就没有往“通用公链”那条路上走。

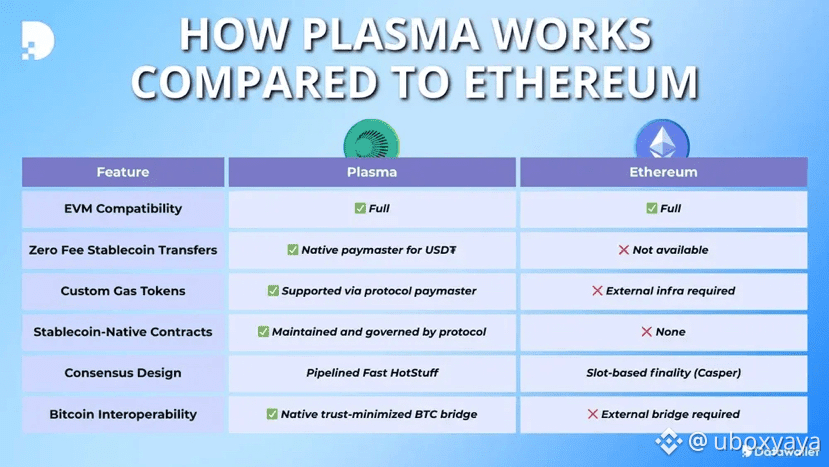

多数 L1 的底层逻辑是“通用执行模型”:任何类型交易都进入同一套处理路径,复杂合约计算、NFT 铸造、普通转账在资源调度层并没有本质区别。Plasma 的不同在于,它从底层优先级上就做了取舍——网络不是围绕所有计算需求展开,而是围绕稳定资产高频流转这一类最常发生的链上行为去设计处理逻辑。

这种思路首先体现在执行层选择上。Plasma 兼容 EVM,Solidity 合约和现有开发工具可以直接延续,这让应用接入成本保持在熟悉范围内。但在交易进入网络后的处理取向上,它更强调连续发生的常规资产转移的处理稳定性,而不是优先为高复杂度合约计算腾出峰值空间。这意味着它优化的不是极端高负载计算场景,而是持续存在的资产流动场景。

当我开始频繁做稳定资产跨平台调动时,很明显能感受到一种差异:稳定资产链上行为的特点是次数多、金额分散、几乎每天都在发生,而不是偶发的大计算操作。如果网络的资源调度不是围绕这种交易曲线设计的,那么使用频率一高,费用波动和确认节奏变化就会被放大。Plasma 的结构取向正是贴近这种真实使用形态。

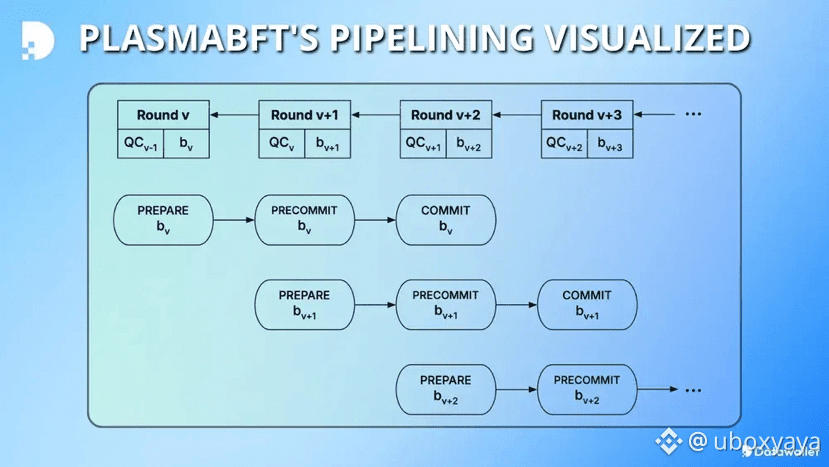

在系统结构层,Plasma 也没有采用不断叠加底层模块来扩展功能边界的方式。节点需要处理的路径保持相对集中,协议级规则不会因为某类新应用增长就被频繁改写。这种架构方式带来的结果很直接:网络运行一段时间后,处理节奏和费用结构不会轻易发生剧烈变化。对经常在链上移动资产的人来说,这种前后一致比功能丰富更有意义。

安全层面,Plasma 的网络状态并不是完全封闭运行,而是通过外部安全锚定机制提升历史记录的确定性。这让网络安全性不只依赖自身验证结构,而是多了一层约束。对于长期停留在链上的资产来说,这种设计影响的是信任模型,而不是表面性能指标。

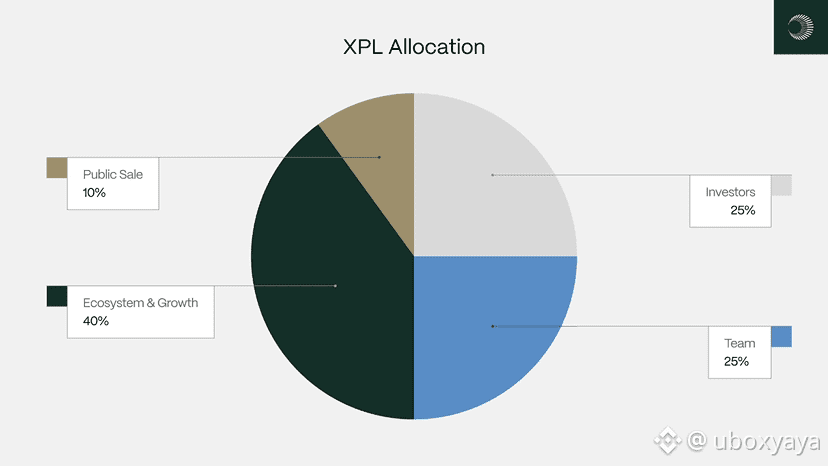

$XPL 在体系中的角色同样是围绕网络运行展开,而不是单纯交易媒介。代币参与资源使用和激励分配,交易发生、系统维护和代币机制之间存在绑定关系,使网络形成内部经济闭环,而不是依赖外部市场热度维持运转。

从结构角度看,Plasma 并不是在功能数量上与其他公链竞争,而是在底层资源为哪类行为服务这件事上做了重新排序。当多数 L1 仍然围绕通用扩展性优化时,它先把稳定资产这一类高频链上行为单独拆出来,围绕它重构处理逻辑。

等稳定资产使用真的变成日常动作之后,这种设计差异就不再是技术概念,而会变成使用过程中的直接感受。也正因为这样,我现在再看 plasma,关注的不是短期数据,而是它是否继续沿着这套围绕稳定资产运行逻辑的结构方向在细化。#Plasma