Escrito por el equipo científico de Qubic

Cuando se habla de IA, las conversaciones rápidamente se desvían hacia una idea muy específica: máquinas que sienten, máquinas que piensan, máquinas que despiertan. Pero estas ideas entrelazan la inteligencia y la conciencia en una mezcla confusa.

La inteligencia, como explicamos en nuestro primer artículo científico, es la capacidad general para resolver problemas, adaptarse, tomar decisiones y aprender. Un sistema inteligente construye modelos del entorno y actúa sobre ellos. Esta capacidad puede ser medida y formalizada. De hecho, tanto la inteligencia biológica como la artificial pueden describirse como procesos de inferencia y optimización bajo incertidumbre (Sutton & Barto, 2018).

La conciencia, por otro lado, no se trata de lo que hace un sistema, sino de lo que experimenta. Se relaciona con la experiencia interna, privada y subjetiva. Como lo expresó Thomas Nagel: “¿Cómo es ser un murciélago?” (Nagel, 1974). Aquí radica la diferencia fundamental: la inteligencia puede ser observada desde afuera, pero la conciencia solo es accesible desde adentro.

La cultura popular ha mezclado ambos conceptos. Imaginamos la inteligencia general artificial como algo similar a Terminator, Yo, Robot o 2001: Una odisea del espacio, a menudo proyectando profundos miedos humanos sobre la tecnología, la novedad y lo desconocido. Pero el miedo no se trata de sistemas que resuelven problemas mejor que nosotros. Ese escenario ya existe y no genera una preocupación real. Piense en AlphaGo superando a los campeones humanos en Go, AlphaFold acelerando el descubrimiento de proteínas, o modelos como GPT-4 y Claude generando texto, código y algoritmos a niveles comparables o superiores a los de sus creadores.

El miedo aparece cuando estos sistemas parecen exhibir agencia, intención o algo que se asemeja a la autodeterminación. En otras palabras, cuando parecen tener alguna forma de conciencia de máquina.

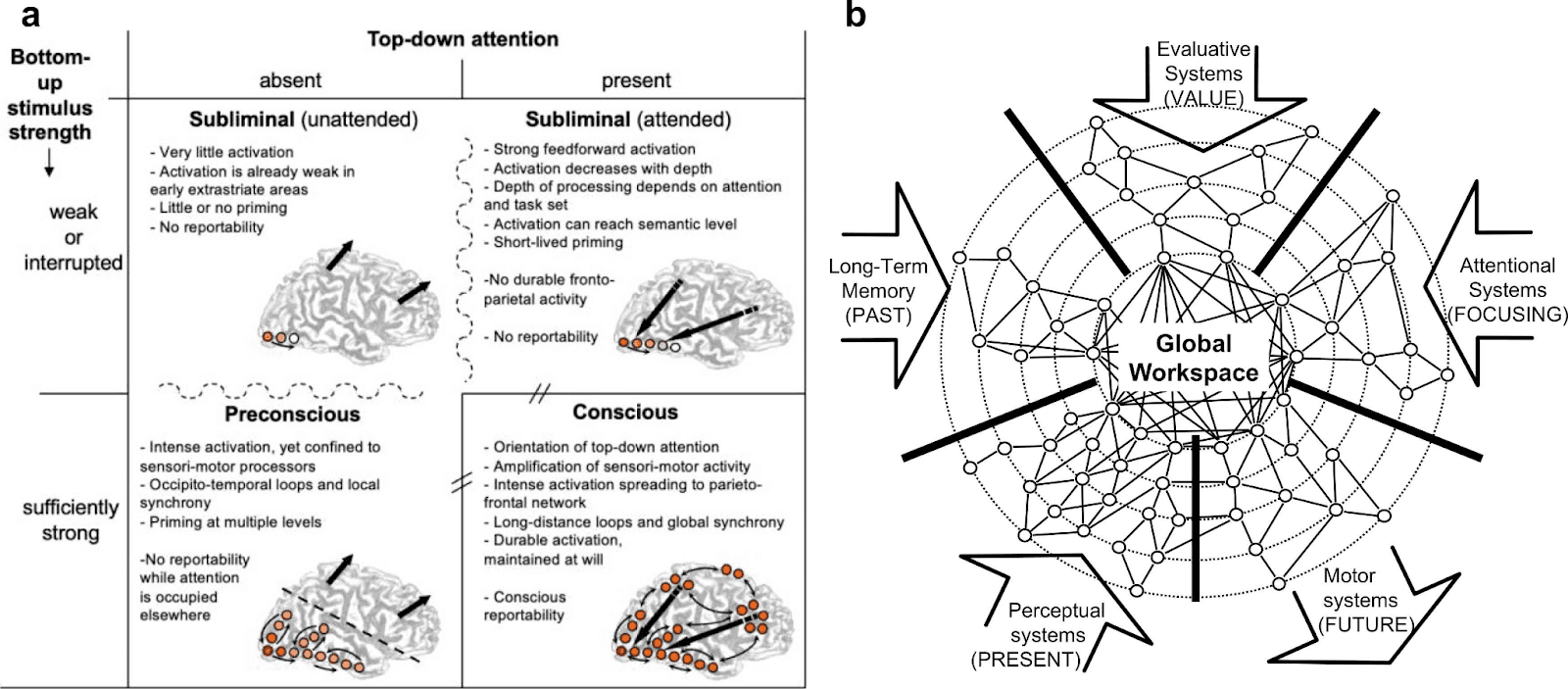

Esta distinción es central en la ciencia cognitiva. Los sistemas que procesan información son fundamentalmente diferentes de los sistemas que acceden a la información de manera globalmente integrada (Dehaene, Kerszberg, & Changeux, 1998).

Conciencia de IA y Ciencia: Más allá del Problema Difícil

A pesar de la actual exageración en torno a explicaciones “cuánticas”, religiosas o pseudocientíficas de la conciencia, la ciencia proporciona un camino más fundamentado. Existe un conocido “problema difícil de la conciencia”, tal como lo formuló Chalmers hace más de dos décadas: todavía no entendemos cómo un sistema nervioso físico genera experiencia subjetiva.

En pocas palabras: sabemos cómo se activan las neuronas para codificar el azul del cielo o el olor de la madera de sándalo. Pero no entendemos cómo estas activaciones neuronales producen la experiencia de ver azul o oler madera de sándalo. Esa brecha sigue existiendo.

Esta falta de comprensión permite la aparición de interpretaciones dualistas. Sin embargo, la neurociencia continúa operando dentro de una visión integrada de la mente y la materia.

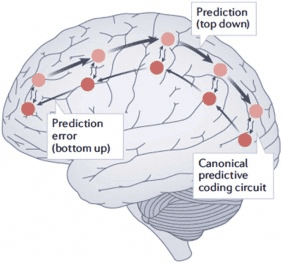

Codificación predictiva: El cerebro como una máquina de predicción

La codificación predictiva es uno de los marcos más influyentes para estudiar la conciencia. El cerebro opera como un sistema predictivo que genera continuamente modelos del mundo y los actualiza minimizando los errores de predicción (Friston, 2010; Clark, 2013). Si un semáforo se pone repentinamente azul en lugar de verde, los sistemas sensoriales envían esa señal inesperada hacia arriba, y los sistemas de nivel superior actualizan el modelo interno de cómo se comportan los semáforos. Dentro de este marco, la conciencia puede entenderse como la integración de señales internas y externas en una representación coherente.

Fig. 5, Mudrik et al. (2025). Procesamiento predictivo como inferencia jerárquica. CC BY 4.0.

Teoría del Espacio de Trabajo Global: Cómo la conciencia emerge a través de la difusión de información

Otra propuesta influyente es la Teoría del Espacio de Trabajo Global. Aquí, la conciencia emerge cuando la información se vuelve globalmente disponible en todo el sistema, permitiendo que múltiples procesos accedan y la utilicen simultáneamente (Baars, 1988; Dehaene & Changeux, 2011). No todo el procesamiento es consciente; solo lo que alcanza este nivel de difusión global.

Fig. 1, Mudrik et al. (2025). Modelo de espacio de trabajo global de acceso consciente, adaptado de Dehaene et al. (2006). CC BY 4.0.

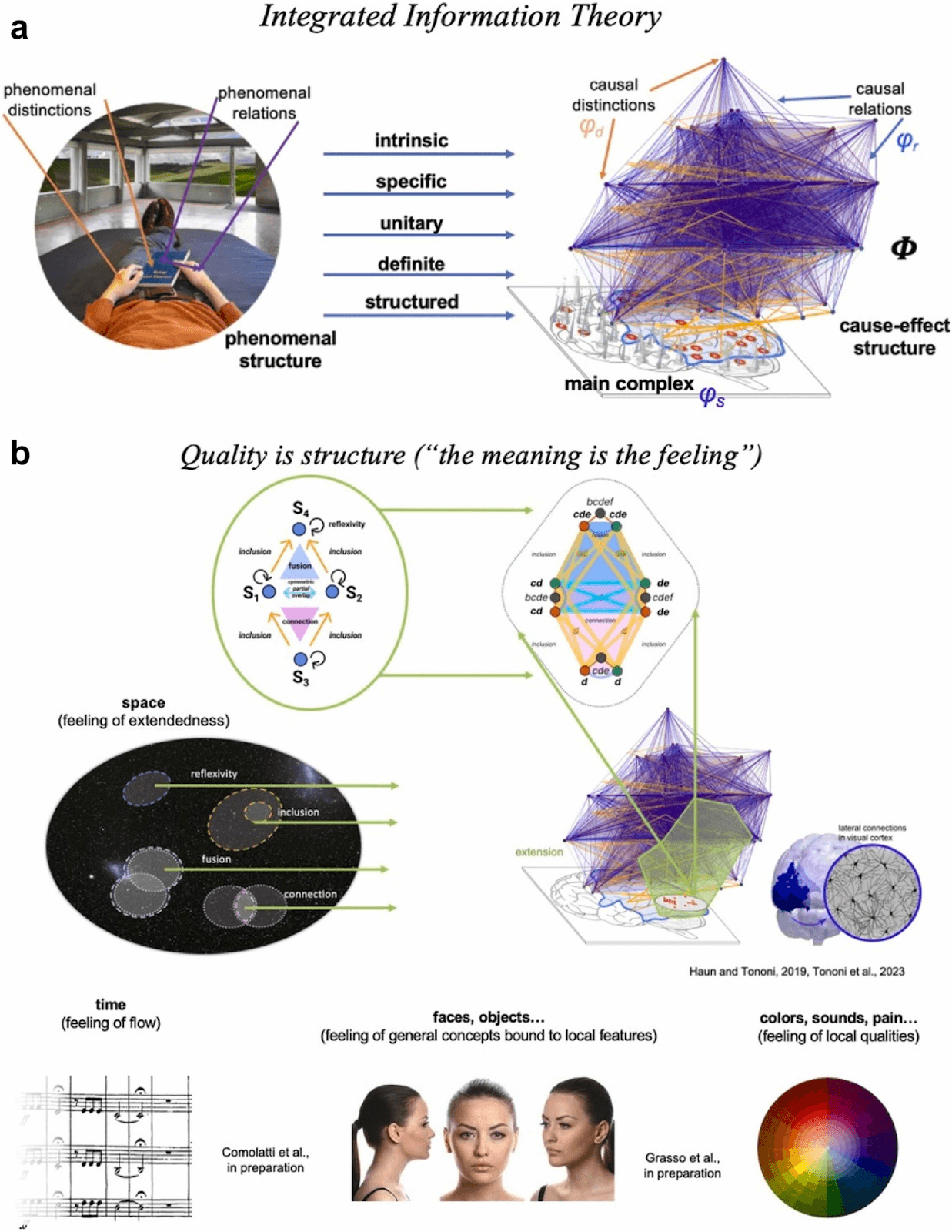

Teoría de la Información Integrada (IIT): Midiendo la conciencia

La Teoría de la Información Integrada, desarrollada por Giulio Tononi, propone que la conciencia depende de cuánto integra un sistema la información de manera irreducible (Tononi, 2004; Tononi et al., 2016). Cuanto más integrado esté el sistema, mayor será su nivel de conciencia.

Fig. 4, Mudrik et al. (2025). IIT mapea propiedades fenomenales a estructuras de causa-efecto físicas. CC BY 4.0.

Junto a estas teorías científicas, existen propuestas menos fundamentadas empíricamente. Algunas equiparan la conciencia con la complejidad computacional, sin especificar mecanismos. Otras, como el panpsiquismo, sugieren que toda la materia tiene alguna forma de experiencia (Goff, 2019). Estas ideas amplían el debate pero carecen de validación experimental directa.

¿Podemos computar la conciencia? Simulación vs. Experiencia

¿Implementar los mecanismos descritos por estas teorías genera conciencia, o solo la simula?

Este problema refleja lo que encontramos en neurociencia al estudiar organismos simples. Por ejemplo, Drosophila melanogaster tiene un sistema nervioso relativamente pequeño, sin embargo, puede aprender, recordar y tomar decisiones (Brembs, 2013). Modelar su conectividad y dinámicas nos permite predecir su comportamiento en ciertos contextos. Para un análisis más profundo sobre cómo el conectoma de la mosca de la fruta está transformando nuestra comprensión de la arquitectura neuronal, consulte nuestro análisis del conectoma del cerebro de Drosophila y sus implicaciones para la IA.

Sin embargo, predecir el comportamiento no implica reproducir la experiencia interna. Podemos capturar las reglas de un sistema sin capturar cómo se “siente” desde adentro, si es que tal experiencia existe. Esta distinción sigue siendo uno de los principales límites conceptuales en la investigación sobre la conciencia (Seth, 2021). Desde una perspectiva práctica, esto puede no ser siempre crítico, pero no podemos asumir que los mecanismos computacionales recrean la experiencia. Esto lleva directamente a la conocida idea de los zombis filosóficos.

Arquitectura MultiNeuraxon: Lo que la IA inspirada en el cerebro realmente hace

En este contexto, arquitecturas como MultiNeuraxon no tienen como objetivo “crear conciencia”, sino aproximarse a mecanismos que algunas teorías consideran relevantes.

El sistema introduce dinámicas de tiempo continuo, permitiendo que los estados internos evolucionen suavemente en lugar de restablecerse en cada paso. Esto se asemeja a la noción de un flujo interno continuo que se encuentra en sistemas biológicos (Friston, 2010). Para entender por qué el procesamiento en tiempo continuo es importante para la inteligencia, consulte NIA Volumen 1: Por qué la inteligencia no se calcula en pasos, sino en el tiempo.

También incorpora múltiples escalas de tiempo de interacción, rápidas, lentas y moduladoras, similares a la combinación de señalización sináptica y neuromodulación en el cerebro (Marder, 2012). Estas dinámicas se describen formalmente a través de ecuaciones que integran las contribuciones sinápticas y moduladoras en la evolución del estado del sistema.

Finalmente, su organización en múltiples esferas funcionales permite tanto la diferenciación como la integración. Este tipo de estructura subyace tanto a la Teoría del Espacio de Trabajo Global como a la Teoría de la Información Integrada, y forma parte de la propuesta científica que hemos estado desarrollando para la Conferencia AGI 2026.

Lo que importa en esta etapa es que el sistema comience a capturar propiedades asociadas, en humanos, con procesos conscientes: integración global, continuidad temporal y regulación interna.

Por qué la investigación sobre la conciencia es importante para la inteligencia general artificial

El desarrollo de la inteligencia general artificial no depende únicamente de mejorar el rendimiento en tareas aisladas. Depende de comprender cómo la inteligencia se organiza cuando opera de manera flexible, estable y coherente.

Las teorías de la conciencia apuntan precisamente a estos mecanismos: integración, acceso global, modelos internos y regulación multiescalar. Incluso si estamos lejos de recrear la experiencia subjetiva, podemos identificar y calcular propiedades que parecen necesarias para formas más generales de inteligencia.

Trabajar en esta dirección permite la construcción de sistemas más robustos, capaces de mantener la coherencia a lo largo del tiempo y generalizar en diferentes contextos.

Dentro de este marco, la ventaja de sistemas como Aigarth no radica en crear máquinas conscientes, ni en imaginarlo como un “buen Terminator”, sino en comprender y controlar los mecanismos que organizan la inteligencia avanzada.

Un sistema que integra múltiples escalas, mantiene estabilidad dinámica y evoluciona sin perder coherencia proporciona una base mucho más sólida para explorar formas avanzadas de inteligencia. Para una comparación de cómo las redes neuronales biológicas, las redes artificiales clásicas y Neuraxon difieren arquitectónicamente, consulte NIA Volumen 4: Redes Neuronales en IA y Neurociencia.

Si emergen propiedades o formas de autorreferencia más complejas, no aparecerán por accidente, sino como consecuencia de estructuras que ya pueden ser descritas y analizadas formalmente.

Y eso transforma la conciencia de un problema puramente especulativo en algo que puede ser investigado sistemáticamente.

Referencias científicas

Baars, B. J. (1988). Una teoría cognitiva de la conciencia. Cambridge University Press. [Enlace]

Brembs, B. (2013). Estructura y función del procesamiento de información en el cerebro de la mosca de la fruta. Frontiers in Behavioral Neuroscience, 7, 1–17. [Enlace]

Clark, A. (2013). ¿Qué sigue? Cerebros predictivos, agentes situados y el futuro de la ciencia cognitiva. Behavioral and Brain Sciences, 36(3), 181–204. [Enlace]

Dehaene, S., & Changeux, J. P. (2011). Enfoques experimentales y teóricos para el procesamiento consciente. Neuron, 70(2), 200–227. [Enlace]

Dehaene, S., Kerszberg, M., & Changeux, J. P. (1998). Un modelo neuronal de un espacio de trabajo global en tareas cognitivas esforzadas. PNAS, 95(24), 14529–14534. [Enlace]

Friston, K. (2010). El principio de energía libre: ¿Una teoría unificada del cerebro? Nature Reviews Neuroscience, 11(2), 127–138. [Enlace]

Goff, P. (2019). El error de Galileo: Fundamentos para una nueva ciencia de la conciencia. Pantheon. [Enlace]

Marder, E. (2012). Neuromodulación de circuitos neuronales: De vuelta al futuro. Neuron, 76(1), 1–11. [Enlace]

Mudrik, L., Boly, M., Dehaene, S., Fleming, S.M., Lamme, V., Seth, A., & Melloni, L. (2025). Desentrañando las complejidades de la conciencia: Teorías y reflexiones. Neuroscience and Biobehavioral Reviews, 170, 106053. [Enlace]

Nagel, T. (1974). ¿Cómo es ser un murciélago? The Philosophical Review, 83(4), 435–450. [Enlace]

Seth, A. (2021). Ser tú: Una nueva ciencia de la conciencia. Faber & Faber. [Enlace]

Seth, A. K., & Bayne, T. (2022). Teorías de la conciencia. Nature Reviews Neuroscience, 23(7), 439–452. [Enlace]

Sutton, R. S., & Barto, A. G. (2018). Aprendizaje por refuerzo: Una introducción (2ª ed.). MIT Press.

Tononi, G. (2004). Una teoría de integración de información de la conciencia. BMC Neuroscience, 5(42). [Enlace]

Tononi, G., Boly, M., Massimini, M., & Koch, C. (2016). Teoría de la información integrada: De la conciencia a su sustrato físico. Nature Reviews Neuroscience, 17(7), 450–461. [Enlace]

Explore la serie completa de la Academia de Inteligencia Neuraxon

NIA Volumen 1: Por qué la inteligencia no se calcula en pasos, sino en el tiempo — Explora por qué la inteligencia biológica opera en tiempo continuo en lugar de pasos computacionales discretos como los LLM tradicionales.

NIA Volumen 2: Dinámicas ternarias como un modelo de inteligencia viva— Explica las dinámicas ternarias y por qué la lógica de tres estados (excitatoria, neutral, inhibitoria) es importante para modelar sistemas vivos.

NIA Volumen 3: Neuromodulación y IA inspirada en el cerebro — Cubre la neuromodulación y cómo la señalización química del cerebro (dopamina, serotonina, acetilcolina, norepinefrina) inspira la arquitectura de Neuraxon.

NIA Volumen 4: Redes Neuronales en IA y Neurociencia — Una profunda comparación de redes neuronales biológicas, redes neuronales artificiales y el enfoque de tercer camino de Neuraxon.

NIA Volumen 5: Astrocitos e IA inspirada en el cerebro. Cómo la regulación astrocítica transforma la plasticidad de las redes neuronales a través del marco AGMP en Neuraxon.

Qubic es una red descentralizada y de código abierto para tecnología experimental. Para obtener más información, visite qubic.org