Dernièrement, dans les groupes Telegram ou en naviguant sur X, j'ai remarqué que beaucoup de gens discutent d'une question qui semble simple mais qui en réalité n'est pas du tout négligeable : @Fabric Foundation peut-il devenir une norme d'infrastructure pour des robots sûrs ?

J'ai aussi lu quelques sections du livre blanc du projet, et la première impression est qu'ils ne suivent pas le style de raconter des histoires de manière robotique pour paraître impressionnants.

Au lieu de cela, ils essaient d'aborder la partie beaucoup plus difficile : si les robots commencent à travailler dans le monde réel, qui contrôle, qui vérifie, et quand une erreur se produit, comment la responsabilité est-elle retracée ?

À mon avis, c'est là que cela devient intéressant.

Le marché préfère souvent le récit de robots intelligents, d'agents d'IA autonomes, de machines capables d'effectuer toutes sortes de tâches.

Mais plus je regarde ces modèles, plus je constate que le problème ne réside pas dans le nombre de tâches que les robots peuvent accomplir, mais dans le fait que lorsqu'ils se trompent, le système est-il suffisamment clair pour faire référence ?

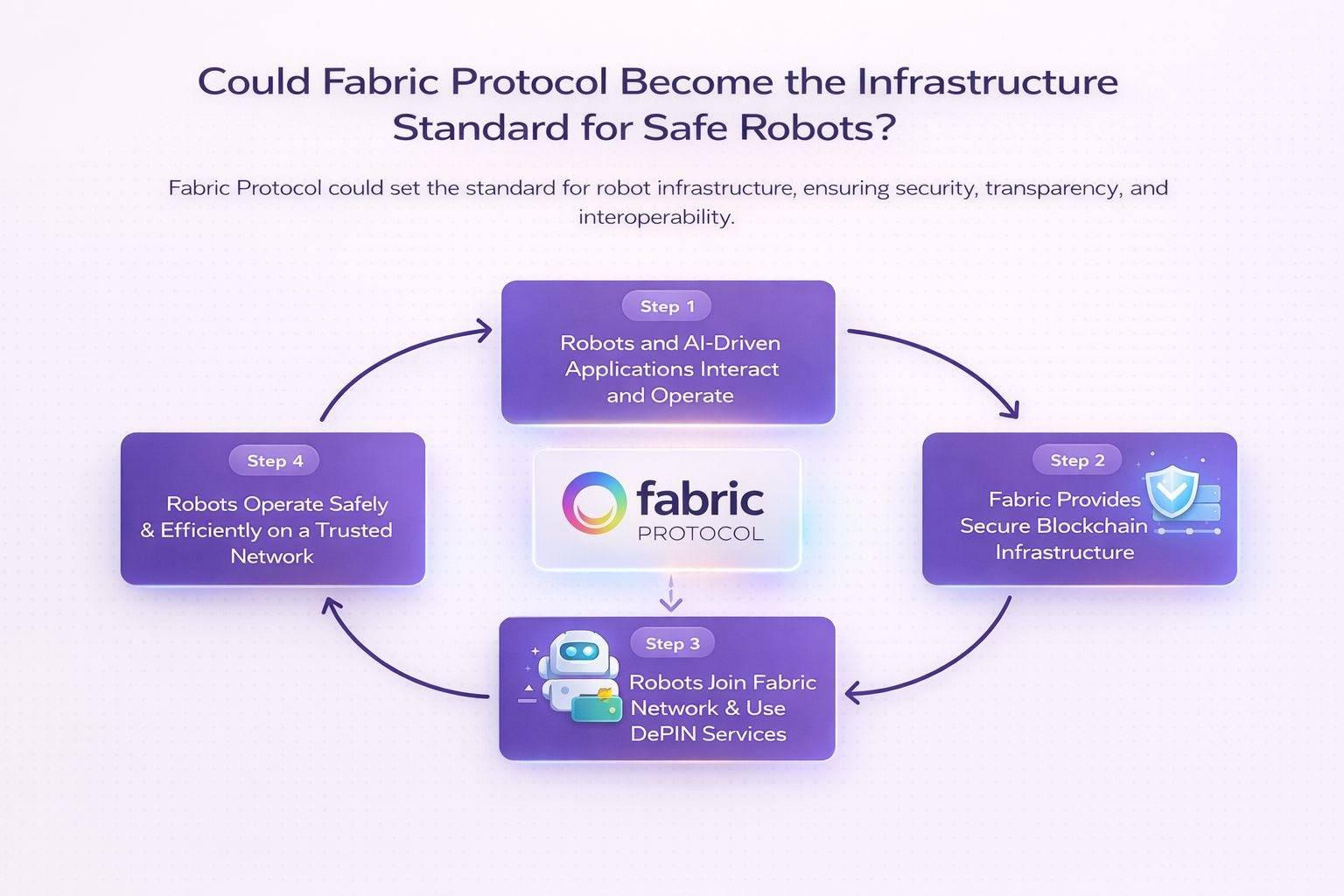

Fabric touche juste à ce point. Ils parlent beaucoup de l'identité machine, de la vérification, de la responsabilité, et du fait que toutes les actions ou collaborations ne devraient pas simplement être dans le log interne d'un opérateur.

S'ils réussissent vraiment, cela sera une couche d'infrastructure très différente de la plupart des projets qui se limitent à un récit d'IA.

Ce que je trouve raisonnable chez Fabric, c'est qu'ils ne vendent pas l'histoire du type "les robots seront sûrs parce que les robots sont meilleurs".

Au lieu de cela, ils établissent implicitement un autre standard : un robot n'est digne de confiance que s'il a une identité claire, des pouvoirs clairs, une trace d'actions vérifiables, et un mécanisme économique qui oblige les parties à jouer leur rôle correctement.

Cela semble technique, mais la signification est très pratique.

Imaginez simplement : un bot ou une machine automatique qui ne fournit qu'un résultat final n'est pas suffisant pour être considéré comme digne de confiance.

Ce dont les utilisateurs ont besoin, c'est que lorsqu'un incident se produit, ils sachent encore où regarder, qui a confirmé quoi, et pourquoi le système a permis que cette tâche se produise.

Ce point est important car ces dernières années, j'ai vu de nombreux produits d'automatisation parler très bien de la performance.

Mais concernant la responsabilité, c'est encore assez flou.

Quand le système fonctionne bien, tout le monde appelle cela la technologie du futur. Mais quand une erreur se produit, l'histoire revient souvent à un schéma familier : c'est une erreur système et personne ne prend vraiment la responsabilité de manière claire.

Fabric essaie au moins de transformer cette responsabilité en quelque chose de plus structuré et vérifiable, plutôt que d'être juste une explication après un incident.

Cependant, passer d'une bonne direction à devenir une infrastructure standard est un long chemin.

Je pense que beaucoup de gens dans le marché se laissent emporter par le terme "standard" trop tôt. Un protocole ne peut pas devenir une norme simplement parce que son livre blanc est beau ou que son récit est au bon moment.

Pour devenir une norme, elle doit être réellement utilisée par de nombreuses parties, intégrée réellement, et surtout être dignement de confiance même par ceux qui n'ont pas d'intérêts communs.

C'est la partie la plus difficile.

Un robot sûr n'est pas seulement l'affaire des développeurs. Cela concerne également les opérateurs, les validateurs, les entreprises déployant, voire les agences de normalisation et les régulateurs.

En lisant le livre blanc, j'ai constaté que Fabric essaie de construire un niveau de coordination plutôt qu'un produit robot spécifique. C'est un point que j'évalue assez haut.

Pour devenir une infrastructure standard, il ne suffit pas de gagner avec un robot de démonstration plus beau qu'un autre.

Les normes apparaissent uniquement lorsqu'il y a une couche commune suffisamment utile pour que de nombreuses parties veuillent s'appuyer dessus pour construire davantage.

Fabric $ROBO est en train de raconter l'histoire dans cette direction : données, calcul, supervision, vérification et incitation sont intégrés dans un même système ouvert. Dans ce système, les robots ne sont pas seulement en action mais sont aussi observés et contraints par des mécanismes beaucoup plus clairs.

Cela dit, je pense toujours qu'il est nécessaire de garder la tête froide.

Les robots dans la vraie vie ne ressemblent pas à un logiciel pur. Un grand livre public ou un mécanisme de vérification peuvent être très bons pour l'audit et la responsabilité, mais le monde physique est toujours beaucoup plus complexe.

Il y a des délais, des erreurs de capteur, des contextes inattendus, des collisions avec la réglementation locale, et de nombreuses situations où le vrai et le faux ne peuvent être décidés simplement par un enregistrement on-chain.

Pour le dire simplement, Fabric pourrait construire une bonne couche de responsabilité pour les robots, mais pour l'appeler la base entière pour des robots sûrs, il est encore un peu tôt.

La sécurité n'est pas seulement l'enregistrement des actions. La sécurité est également la capacité d'empêcher les erreurs, de réduire les risques et de réagir correctement lorsque le monde réel ne suit pas le scénario.

Un autre point que je trouve intéressant est le mécanisme d'incitation.

En théorie, si le réseau récompense le travail vérifié, la validation, le calcul et la contribution réelle, alors l'écosystème sera plus durable que simplement avoir un token pour la spéculation.

Mais la théorie et la réalité sont souvent assez éloignées.

La question importante est : les choses appelées "vérifiées" reflètent-elles vraiment la qualité dans le monde réel ?

Si cette vérification n'est pas suffisamment rigoureuse, ou si elle se transforme en un jeu d'optimisation des récompenses, alors la couche de responsabilité que le projet souhaite construire pourrait également être très facilement vide à l'intérieur.

Pour moi, Fabric est remarquable car ils essaient de résoudre un problème difficile et beaucoup moins flashy que les récits d'IA que l'on voit souvent.

Ils ne se contentent pas de demander ce que les robots peuvent faire.

Ils se demandent comment les robots doivent être contraints pour que les humains osent leur faire confiance.

Cette question n'est pas aussi sexy qu'un robot qui sait courir ou parler, mais elle constitue la base déterminante pour savoir si cette technologie peut aller loin.

Donc, si vous demandez si le Fabric Protocol peut devenir une infrastructure standard pour des robots sûrs, ma réponse est :

C'est possible, mais pour l'instant, cela ne reste qu'un candidat sérieux.

Leur direction est au bon moment, leur argumentation est suffisamment tranchante, et le problème qu'ils choisissent est un véritable problème.

Mais pour devenir une norme, ils doivent encore prouver l'adoption, prouver que la vérification a de la valeur dans la réalité, et prouver que le système est suffisamment facile à utiliser pour que même ceux qui ne sont pas dans la crypto s'y intéressent.

Je vais continuer à suivre car si Fabric parvient à faire ces choses, sa valeur résidera dans la création d'une confiance structurée pour les robots, et pas seulement dans l'ajout d'un beau récit pour le marché à discuter pendant quelques semaines avant de l'oublier.

@Fabric Foundation #ROBO $ROBO