前几天跟几个在大厂做大模型的朋友喝酒,席间聊起现在的AI热潮。现在的AI确实像极了当年的互联网,甚至被推到了印刷机、蒸汽机这种改变文明的高度,可现实呢?理想很丰满,现实却骨感得让人想“劝退”。大家嘴上说着AI要替代医生、替代律师,可真到了高风险的决策关头,谁敢把命交给一个随时可能一本正经胡说八道的聊天机器人?这种“泼天的富贵”就在眼前,可由于那该死的幻觉和偏差,AI至今还被锁在低成本、容错率高的玩具盒子里,成了一个只能陪聊、不能扛事的“吞金兽”。

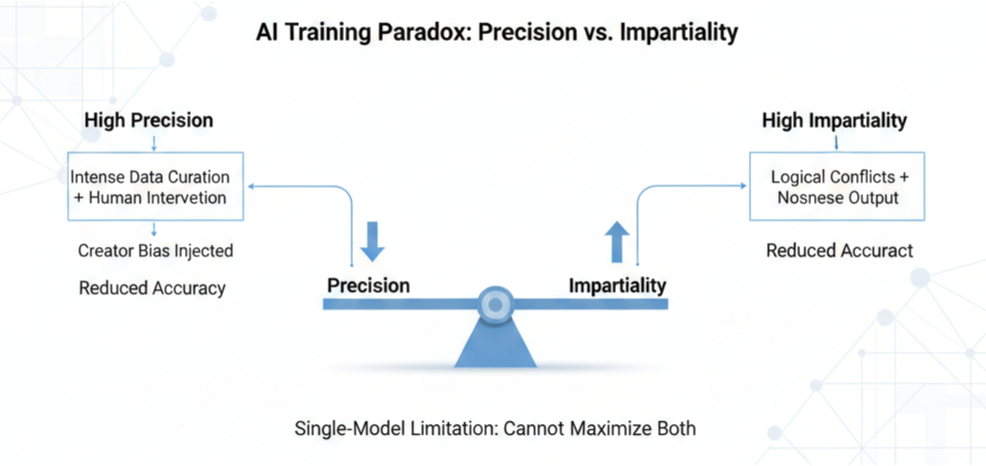

我一直在琢磨这个所谓的“训练悖论”,它就像是AI界的能量守恒定律,把所有的模型都死死地按在地上摩擦。你想要提高精度,减少那让人抓狂的幻觉,就得对训练数据进行疯狂的人工干预和筛选,可这一筛选,创作者的偏见就不可避免地喂进了模型的骨子里,准确性自然就垮了。反过来,如果你为了追求大而全、为了所谓的客观去喂各种驳杂的数据,模型又会因为逻辑冲突而变得语无伦次。这就好比一个精密的天平,左手是精准,右手是公正,你永远没法在单体模型里让这两端同时达到极致。即便是那些吹得天花乱坠的微调模型,一旦碰上没见过的“活久见”场景,照样还是会翻车。

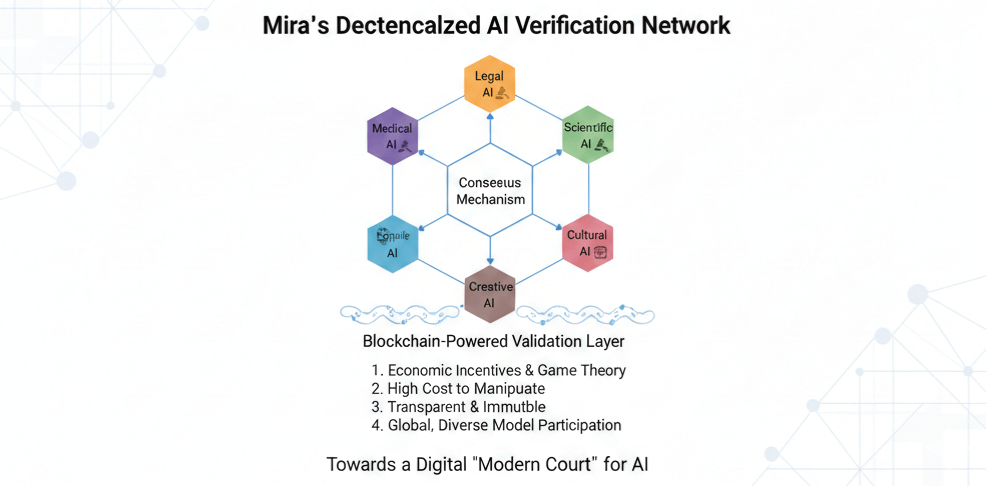

说白了,这种单兵作战的模式已经撞到了物理天花板。最近我关注到一个叫Mira的项目,他们的思路倒是有点意思, 一个模型会撒谎,一群背景迥异的模型放在一起搞共识机制,幻觉被对冲了,偏见被平衡了,这确实比指望OpenAI或者Google那几家巨头在封闭的实验室里搞出什么“终极答案”要靠谱得多。毕竟,如果真理被掌握在少数几个中心化的节点手里,那种系统性的误差才是最让人脊背发凉的。

Mira最狠的一招是把这套共识机制搬到了区块链上。它不再是简单的模型堆砌,而是构建了一个去中心化的验证网络。你想操纵共识?对不起,那得付出巨大的经济成本和算力代价。这种通过经济激励和博弈论构建起来的验证层,就像是给狂奔的AI加上了一道数字枷锁,也提供了一面照妖镜。它不再依赖某个权威机构的信用,而是让分布在全球的、代表不同文化和专业领域的模型互相博弈,最后吐出一个经得起推敲的证据。这种逻辑让我想起了一个比喻:现在的AI模型就像是还没出师的学徒,各怀鬼胎也各有所长,而Mira则是在建立一个密不透风的现代法庭,用程序的正义去约束个体的荒诞。在这个数字世界里,单体的天才往往是不可靠的,唯有那套冰冷、透明且不可篡改的集装箱式协作网络,才是通往真正通用人工智能的最后一公里。